Microsoft Security Copilot──GPT-4採用のサイバーセキュリティ分析ツール誕生

米Microsoftは3月28日(現地時間)、米OpenAIの大規模言語モデル(LLM)「GPT-4」採用のセキュリティ分析ツール「Microsoft Security Copilot」を発表した。Azure上で稼働し、組織のセキュリティ担当者が侵害を特定し、防御するのを助けるAIサービスだ。まだプレビュー段階で、一般提供は開始されていない。

GPT-4をMicrosoftのセキュリティ固有のモデルと組み合わせた「単なるLLMではなく学習するシステム」。Microsoftのモデルにはセキュリティ固有のスキルセットが組み込まれており、独自の脅威インテリジェンスとMicrosoftが毎日受け取っている65兆以上の脅威シグナルで情報が提供されているという。

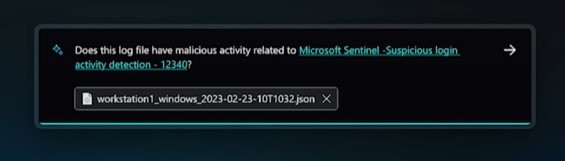

セキュリティ担当者がプロンプトから自然言語で、例えば「最近のランサムウェア攻撃の傾向は?」と尋ねると、関連するデータやレポートを提示する。さらに「どう対策すべきか?」と入力すると、ベストプラクティスや推奨事項を提供する。

また、プロンプトにファイルを添付して怪しいものかどうかチェックを頼むこともできる。

Microsoftは「Security Copilotは常にすべてを正しく行うわけではない」が、ユーザーのインプットから常に学習し、フィードバックを受けて成長していくと説明する。

とはいえ、「ユーザーのデータを基盤となるAIモデルのトレーニングに使うことはない」。データとAIモデルは「業界で最も包括的なエンタープライズコンプライアンスとセキュリティコントロールによって、あらゆる段階で保護されている」としている。

Security Copilotの活用シナリオなどは専用ページにまとめられている。

Microsoftは、2021年6月に「GitHub Copilot」を発表し、その後「Dynamics 365 Copilot」、「Microsoft 365 Copilot」、ローコード開発の「Power Platform」の「Copilot」を立て続けてに発表している。

関連記事

Microsoft、「Teams」のデスクトップ版を刷新 「使用メモリ半減、性能2倍」 生成型AIも使いやすく

Microsoft、「Teams」のデスクトップ版を刷新 「使用メモリ半減、性能2倍」 生成型AIも使いやすく

Microsoftはコミュニケーションツール「Teams」を刷新すると発表した。使用メモリが半減し、性能は2倍になる。デザインも変わり、生成型AIも使いやすくなる。 「GitHub Copilot X」発表 GPT-4搭載で音声チャットコーディングやプルリクエスト自動生成が可能に

「GitHub Copilot X」発表 GPT-4搭載で音声チャットコーディングやプルリクエスト自動生成が可能に

Microsoft傘下のGitHubがCopilotの次世代ビジョン「Copilot X」を発表した。「GPT-4」を採用し、音声チャットでのプロンプト入力も可能になる。プルリクエストも自動追加する。 ワードやエクセルと「GPT-4」が合体 「Microsoft 365 Copilot」発表 日本のDXも爆速化?

ワードやエクセルと「GPT-4」が合体 「Microsoft 365 Copilot」発表 日本のDXも爆速化?

米Microsoftのオフィスアプリ「Microsoft 365」に新機能「Microsoft 365 Copilot」が登場した。大規模言語モデル「GPT-4」を内蔵することで、「ChatGPT」のように「Word」や「Excel」などの作業をチャットするだけでサポートしてくれる。 Microsoft、ローコード開発の「Power Platform」にも「Copilot」 チャットしながらアプリ開発

Microsoft、ローコード開発の「Power Platform」にも「Copilot」 チャットしながらアプリ開発

Microsoftは、ローコード開発の「Power Platform」にも「Copilot」を追加すると発表した。「新しいBing」のようなチャットbotと会話しながらアプリやWebサイトを生成できる。完成したアプリでもチャットbotを利用できる。 Microsoft、企業向けにも生成系AI 「Dynamics 365 Copilot」提供開始

Microsoft、企業向けにも生成系AI 「Dynamics 365 Copilot」提供開始

Microsoftは生成系AI採用のビジネスアシスタント「Dynamics 365 Copilot」を発表した。Teams会議の議事録作成やCRMでの顧客対応支援などを行う。近くDynamics 365の顧客に追加料金なしで提供を開始する。 GitHubにAIプログラミング機能「Copilot」登場 関数名とコメントから中身を丸ごと自動補完

GitHubにAIプログラミング機能「Copilot」登場 関数名とコメントから中身を丸ごと自動補完

米GitHubが、関数名とコメントから関数のコードを丸ごと自動補完するAIプログラミング機能「GitHub Copilot」を発表した。Python、JavaScript、TypeScript、Ruby、Go言語に特に良く対応できるという。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR