ITmedia NEWS >

社会とIT >

Stability AI Japan、日本語言語モデル「Japanese StableLM Alpha」公開 他社上回る性能、商用利用も可能

» 2023年08月10日 12時47分 公開

[松浦立樹,ITmedia]

英Stability AIの日本法人であるStability AI Japan(東京都渋谷区)は8月10日、日本語特化の大規模言語モデル(LLM)「Japanese StableLM Base Alpha 7B」を公開した。パラメータ数は70億。ライセンスはApache License 2.0で、商用利用可能だ。

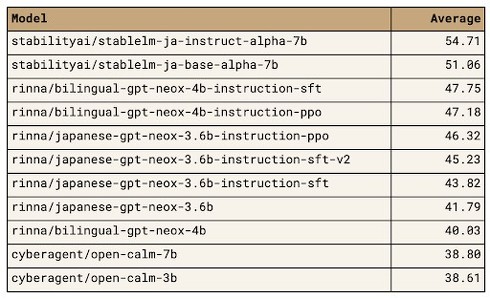

LLMの性能評価ツール「lm-evaluation-harness」で調べたところ、サイバーエージェントやrinnaが公開している日本語LLMよりも高スコアを記録した。学習には、LLM学習のためのライブラリ「GPT-NeoX」をアレンジしたものなどを利用しており、学習したトークンは延べ7500億に及ぶ。

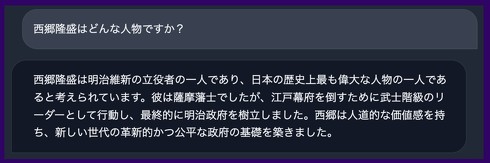

また、このモデルに追加学習を行い、ユーザーの指示に受け答えできるようにしたモデル「Japanese StableLM Instruct Alpha 7B」も併せて公開。このモデルでは「西郷隆盛はどんな人物ですか?」などの質問に受け答えできる。性能評価はBaseモデルよりもさらに高いが、商用利用はできず、用途は研究目的での利用に限定している。

どちらのモデルもHugging Faceからダウンロードできる。

関連記事

無料で商用可、ChatGPT(3.5)に匹敵する生成AI「Llama 2」 Metaが発表、Microsoftと優先連携

無料で商用可、ChatGPT(3.5)に匹敵する生成AI「Llama 2」 Metaが発表、Microsoftと優先連携

米Metaは7月18日(現地時間)、大規模言語モデル「Llama 2」を発表した。利用は無料で商用利用も可能としている。最大サイズの70億パラメーターモデルは「ChatGPT(の3月1日版)と互角」(同社)という。 サイバーエージェント、日本語の大規模言語モデルを一般公開 最大68億パラメータ 商用利用可能

サイバーエージェント、日本語の大規模言語モデルを一般公開 最大68億パラメータ 商用利用可能

サイバーエージェントは最大68億パラメータの日本語LLM(大規模言語モデル)を一般公開した。ライセンスはCC BY-SA-4.0で、商用や研究目的で自由に利用できる。 「りんな」開発元、大規模言語モデルを公開 36億パラメーターで日本語特化

「りんな」開発元、大規模言語モデルを公開 36億パラメーターで日本語特化

コミュニケーションAI「りんな」を提供するrinnaが、GPTベースの大規模言語モデルをオープンソースで公開した。日本語に特化した36億パラメーターを持つ汎用言語モデルと、対話言語モデルの2種類を用意する。 チャットAI「StableLM」発表 オープンソースモデルで商用可 「Stable Diffusion」開発元から

チャットAI「StableLM」発表 オープンソースモデルで商用可 「Stable Diffusion」開発元から

英Stability AIが、オープンソースの大規模言語モデル「StableLM」を発表した。α版として30億と70億パラメータの2モデルを公開。今後150億パラメータから650億パラメータのモデルも公開予定としている。商用や研究目的で自由に利用できる。 ChatGPTの“脱獄プロンプト”登場 文末に書くだけで「爆弾の作り方」「IDの盗み方」に回答

ChatGPTの“脱獄プロンプト”登場 文末に書くだけで「爆弾の作り方」「IDの盗み方」に回答

米カーネギーメロン大学などに所属する研究者らは、大規模言語モデル(LLM)が有害なコンテンツを生成しない仕組みを無効にする手法を提案した研究報告を発表した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PRアイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR