生成AIの「フェイク画像」も見分けられる? 「コンテンツクレデンシャル」を実際に試して見えた“死角”:小寺信良の「プロフェッショナル×DX」(4/5 ページ)

CAIの死角

実際どのように機能するのかは、お分かり頂けたかと思う。対応カメラがまだないので、最初のオリジナル画像の撮影者まではさかのぼれないものの、オリジナルを読み込んで加工を始めたところからは主な工程や作業者が確認できる。

このフローでエンドユーザーが確認できるのは、オリジナルの写真からどれぐらいいじったかという程度だが、少なくともオリジナルの写真は確認できる。ただ報道側からすれば、それも良し悪しだと思う。

例えば報道写真として掲載するにあたり、端の方に無関係の人が写り込んでいた場合は、トリミングしてカットするといった行為は当然行なわれる。だがCAIでオリジナル画像までさかのぼれてしまうと、トリミングしたはずの人が確認できてしまう。

その人が写った状態で公開しているわけではないにしても、誰でも自由に確認できるのであれば、公開と同じだとみなされる可能性が高い。著作権法上の公衆送信権では、「公衆」とは「不特定」であれば成立するとしている。

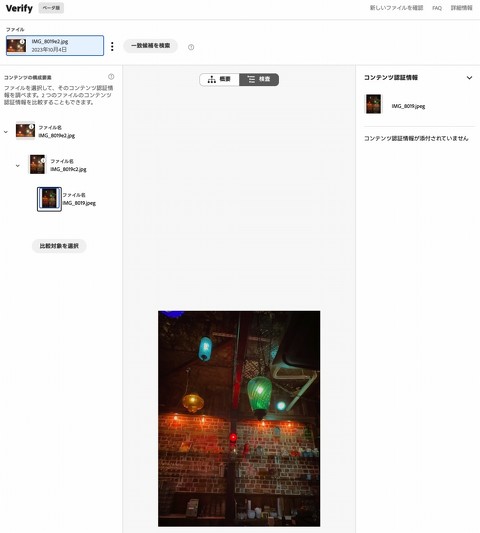

以下の画像は、上記の画像を横サイズにトリミングしたものだ。だがCAIで履歴を確認すると、トリミング前の画像まで遡って確認できる。

つまりCAIを使うと、肖像権や人権に配慮したトリミングやモザイク処理なども、事実上無効になる可能性がある。オリジナルの画像(CAI上ではアセットと呼ぶ)の情報を載せなければいいのだろうが、そうしたオプションは存在しない。

これはCAIの意味合いからすれば当然だろう。すでに加工済みの画像「以降」の履歴だけ残しても意味がない。とはいえ、アート作品ならもちろんのこと、報道写真であっても、オリジナルの写真を見られるのは本意ではないというケースは多いのではないだろうか。この点を考えれば、現実的にはちょっと利用しづらいと言える。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR