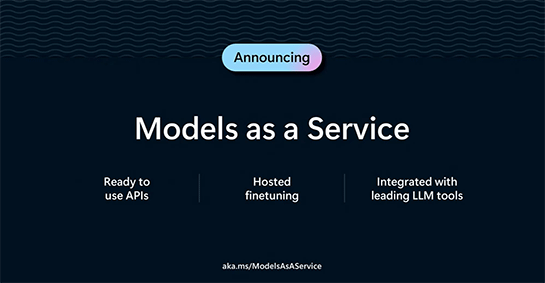

大規模言語モデルを選択→数秒後にAzure上で試せる「Models as a Service」登場 従量課金制の推論API、ファインチューニングも可能。

この記事は新野淳一氏のブログ「Publickey」に掲載された「マイクロソフト、大規模言語モデルを選択すると数秒後にAzure上で試せる「Models as a Service」発表。従量課金制の推論API、ファインチューニングも可能。Ignite 2023」(2023年11月17日掲載)を、ITmedia NEWS編集部で一部編集し、転載したものです。

米Microsoftは開催中のイベント「Microsoft Ignite 2023」で、オープンソースの大規模言語モデルを、Microsoft Azure上でマネージドサービスとしてすぐに試せる「Models as a Service」を提供すると発表しました。

これにより開発者が簡単に大規模言語モデルのサービスを簡単かつ迅速に試し、アプリケーションの開発に利用できるようになります。

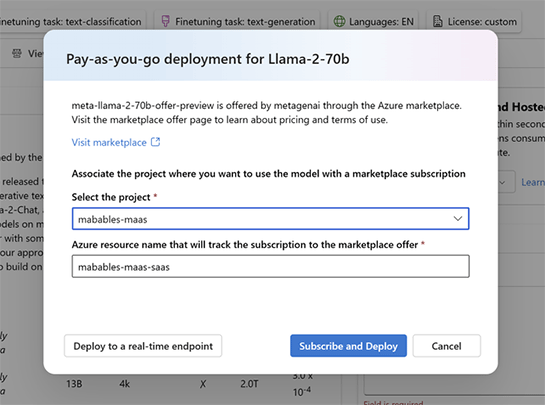

当初はMetaが公開している大規模言語モデルLlma 2をサポートし、今後MistralやJaisなど対応する大規模言語モデルの種類を拡大していく予定です。

カタログから選択すると数秒後には利用可能、従量課金制

Models as a Serviceでは、カタログからモデルを選択すると数秒でその大規模言語モデルに対する推論APIとファインチューニングが可能になります。

開発者はすぐにプレイグラウンドでの大規模言語モデルの探索や、Prompt Flow、Sematic Kernel、LangChainなどのツールを用いて大規模言語モデルアプリケーションの構築などを実行できます。

また、独自のトレーニングデータを提供するだけで、Llama 2モデルのファインチューニングを簡単に始めることができます。

Microsoft Azureは以前からAzure AIモデルカタログを提供していましたが、カタログから選択したモデルをデプロイするための大量のGPUのプロビジョニングに時間がかかるなどの課題がありました。

Models as a Serviceでは、そうした課題を解決してすぐに大規模言語モデルが利用可能となります。また、推論APIはトークンの数による従量課金制のため、かかるコストも小さく始めることが可能となります。

関連記事

AzureでChatGPTが利用可能に、近日公開 「Azure OpenAI Service」一般提供スタート

AzureでChatGPTが利用可能に、近日公開 「Azure OpenAI Service」一般提供スタート

米Microsoftが「Azure OpenAI Service」の一般提供を発表。近日中にAzure OpenAI ServiceでAI言語モデル「ChatGPT」を利用可能にする方針も明かした。 Microsoft、GPT-3をAzureで使える「Azure OpenAI Service」を招待制で開始

Microsoft、GPT-3をAzureで使える「Azure OpenAI Service」を招待制で開始

Microsoftは自然言語処理モデル「GPT-3」をクラウドで利用できる「Azure OpenAI Service」を発表。Azure上でノーコード開発や長文要約ができる。まずは招待制で開始する。 NECの大規模言語モデルが一般初公開 現地の様子は

NECの大規模言語モデルが一般初公開 現地の様子は

NECの自社製大規模言語モデル(LLM)が、テクノロジー展示会「CEATEC 2023」(10月17〜20日、幕張メッセ)で初の一般公開となった。会場から2時間程度たった正午ごろには、ブースに十数人程度の人だかりができる様子も。 米Microsoft、全製品にAIを搭載へ WSJが報道

米Microsoft、全製品にAIを搭載へ WSJが報道

米Microsoftが同社の全製品にAI機能を搭載する方針であると、米Wall Street Journal(WSJ)が1月18日に報じた。 マイクロソフト提供の“社内GPT基盤”もGPT-4 Turboなどに対応

マイクロソフト提供の“社内GPT基盤”もGPT-4 Turboなどに対応

米Microsoftが、大規模言語モデル「GPT-4」などのAPIをクラウドサービス「Microsoft Azure」経由で使える「Azure OpenAI Service」の新機能を発表した。米OpenAIが発表したばかりの「GPT-4 Turbo」や「GPT-3.5 Turbo」の新バージョンに対応する他、画像生成AI「DALL-E 3」や音声認識システム「Whisper 3」もサポートするという。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR