ITmedia NEWS >

企業・業界動向 >

OpenAI、壊滅的なリスクのあるAIのフロンティアモデルに関しては取締役会に拒否権

» 2023年12月19日 07時29分 公開

[ITmedia]

米OpenAIは12月18日(現地時間)、AIの脅威を防ぐための安全プロセスを拡張したと発表した。10月に発表した「Preparedness」のWebサイトが更新されている。

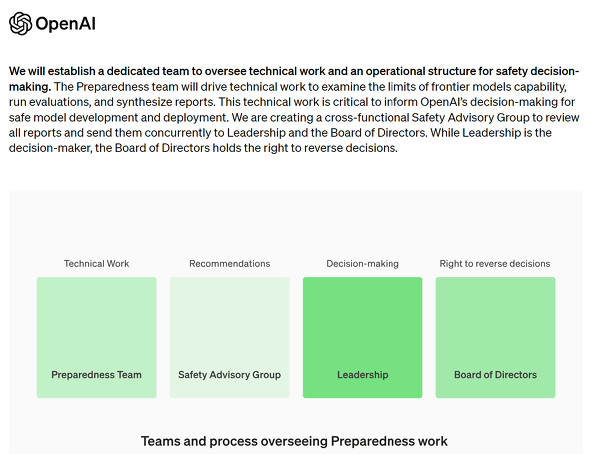

新たに部門横断的な「Safety Advisory Group」(安全諮問グループ)を設立する。10月に立ち上げたPreparednessチームは引き続きフロンティアモデル(最先端の既存モデルの機能を超え、さまざまなタスクを実行できる大規模な機械学習モデル)の限界を調べるための技術的作業を推進する。安全諮問グループは、Preparednessチームからの報告書を検討する。

意思決定は経営陣が行うが、取締役会は決定を覆す権利(拒否権)を持つ。

取締役は現在、アダム・ディアンジェロ氏、元SalesforceのCEOで取締役会長に就任するブレット・テイラー氏、経済学者のラリー・サマーズ氏の3人。米Microsoftも議決権のないオブザーバーとして取締役を送り込むことになっている。

なお、フロンティアモデルではない、現行のChatGPTなどの管理は「Safety Systems」チームが行う。

関連記事

OpenAI、Microsoftを議決権のないオブザーバーに

OpenAI、Microsoftを議決権のないオブザーバーに

OpenAIは、サム・アルトマン氏のCEO復帰、ミラ・ムラティ氏のCTO復帰を発表した。また、Microsoftを議決権のないオブザーバーとして取締役会に迎えるとしている。 OpenAIの新取締役3人のプロフィール

OpenAIの新取締役3人のプロフィール

OpenAIが発表した“初期段階”の取締役会のメンバー、アダム・ディアンジェロ氏、会長になるブレット・テイラー氏、ラリー・サマーズ氏のプロフィールを簡単に紹介する。 OpenAIやMetaなどAI大手、フロンティアAIモデルのリリース前に政府当局のテストを受ける協定に署名

OpenAIやMetaなどAI大手、フロンティアAIモデルのリリース前に政府当局のテストを受ける協定に署名

英国で開催のAI Safety Summitで、OpenAI、Meta、Microsoft、Google DeepMind、Anthropicは、フロンティアAIモデルのリリース前に政府当局がそれらのモデルをテストできるようにする協定に署名した。 OpenAI、AIの“壊滅的な”リスクに取り組む「Preparedness」チーム結成

OpenAI、AIの“壊滅的な”リスクに取り組む「Preparedness」チーム結成

OpenAIは、AIの“壊滅的な”リスクに取り組むためのチーム「Preparedness」を結成した。また、そうした壊滅的リスクとその対処についてのアイデアを募集するコンテストも開始。優秀な回答には2万5000ドル分のAPIクレジットを提供する。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PRアイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR