AIエージェントはGUIの世界を殺すのか:小寺信良のIT大作戦(2/4 ページ)

2026年は、日本でも「AIスマートグラス元年」になるかもしれないといわれている。MetaのAIスマートグラス「Ray-Ban Meta」が、いよいよ日本での展開を始めるからだ。4月に発表された新シリーズ「Optics Styles」は度付きレンズに最適化されたことで、普段からメガネが必要な人にも問題なく利用できるはずだ。

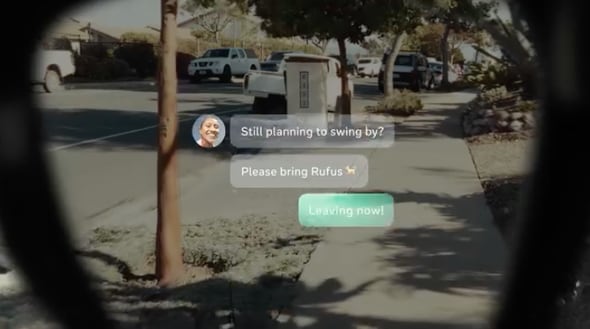

AIスマートグラスは、自然言語による音声指示によって操作する。Ray-Ban Metaはディスプレイがないので音声で情報を返すのみだが、ディスプレイ付きの製品「Meta Ray-Ban Display」も控えている。テキストや図版など軽いものからスタートし、次第に写真、動画などで情報を返してくるようになるだろう。

これからどこへ向かうのか

筆者がコンピュータと人間の関係性において、いつも思い浮かべるのが、「スター・トレック」の世界観である。人間が「コンピュータ」と呼びかけるだけで、船内のどこにいても音声で情報を返してくれる。1966年に構想されたこの世界観が、次第に現実に近づいている。

こうした音声によるコンピュータとのやり取りは、登場人物が何をやりたがっており、それに対してどんな情報が得られたのかを視聴者に分からせるための、ドラマ上の演出である。そこには、画面ベースのUIがない。また特定のアプリケーションもない。「コンピュータ」が情報検索から音楽再生、宇宙船の自爆設定まで、あらゆることをやってくれる。

AIエージェントが進む道としては、そういうことだろう。つまり人間が操作するためのUIは自然言語となり、アプリケーションは内部的には存在するのかもしれないが、「コンピュータ」という総体の中でモジュール化されたものとなり、人間が使い分けなどを意識する必要はない。これは「SaaSの死」どころではない、誰も無傷ではいられない大転換だ。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR