“AIキャラクターによるゲーム実況”の裏側 バンダイナムコ研究所が解説 AI生成コンテンツの“5つの落とし穴”とは:CEDEC 2024(2/3 ページ)

これに対し、バンダイナムコ研究所では多段階のチェックを行うパイプラインを構築することで対応している。具体的には、バンダイナムコ研究所では、4つの役割を持つAIをパイプライン化して利用している。

まず「生成者」というAIが基本的なテキストを作成し、「編集者」はその内容をチェックして修正点を指摘する。「キャラクター付け担当」は、テキストがキャラクターの個性に合っているかを確認し調整を行う。最後に「チェリーピッカー」が他のAIが作成した複数の候補から最適なものを選択する。この段階的な作業によって、誤りが少なく、ゲームの世界観に合った、各キャラクターらしいせりふや説明文を作り出せるという。

落とし穴2 出力の確保:役割分担とフィードバックループ

2つ目の課題は出力の安定性だ。LLMの出力が時として不安定になることがあるため、パイプライン化と役割分担の重要性を強調した。具体的には、生成者と編集者という役割を分離し、それぞれに特化したプロンプトを用意する方法を採用している。さらに、フィードバックループも実装しており、編集者AIからのフィードバックを受けて生成者AIが再度テキストを生成する仕組みを構築している。

落とし穴3 独自ルールの適用:LLM使用範囲の最適化

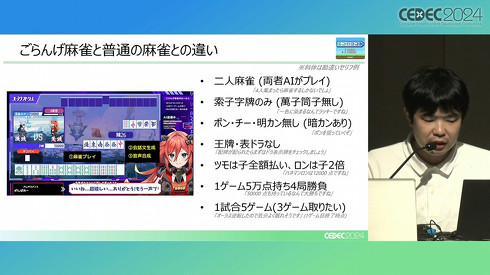

第3の課題は、独自ゲームルールへの適用だ。LLMが変則的なルールを解釈しないという問題がある。これに対してバンダイナムコ研究所は、LLMの使用範囲を制限する対策を講じた。ゲーム固有のルールや複雑な判定ロジックは、従来のプログラミング手法で実装することにし、LLMの活用は創造性が必要な場面に絞ることにした。

例えば、ごらんげ麻雀では、通常の麻雀とは異なる独自ルールを採用しているが、この独自ルールが汎用LLMの使用上で大きな課題となっている。しかし、LLMは一般的な麻雀のルールや知識をベースに回答を生成するため、ごらんげ麻雀特有のルールに沿った適切な発話を生成することが非常に難しい。

具体的には、通常の麻雀にない役や、特殊な点数計算方法などを正確に反映させる必要がある。この課題に対し、バンダイナムコ研究所はLLMの役割を限定し、独自ルールの処理を専用プログラムに任せる方法を取っている。

牌の評価や戦略の決定などのゲームロジックは専用のAIシステムが担当し、LLMはそのAIシステムから得た情報をもとに、キャラクターの個性を反映した自然な会話文を生成する役割に特化させている。また、独自ルールに関する誤った発言を防ぐため、プロンプトエンジニアリングを駆使して、LLMの出力をコントロールする工夫も施している。

Copyright © ITmedia, Inc. All Rights Reserved.