楽天、AIモデル「Rakuten AI 2.0」シリーズを無料公開 大規模言語モデル&小規模言語モデルの2形態で

» 2025年02月12日 15時45分 公開

[松浦立樹,ITmedia]

楽天グループは2月12日、2024年12月に発表した大規模言語モデル(LLM)「Rakuten AI 2.0」と小規模言語モデル(SLM)「Rakuten AI 2.0 mini」の提供を始めた。同社のHugging Face公式ページで公開中。ライセンスは「Apache 2.0」で商用利用なども可能だ。

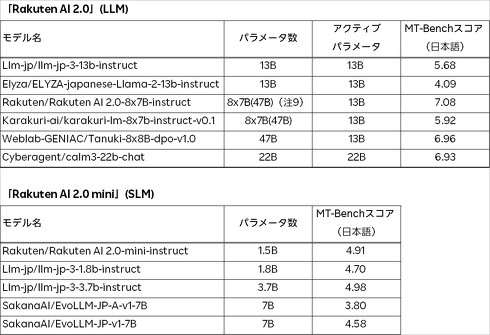

Rakuten AI 2.0は、同社が24年3月に公開した日本語に最適化した基盤モデル「Rakuten AI 7B」を基に開発したもの。一つのモデルを複数のサブモデルで構成し、問題に応じて使う領域を適切に選んで計算効率を高める技術「Mixture of Experts」(MoE)を採用している。今回開発したLLMは、70億パラメータのサブモデル8つで構成した。

Rakuten AI 2.0 miniは、15億パラメータの基盤モデル。同社が内製したフィルタリング技術などでキュレーションした日本語と英語のデータセットを学習に使うことで、高性能かつ高精度なテキスト生成処理を実現したという。サイズが小さいため、モバイル端末への導入や、データをリモートサーバに送信した自社運用での利用も想定しているという。

「これらのモデルは、コンテンツの要約、質問への回答、一般的なテキスト理解、対話システムの構築など、さまざまなテキスト生成タスクでの商業利用が可能。さらに、これらのモデルは新しいモデルを構築するためのベースとしても利用することができる」(楽天グループ)

関連記事

話題の中華LLM「DeepSeek R1」の日本語追加学習モデル サイバーエージェントが無料公開

話題の中華LLM「DeepSeek R1」の日本語追加学習モデル サイバーエージェントが無料公開

サイバーエージェントは、大規模言語モデル(LLM)「DeepSeek-R1」を使った新たなAIモデルを公開した。 DeepSeekで注目された「蒸留」って何だ? 識者が解説

DeepSeekで注目された「蒸留」って何だ? 識者が解説

中国のAI企業DeepSeekが、OpenAIの最新モデルに匹敵する性能を持つAIを、わずか10分の1以下のコストで開発したと発表し、AI業界に衝撃が走っている。NVIDIAの株価は一時17%下落。その背景には「蒸留」と呼ばれる技術の存在が取り沙汰されているが、その評価は専門家の間で分かれている。同社の快進撃の真相と、AI開発の新たなパラダイムとは何か。 楽天モバイル、メッセージアプリ「Rakuten Link」に生成AI機能を搭載 利用するAIモデルは明かさず

楽天モバイル、メッセージアプリ「Rakuten Link」に生成AI機能を搭載 利用するAIモデルは明かさず

楽天モバイルは10月31日、契約者専用のメッセージアプリ「Rakuten Link」にAIチャットbot機能「Rakuten Link AI」を搭載すると発表した。 【後編】孫正義×サム・アルトマンのAI対談、全編文字起こし 「AIは人を幸せにする。賭けてもいい」

【後編】孫正義×サム・アルトマンのAI対談、全編文字起こし 「AIは人を幸せにする。賭けてもいい」

ソフトバンクグループの孫正義代表取締役と、米OpenAIのサム・アルトマンCEOとの約50分のAI対談の内容を通訳を基に全編を通して文章化。その全貌をお届けする記事の後編となる。 マスク氏、974億ドルのOpenAI買収を主導 「Twitterを97.4億ドルで買収しましょうか」とアルトマンCEO

マスク氏、974億ドルのOpenAI買収を主導 「Twitterを97.4億ドルで買収しましょうか」とアルトマンCEO

イーロン・マスク氏率いる投資家グループが、OpenAIの買収に974億ドルの入札を行ったとWall Street Journalが報じた。これを受け、OpenAIのサム・アルトマンCEOはXで「あなたが望むならTwitterを97.4億ドルで買収しましょう」とポスト。約10分後にマスク氏がリプライした。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

SpecialPR

SpecialPR

アイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR