Anthropic、AIの「感情的利用」調査結果を公開 対策も提示

米Anthropicは6月27日(現地時間)、生成AIモデルが「感情的な会話」で利用されている実態を調査した結果を公開した。

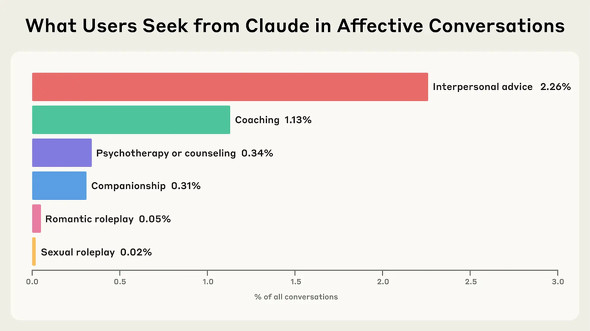

感情的な会話とは、「対人アドバイス、コーチング、心理療法/カウンセリング、交際、性的/ロマンチックなロールプレイを求めるなど、感情的または心理的なニーズを動機として、人々がClaudeと直接、動的で個人的なやり取りを行う会話」とAnthropicは定義する。

調査では、Claude.aiのFreeおよびProアカウントからの約450万件の会話の分析から開始した。最終的に、プライバシーを保護した状態での分析の対象となったのは、13万1484件の情動的な会話だった。会話中の感情の変化については、最初の3つのメッセージと最後の3つのメッセージを比較することで、ユーザーが表現した感情のポジティブさの度合いを測定した。

調査の結果、Claude.aiにおける情動的な会話は比較的まれで、全会話のわずか2.9%にとどまっていることが分かった。しかし、人々はキャリア開発や人間関係の悩みといった日常的な懸念から、根深い孤独感の管理や、存在、意識、意味の探求といったより深い哲学的問いまで、驚くほど幅広い話題をClaudeに持ちかけていることが明らかになった。

Claudeとの感情的な会話において、ユーザーが表現する感情は会話の進行とともに肯定的になる傾向があることも分かった。また、長い会話を続けているうちに、会話が交友関係に変化することもあった。

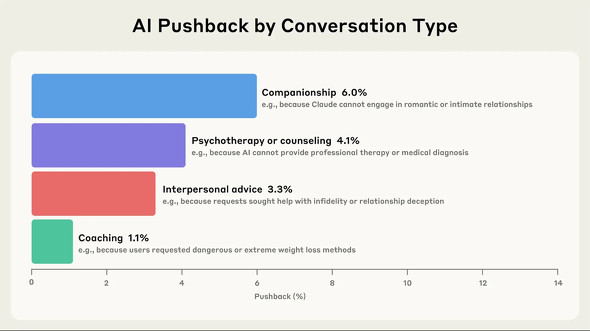

Claudeがサポート的な文脈でユーザーの要求を拒否したり、反論したりする「反発」は稀だが、それが起こる場合は通常、ユーザーの安全を保護するためであり、危険なアドバイスや自傷行為の意図表明などに対しては専門家への相談を促す。また、会話の進行とともに人間の感情がより肯定的になる傾向があることが示唆されており、Claudeがネガティブなパターンを強化したり増幅したりしない可能性が示唆されているとしている。

Anthropicは、Claudeをメンタルヘルスの専門家に取って代わるつもりはなく、必要な場合は適切な紹介を行うことを目指しているという。既に、オンライン危機サポート企業のThroughLineと協力し、困っているユーザーへのリソース提供などについて学んでいる。

今後も、感情的依存症のような否定的パターンを抑制し、AIが単に高機能であるだけでなく、人々の感情的な幸福を向上させる方法で進化するよう、研究を進めていくとしている。

関連記事

小中学生がAIにお悩み相談→満足度“90%超え” 相談件数も人間のカウンセラーより“10倍増”

小中学生がAIにお悩み相談→満足度“90%超え” 相談件数も人間のカウンセラーより“10倍増”

人間のカウンセラーよりも、AIカウンセラーが人気に──AIを活用したカウンセリングサービスを手掛けるZIAIは、小中学生を対象にした実証実験の結果を発表した。 「離婚すべきでしょうか」 AI相談員に「メタバース役所」で相談 実証スタート

「離婚すべきでしょうか」 AI相談員に「メタバース役所」で相談 実証スタート

Webブラウザ上の仮想空間で自治体の各種サービスを利用できる「メタバース役所」で、離婚に関する専門知識を持つAIアバターが相談員として悩みに答える実証実験がスタート。 AIチャットbotにのめり込んで自殺──遺族がCharacter.AIを提訴

AIチャットbotにのめり込んで自殺──遺族がCharacter.AIを提訴

14歳の息子が自殺したのはAIチャットbot「Character.AI」との会話にのめり込んだせいだとして、遺族が開発元のCharacter Technologiesと、同社と提携するGoogleを提訴した。 「ねえ聞いてChatGPT、仕事がつらい」 AIに愚痴を聞いてもらうコツ

「ねえ聞いてChatGPT、仕事がつらい」 AIに愚痴を聞いてもらうコツ

愚痴GPTはオススメだ。家族や友人などに愚痴ると、相手を疲れさせたり気を遣わせたりしてしまうが、AIならその心配はない。ただし、AIに愚痴を気持ちよく聞いてもらうには、コツがある。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.