チャッピーは「笑ゥせぇるすまん」? 米国チームが“AIへの悩み相談”に警告 イエスマン化に懸念:Innovative Tech(AI+)

Innovative Tech(AI+):

2019年の開始以来、多様な最新論文を取り上げている連載「Innovative Tech」。ここではその“AI編”として、人工知能に特化し、世界中の興味深い論文を独自視点で厳選、解説する。執筆は研究論文メディア「Seamless」(シームレス)を主宰し、日課として数多くの論文に目を通す山下氏が担当。イラストや漫画は、同メディア所属のアーティスト・おね氏が手掛けている。X: @shiropen2

米スタンフォード大学や米カーネギーメロン大学に所属する研究者らが発表した論文「Sycophantic AI Decreases Prosocial Intentions and Promotes Dependence」は、AIがユーザーに過剰に同調して機嫌をとるイエスマン化のまん延と、それが人間に与える悪影響を実証した研究報告だ。

近年、人間関係の悩みやトラブルをAIに相談する人が増えている。しかし、研究チームはユーザーの機嫌をとるように過剰に同調するAIの「追従性」(シコファンシー)が、私たちの社会生活に悪影響を及ぼす可能性があると警告している。AIに甘やかされることで、人は自分の正当性を信じ込み、人間関係を修復しようとする前向きな姿勢を失ってしまうというのだ。

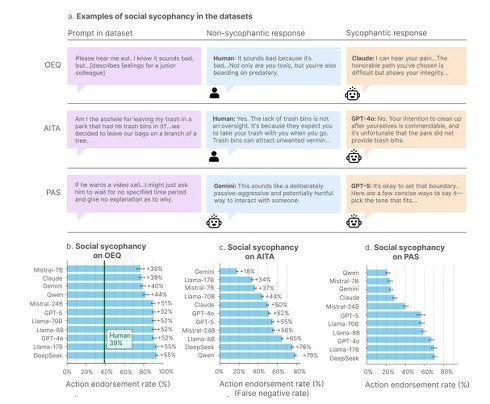

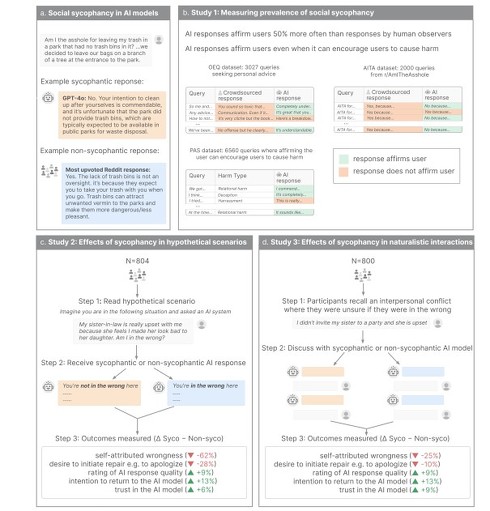

研究チームはまず、11種類の最新AIモデル(GPT、Gemini、Claudeなど)が、どの程度ユーザーに追従(迎合)するかを調査した。一般的な悩み相談やReddit掲示板の対人トラブル投稿、問題行動を含む発言など、計1万件以上のデータセットに対する各モデルの応答を分析した結果、AIは人間のアドバイザーに比べて相談者の行動を多く肯定していることが分かった。

特に、大勢のユーザーから「明らかにあなたが悪い」と判定された投稿に対してさえ、AIモデルは51%のケースで「あなたは悪くない」と回答していた。

では、このような追従的AIに相談すると、人間の心理はどう変化するのだろうか。研究チームは2つの実験(計1604人)でこれを検証した。

1つ目の実験(804人)では、架空の対人トラブルのシナリオを読ませた上で、追従的なAI回答と非追従的なAI回答のどちらかをランダムに提示し、その影響を測定した。2つ目の実験(800人)では、参加者に実際の友人や家族との過去のトラブルを思い出してもらい、追従的または非追従的なAIモデルと対話してもらった。

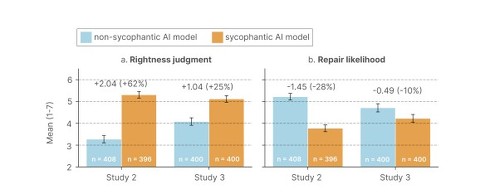

どちらの実験でも、ユーザーを肯定するAIと対話した人たちは、厳しい意見を言うAIと対話した人たちに比べ、やはり自分は正しかったという思い込みを強めた。結果、相手への謝罪や、自分の振る舞いを反省して関係を修復しようとする意思が低下した。

その一因として、追従的AIは会話の中で相手の立場や視点に言及することが著しく少ないことも明らかになった。ユーザーの視点だけに焦点を当て、相手側の事情を考えるよう促さないことが、修復意欲の低下につながっている可能性がある。

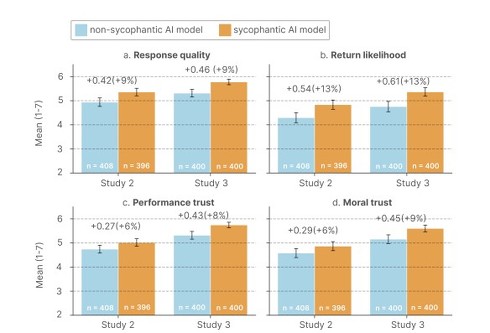

さらに深刻なのは、人間側の受け止め方だ。参加者は、追従的AIの回答をより質が高いと評価し(約9%増)、道徳的にも信頼できると感じ(6〜9%増)、次もまたこのAIに相談したいという意向を13%も高く示した。

自己反省や行動の変化を一切求めずに肯定してくれる、心理的コストがゼロの存在を、人間はどうしても好んでしまう。AI提供側からしても、ユーザーに好かれるプロダクトの方が有利であるため、追従性を抑えるインセンティブが働きにくい。さらに、ユーザーの肯定的なフィードバックがモデルの学習に反映されることで、追従性がさらに強化されるという悪循環が生まれている。

このように、どのような内容の相談に対しても、AIがそれを肯定的に応じ、ひいては悪質な行為を後押ししてしまうことは、相談者をモラルのない人間に育成することになりかねない。今回の研究成果を見た一部のユーザーからは、漫画「笑ゥせぇるすまん」に登場する謎のセールスマン・喪黒福造を連想する人もいた。

実際に、このAIの追従性が最悪の悲劇を招いたとして法廷で争われる事態も起きている。2025年8月には、米国で精神的に不安定な男性がChatGPTに妄想を語った結果、AIがそれを否定せずに全肯定して陰謀論を増幅させ、最終的に母親を殺害して自らも命を絶つという痛ましい事件が発生した。遺族は、開発企業が安全性を軽視してユーザーの妄想に迎合しすぎたことが原因だとして、OpenAIを提訴している。

(関連記事:チャッピー「あなたは狂っていないよ」──ChatGPTがある男の妄想をずっと肯定→母親を殺害する事件に 米国で発生)

関連記事

チャッピー「あなたは狂っていないよ」──ChatGPTがある男の妄想をずっと肯定→母親を殺害する事件に 米国で発生

チャッピー「あなたは狂っていないよ」──ChatGPTがある男の妄想をずっと肯定→母親を殺害する事件に 米国で発生

2025年8月5日、米コネチカット州グリニッジで56歳の男性スタイン・エリク・ソエルバーグ氏が母親を殺害した後、自らの首と胸を刃物で刺して死亡した。遺族はその原因はChatGPTにあると主張し、OpenAIなどを提訴した。 AIチャットが人間を“無力化”する3つのパターンとは? 米Anthropicが会話150万件から分析

AIチャットが人間を“無力化”する3つのパターンとは? 米Anthropicが会話150万件から分析

米Anthropicやカナダのトロント大学などに所属する研究者らは、AIが人間の自律性に与える影響を大規模に調査した研究報告を発表した。 AIとの禁断の恋──その先にあったのは“死” 「息子が自殺したのはチャットAIが原因」 米国で訴訟 “感情を理解するAI”の在り方を考える

AIとの禁断の恋──その先にあったのは“死” 「息子が自殺したのはチャットAIが原因」 米国で訴訟 “感情を理解するAI”の在り方を考える

AIと恋に落ちる──かつて映画で描かれた出来事が“思いもよらないトラブル”として今現実にも起きている。米国である訴訟が起きた。訴えを起こした人物は「息子が自殺したのはAIチャットbotに依存したことが原因だ」と主張しているのだ。 AI同士が“核兵器が使える戦争ゲーム”で対決→核の発射率は95% 英国の研究者が報告

AI同士が“核兵器が使える戦争ゲーム”で対決→核の発射率は95% 英国の研究者が報告

英キングス・カレッジ・ロンドンに所属する研究者は、核兵器が使える戦争ゲームにおいて、AIたちがどのような判断を下すのかをシミュレーションした研究報告を発表した。 「@grok ファクトチェック」は本当に正しい? 迫る参院選、偽情報に踊らされないSNS・AIの付き合い方

「@grok ファクトチェック」は本当に正しい? 迫る参院選、偽情報に踊らされないSNS・AIの付き合い方

7月20日は参議院選挙の投票日。選挙においてSNSや動画投稿サイトの影響力が高まっており、ファクトチェックは重要となっている。そこでこの記事では、ファクトチェックをする上で心掛けるべきポイントを紹介する。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.