テレパシー、動物コミュニケーション──時代を先取りしたGoogle Glass開発者が語る、ウェアラブルデバイスの未来(2/2 ページ)

未来のウェアラブルでできること

スターナー教授はGlassの技術をベースにしながら、未来のウェアラブルデバイスを形成する研究中の技術を紹介した。

1つ目は、発声せずに口の動きから何を喋ったかを認識できる「Silent Speech Recognition」というインタフェース技術だ。紹介の前に、まずは耳の穴に指を入れて口を動かしてみてほしい。かすかに内部が動いていることが分かるはずだ。

磁石を取り付けた舌の動きと、先ほど体験した顎の動きによって引き起こされる外耳道の変形をセンサーで読み取って文字を入力する。つまり、“読唇”をコンピュータが行える。病気で発声ができなくなった障がい者や、騒音が激しい飛行中の戦闘機パイロットなどに有効としている。

2つ目は、脳波から自然言語を取得する「Brain Sign」だ。事前に言葉を思い浮かべたときの脳波を記録しておき、後から判別できるようにしておくもの。現在は言葉のフレーズを読み取れるようにすることから研究を進めているという。

これら技術は、いずれもウェアラブルの課題である入力インタフェースを改善できるアイデアとして非常に期待できるものだ。「屋外で音声入力するのは恥ずかしい」という日本人ならではの悩みを解決できる可能性がある。

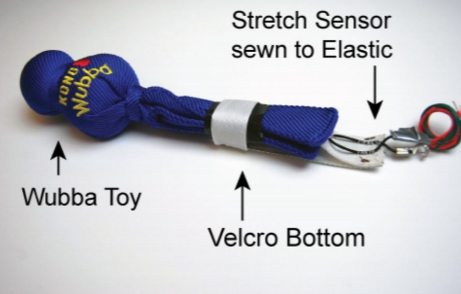

3つ目に紹介されたのは、スターナー教授が現在主に取り組んでいる「Facilitating Interactions for Dogs with Occupations」(FIDO)だ。一言でいえば、動物とのコミュニケーションを補助するセンサーデバイスだ。

「FIDO—Facilitating interactions for dogs with occupations:wearable communication interfaces for working dogs」から引用

「FIDO—Facilitating interactions for dogs with occupations:wearable communication interfaces for working dogs」から引用例えば、聴覚障がいを持つ人を助ける聴導犬は赤ちゃんの泣き声やドアのチャイム、アラーム、警報などを判別できる。盲導犬なら、階段の前で立ち止まり、階段を下りなのか上りなのかを理解している。しかし、判別はできても人間にそれを伝える手段がなかった。

そこで、犬の「鼻で触る」「かむ」といった動作を検知できる犬用のウェアラブルデバイスを装着してもらい、内容に対応する動作を覚えさせることで、犬が人間とコミュニケーションできるようにするのだという。

「テクノロジーの進歩によって、ウェアラブルで実現できる技術は大きく広がっている」(スターナー教授)

関連記事

「Google Glassは死んでいない」とシュミット会長──Wall Street Journal報道

「Google Glassは死んでいない」とシュミット会長──Wall Street Journal報道

Googleのエリック・シュミット会長が、メガネ型ウェアラブルプロジェクト「Glass」のGoogle Xからの卒業がプロジェクト全体の終了のように報じられているのは誤りで、自動運転カーと同様の長期的プロジェクトとして現在も一般向け提供を目指しているとWall Street Journalに語った。 回路を貼った“暖房ウェア”も 2017年は「衣料型ウェアラブル」に注目

回路を貼った“暖房ウェア”も 2017年は「衣料型ウェアラブル」に注目

セメダインの“暖房ウェア”や、ヤマハの“センサー手袋”など、導電性と伸縮性を兼ね備えた衣料型ウェアラブルが「ウェアラブルEXPO」に出展されている。 眼鏡をかけると“Pepper目線”に メガネスーパーのウェアラブル「b.g.」で体験

眼鏡をかけると“Pepper目線”に メガネスーパーのウェアラブル「b.g.」で体験

メガネスーパーが眼鏡型端末の試作機「b.g.」を、ウェアラブルEXPOに参考出展。左右にディスプレイを搭載し、取り外すと一般的な眼鏡としても使える。 脳を活性化する曲、AIで自動作曲 「スーパー日本人」実現に一歩

脳を活性化する曲、AIで自動作曲 「スーパー日本人」実現に一歩

阪大COI拠点とJSTは、脳を活性化する曲を自動作曲する人工知能を開発したと発表した。 ウェアラブルカメラ、ドローン監視、画像解析──「東京マラソン2017」今年もハイテク警備続々

ウェアラブルカメラ、ドローン監視、画像解析──「東京マラソン2017」今年もハイテク警備続々

2月に開催される「東京マラソン2017」の警備概要が発表された。ウェアラブルカメラを装備した警備員の増員や、ドローンと気球を使った上空監視などが行われる。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR