ITmedia NEWS >

AI+ >

10万円以下で作れる表情豊かなヒューマノイド「Eva」 ラズパイで動くオープンソースロボット:Innovative Tech(3/3 ページ)

» 2021年08月26日 09時30分 公開

[山下裕毅,ITmedia]

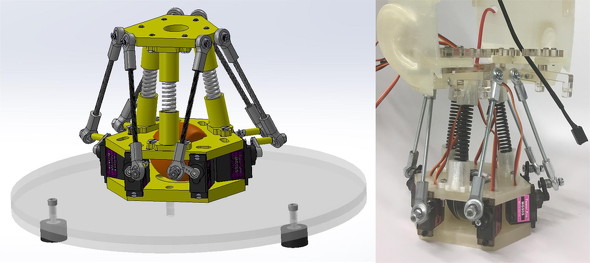

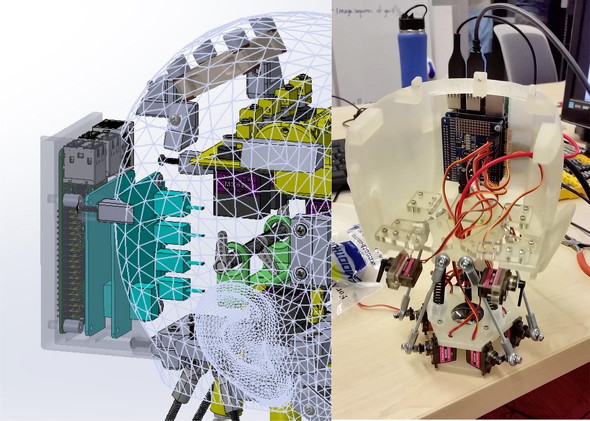

首は、6つのアクチュエーターで1つの平面を支えつつ、平面の位置と傾きを制御するロボットシステム「スチュワートプラットフォーム」を活用する。中心には大きなバネを3本組み込み、頭を支え首を安定させる。ミニスピーカーを中央に搭載し、テキスト読み上げソフトウェアから音声を出力する。

組み立てたヒューマノイドは、搭載したRaspberry Pi上でPythonプログラムを実行し制御できる。scikit-learnなど既存の機械学習ライブラリが利用可能だ。

Evaは、レーザーカッターやデスクトップ3Dプリンタ(プロトタイプはUltimaker2 + Extendedを使用)を利用し、約900ドルで製造できる。

Evaは、カメラで撮影した人の顔から、その表情をリアルタイムに反映する機能を搭載している。既存のビデオやその場にいる人の顔の動きを読み取り、似た動きを行える。その様子は以下の動画で確認できる。

関連記事

テレワークで「つながり弱い同僚」との会話は激減、しかしそれが不安をもたらす──NTT調査

テレワークで「つながり弱い同僚」との会話は激減、しかしそれが不安をもたらす──NTT調査

つながりが強い人と弱い人。それぞれ異なるコミュニケーションツールを使う傾向にあるという。それがもたらす結果とは。 分裂しても磁力で再結合 自己修復し泳ぎ続ける魚ロボット

分裂しても磁力で再結合 自己修復し泳ぎ続ける魚ロボット

分離したパーツを磁力で引き寄せるロボット。 霧の中に立体映像、32台のプロジェクターで投影 ドコモと東大「RayGraphy」開発

霧の中に立体映像、32台のプロジェクターで投影 ドコモと東大「RayGraphy」開発

どの方向からも裸眼立体視できる立体映像。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PRアイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR