映像内の猫や人から3Dアニメーションを作成 米Metaの研究機関などが開発:Innovative Tech

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

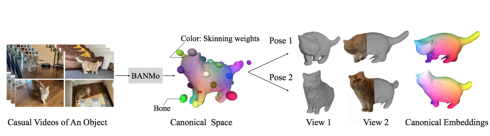

米Meta(元Facebook)の研究機関のMeta AIとMeta Reality Labs、米カーネギーメロン大学の研究チームが開発した「BANMo: Building Animatable 3D Neural Models from Many Casual Videos」は、単眼カメラで撮影した何気ない動画複数から、映像内に映る変形可能な非剛体オブジェクト(今回は人と四足歩行の動物)をアニメーション可能な3Dモデルに再構築するシステムだ。映像内の動く猫や人などをウェイト調整を含んだ関節付き3Dモデルとして高忠実度に再現する。

剛体のシーンでは、従来のSfM(Structure from Motion)アプローチを利用し、Webで公開している画像群でランドマークや都市全体の3Dモデルを構築できるが、動画から変形可能な非剛体オブジェクトを3Dモデルに変換するのは難しい。

その場合は、周囲に大量の同期カメラやセンサーを設置したリグ内で撮影するか、SMPLなどの事前に定義した3D形状テンプレートに依存するのがこの分野では一般的だろう。しかし、前者では大規模な設備を必要とし未知なる映像に対応できず、後者では正確な復元や素早い動きに対応できず、どちらも課題が残る。

この手法は、これらを使用せず、何気ないRGBビデオ複数(数千フレームからなる非同期映像)から対象となる物体を3Dアニメーション化する手法を提案する。

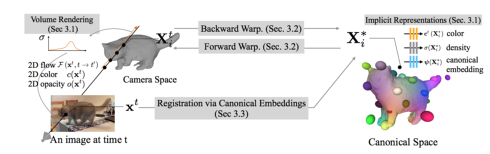

具体的には、微分可能なボリュームレンダリングに基づき、ピクセルカラーや透明度、オプティカルフロー、高次元の特徴記述子など、観測した画像に含まれる複数の手掛かりとの間の一貫性を確保するように最適化する。

物体の関節を表現するために、新しいニューラルブレンドスキニングモデルを使い、カメラ空間と正準空間の間で3Dポイントを変換する。特定のインスタンスに先立って、DensePoseを微調整することで、何千もの同期していないビデオフレームを同じ正準空間に統合し詳細なジオメトリを再構築する。

このようにして出力した3Dモデルは精度が高く、先行研究の類似手法で出力した結果と比べても、より高い忠実度を示した。

Source and Image Credits: Yang, Gengshan, Minh Vo, Natalia Neverova, Deva Ramanan, Andrea Vedaldi, and Hanbyul Joo. "BANMo: Building Animatable 3D Neural Models from Many Casual Videos." arXiv preprint arXiv:2112.12761 (2021).

関連記事

猫から「トイレしたにゃ〜!」とLINEが届くサービス NECらが22年1月から提供

猫から「トイレしたにゃ〜!」とLINEが届くサービス NECらが22年1月から提供

NECは、同社提供の遠隔地から犬や猫の様子をLINEのトーク形式で把握できるサービス「waneco talk」に、猫の排せつ時に、飼い主にLINEメッセージを送信するオプションを追加。2022年1月から提供する。 テレワーク中にちょっかいを出す猫には「おなかのポケット」に入ってもらおう

テレワーク中にちょっかいを出す猫には「おなかのポケット」に入ってもらおう

バウヒュッテの「にゃんガルーパーカー 2」を買って、猫を入れて仕事ができるかどうか試してみた。 2021年はなぜ「メタバース」の年となったのか?

2021年はなぜ「メタバース」の年となったのか?

Facebook改めMetaの猛プッシュにより「メタバース」が流行語となったが、それだけではない。 ある朝起きたら「変身」していた! メタバースとアバターの関係から見る「これは自分じゃない」問題

ある朝起きたら「変身」していた! メタバースとアバターの関係から見る「これは自分じゃない」問題

メタバースではどんな未来が生まれつつあるのでしょうか。そんなことを紹介していく新連載、スタートです。 ジョジョのキャラクター風に顔写真を変換する「JoJoGAN」 1枚の画像からAIが学習

ジョジョのキャラクター風に顔写真を変換する「JoJoGAN」 1枚の画像からAIが学習

米イリノイ大学アーバナ・シャンペーン校の研究チームは、入力した1枚の顔画像を漫画「ジョジョの奇妙な冒険」のキャラクター風に変換する機械学習フレームワークを開発した。「空条承太郎」など、作中のキャラクターに似せた顔に変換する。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR