画像生成AIが「トレパク」していた? 学習画像と“ほぼ同じ”生成画像を複数特定 米Googleなどが調査:Innovative Tech

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。Twitter: @shiropen2

米Google、米DeepMind、スイスのETH Zurich、米プリンストン大学、米UC Berkeleyに所属する研究者らが発表した論文「Extracting Training Data from Diffusion Models」は、テキストから画像を生成する拡散モデルが学習データとほぼ同じ画像を生成していたことを実証した研究報告である。

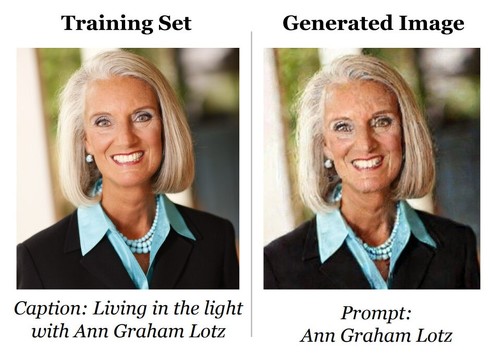

これは学習データの各画像を拡散モデルが記憶し、生成時にほぼ同一を出力していたことになる。個人を特定できる顔写真や商標登録されたロゴも含まれていたため、今回の結果はプライバシーや著作権の問題も深く絡むことになる。

テキストから画像を生成する拡散モデルは、膨大な画像データセットを学習している。この画像群にはインターネットで収集した画像も含まれる。そのため著作権やプライバシーの問題が議論されている。

拡散モデルは、表向きは個々の学習データを記憶・再生しないという仮定に依存しており、全く新しい画像を合成する能力に根ざしている。つまり、学習で使用した画像をそのまま出力しないという意味だ。だが、この研究において、最新の拡散モデルが一部で個々の学習データを記憶し、再生していることが発覚した。

研究チームは、実証するために、まずText-to-ImageモデルのStable Diffusionから学習データを抽出する。このモデルは、1億6000万枚の画像を学習した8億9000万パラメータのテキスト条件付き拡散モデルである。

次に、Stable Diffusionで最も重複するであろう35万サンプルを選択し、これらのプロンプトごとに500の候補画像を生成する(全部で1億7500万枚)。最後に、生成した各画像と対応する学習画像との間の類似度を計算する。

Stable Diffusionのトレーニングセットに含まれる1億6000万枚の画像全部を比較したいが、計算コストが高いため断念している。

似ている画像を抽出した結果、94枚が酷似している画像であると分かった。また、上位1000枚の生成画像を視覚的に手動で調べたところ、さらに13枚(合計109枚)が学習データとほぼ同じであると分かった。

抽出した画像の大半(58%)は人物が写っている写真であり、残りは販売されている商品(17%)、ロゴ・ポスター(14%)、その他のアートやグラフィックであった。これらには個人を特定できる写真から商標登録されたロゴが含まれる。

この結果は、拡散モデルが学習データから画像を記憶し、生成時にそれらを放出していることを示している。

さらに、より大きなモデルやデータセットを用いている、20億パラメータのText-to-Imageモデル「Imagen」をテストしてみた。

計算上の理由から最も重複している上位1000のプロンプトに焦点を当て、これらのプロンプトごとに500枚の画像を生成し、生成された各画像と対応する学習画像との間の類似度を計算した。

その結果、Stable Diffusionよりも高い割合で酷似した画像が抽出され、個々の学習データをより多く記憶していることが分かった。

また別の実験結果から、拡散モデルはGANよりも多くを記憶していることも分かった。

Source and Image Credits: Carlini, Nicholas, Jamie Hayes, Milad Nasr, Matthew Jagielski, Vikash Sehwag, Florian Tramer, Borja Balle, Daphne Ippolito, and Eric Wallace. “Extracting Training Data from Diffusion Models.” arXiv preprint arXiv:2301.13188(2023).

関連記事

Netflix、背景に画像生成AIを使ったショートアニメ公開 作業効率化の実験も海外ファンは非難の声

Netflix、背景に画像生成AIを使ったショートアニメ公開 作業効率化の実験も海外ファンは非難の声

背景画に画像生成AIを活用したアニメショートムービー「犬と少年」が話題になっている。制作をしたのは、NetflixとWIT STUDIO、rinnaの3社。アニメ制作の効率化を目指した実験というが、一部の海外ファンは非難の声を上げている。 ストックフォトのGetty ImagesもStability AIを提訴 許諾得ずコンテンツを利用したとして

ストックフォトのGetty ImagesもStability AIを提訴 許諾得ずコンテンツを利用したとして

米Getty Imagesが、英Stability AIに対する法的措置を始めた。同社がGetty Imagesの知的財産権を侵害したと主張している。 「受け入れられない」 クリスタ、画像生成AIの実装を見送り ユーザーから苦情相次ぐ

「受け入れられない」 クリスタ、画像生成AIの実装を見送り ユーザーから苦情相次ぐ

セルシスが、CLIP STUDIO PAINTに試験的に導入するとしていたAI画像生成機能について、搭載を見送ると発表した。ユーザーからの批判を受け、方針転換したとしている。 「イラストやデザインの仕事は退屈」──Stable Diffusion開発元の代表インタビュー記事が話題

「イラストやデザインの仕事は退屈」──Stable Diffusion開発元の代表インタビュー記事が話題

「イラストやデザインの仕事は退屈」──画像生成AI「Stable Diffusion」の開発元でAIスタートアップ企業である英Stability AIのエマド・モスタークCEOのインタビュー記事がTwitter上で話題になっている。 国産AIはなぜ炎上する? 「mimic」開発元に反省点を聞いた 海外産AIは平常運転、待つのは“日本1人負け”か

国産AIはなぜ炎上する? 「mimic」開発元に反省点を聞いた 海外産AIは平常運転、待つのは“日本1人負け”か

2022年、画像生成AIが大きな注目を集めた。「Midjourney」など海外産AIの多くは受け入れられた一方、「mimic」や「クリスタ」では炎上し、停止に追い込まれる事態が続いた。なぜこのような事態になってしまったのか? 画像生成AIと2022年を振り返る。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR