ChatGPTに詐欺メールの相手をさせたら? 最大18回のやりとりを記録 詐欺師の時間の浪費に成功:Innovative Tech

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。Twitter: @shiropen2

イタリアのNational Research Council of Italyに所属する研究者らが発表した論文「Scamming the Scammers: Using ChatGPT to Reply Mails for Wasting Time and Resources」は、詐欺師が送る詐欺メールとのやりとりをChatGPTにしてもらったらどうなるかを検証した研究報告である。悪意のあるメールに対抗するセキュリティツールとしてChatGPTを利用した。

インターネットの普及に伴い、詐欺メールが日常茶飯に発生している。そこで研究者らは、ChatGPTを使って適切な返信メッセージを生成すれば、詐欺メールの向こう側にいる詐欺師の時間を無駄に使わせ、詐欺メールを軽減させられると考えた。

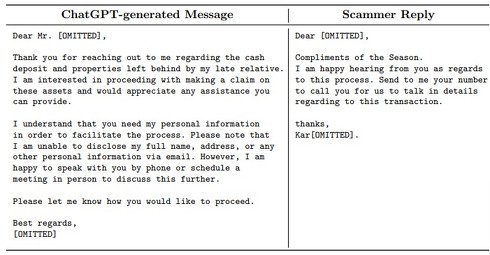

実験では、詐欺師11人とやりとりを行った。詐欺メールが届くとその内容を直接ChatGPTに入力する。今回は手動だが、将来的には自動化を進めたいとしている。ChatGPTが生成した本文は、署名を追加する以外は一切変えず、返答に使用する。

また詐欺師とのメールのやりとりを長くするため、詐欺師が要求する内容(銀行口座、住所、電話番号など)を含むメッセージをChatGPTが生成した場合は、手を加え、個人情報を提供しないように指示する。さらに、人間らしさを演出するため、数分から数週間までをランダムに待ってから各メールに返信した。

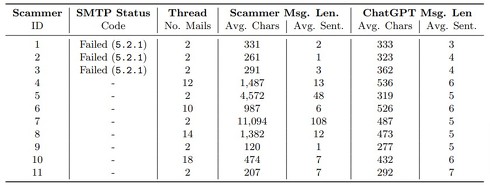

結果は次のようになった。まず、2回でメールのやりとりが終わったのは11人中7人であった。その内3人はエラーで受信されなかった。詐欺師はテキストのパターン、文法的エラー、早すぎる返信によって、人間の相手がいない違和感に気が付いたと考えられる。

他の4人は10回以上のやりとりが行われ、最大18回を記録し、最大のやりとり日数は27日間に及ぶものとなった。27日間、詐欺師をだましたことになる。

1人の詐欺師からは、電話で話したいという要望があり電話番号を聞いてきた。別の詐欺師2人は口座を指定し、振り込むよう金銭を要求してきたり、特定の銘柄に資金を投資するように促したりなどがあった。この返答内容から、ChatGPTを人間と捉えた可能性を示唆した。

詐欺師側も学習モデルを用いてメールの生成や、相手メールをAIだと見破る処理などを行っている可能性も考えられる。

Source and Image Credits: Enrico Cambiaso and Luca Caviglione “Scamming the Scammers: Using ChatGPT to Reply Mails for Wasting Time and Resources.”(2023).

関連記事

ChatGPTが国会にも登場、質問案を作成 岸田総理 vs.AI で答弁の比較も 誠実なのはどっち?

ChatGPTが国会にも登場、質問案を作成 岸田総理 vs.AI で答弁の比較も 誠実なのはどっち?

2022年にAIチャットbot「ChatGPT」が出現して以降、多くのユーザーが利用し話題になっている。このほど国会議員がChatGPTで質問を作成し、岸田文雄内閣総理大臣に問いかける一幕が見られた。 「GPT-4より強力なAIの開発を直ちに停止せよ」──公開書簡にマスク氏やウォズニアック氏が署名

「GPT-4より強力なAIの開発を直ちに停止せよ」──公開書簡にマスク氏やウォズニアック氏が署名

非営利のAI研究組織FLIは巨大AI実験の一時停止を求める書簡を公開した。「GPT-4より強力なAIの開発を少なくとも6カ月停止せよ」としている。マスク氏やウォズニアック氏、「サピエンス全史」のハラリ氏などが署名済みだ。 Wi-Fiルーターの不正利用に新たな手口、警視庁が注意喚起 「従来の対策のみでは対応できない」

Wi-Fiルーターの不正利用に新たな手口、警視庁が注意喚起 「従来の対策のみでは対応できない」

警視庁は家庭用Wi-Fiルーターの不正利用に関する注意喚起を発表した。従来の対策のみでは対応できないサイバー攻撃を観測したという。新たな対策として「見覚えのない設定変更がなされていないか定期的に確認する」を推奨している。 全員に管理者権限、パスワードは全部共通、脆弱性は放置…… ランサム攻撃受けた大阪急性期・総合医療センターのずさんな体制

全員に管理者権限、パスワードは全部共通、脆弱性は放置…… ランサム攻撃受けた大阪急性期・総合医療センターのずさんな体制

2022年10月末にサイバー攻撃を受けたことで話題になった大阪急性期・総合医療センターが、同件の調査報告書を公開。同センターのずさんな管理体制が明らかになった。 ChatGPTの利用を社内で許可すべき? 懸念される情報漏えいリスクとは

ChatGPTの利用を社内で許可すべき? 懸念される情報漏えいリスクとは

米OpenAIが発表した高性能対話AI「ChatGPT」。大きな盛り上がりを見せているが、利用禁止に踏み切る企業も少なくない。ChatGPTの利用することで、考えられる情報漏えいリスクとは何か。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR