YouTube、生成AI利用コンテンツに開示義務 違反すれば削除などの罰則対象に

米Google傘下のYouTubeは11月14日(現地時間)、生成AI関連の2つの新たなガイドラインを発表した。

YouTubeのコミュニティガイドラインには既に、視聴者を保護するための多様な規則があるが、生成AIの台頭で新たなリスクが生じており、それに対処するための新たなアプローチが必要になっているとYouTubeは説明する。

コンテンツが合成であることの開示を義務付け

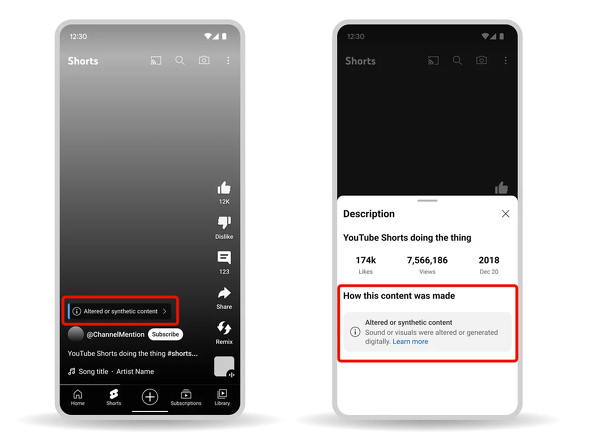

クリエイターに対し、AIツールなどを使って現実と見紛う改変あるいは合成コンテンツを生成した場合は、その開示を義務付ける。開示するための新たなオプションを選択できるようにする計画だ。

「開示しないことを一貫して選択したクリエイターは、コンテンツの削除やYouTubeパートナープログラムからの除籍などの罰則の対象になる場合がある」という。

なお、ラベルの有無に関わらず、コミュニティガイドラインに違反するコンテンツは削除される。

このオプションは今後数カ月間にわたって導入する予定。

生成AIなどでコンテンツに利用された側からの削除リクエストが可能に

例えば自分の顔や声が無断でデジタル的に生成されたりディープフェイクに使われたりした場合、プライバシーリクエストプロセスを使ってそうしたコンテンツの削除をリクエストできるようにする(こちらも「今後数カ月」以内に実施する見込み)。

また、音楽レーベルなどが所属アーティストの歌声やラップの声を模倣したAI生成コンテンツの削除をリクエストできる機能も導入する計画だ。

いずれの場合も、すべてのコンテンツを削除するわけではなく、「さまざまな要素」を考慮して削除するかどうかを判断するとしている。

YouTubeとSpotifyでは4月、人気アーティストの声を無断で使った生成AI楽曲が公開され、話題を呼んだ。YouTubeではこのコンテンツは本稿執筆現在も削除されていない。

YouTubeは8月、米音楽レーベル大手のUNIVERSAL MUSIC GROUP(UMG)と提携し、生成AIを適切に使うようにする取り組み「YouTube Music AI Incubator」を立ち上げた。

関連記事

YouTube、生成AIの取り組みでUNIVERSAL MUSICと提携 著作権を守りつつ音楽でのAI活用を

YouTube、生成AIの取り組みでUNIVERSAL MUSICと提携 著作権を守りつつ音楽でのAI活用を

YouTubeは、音楽分野での安全な生成AI活用のための“3つのAI原則”を発表した。また、大手レーベルのUMGと提携し、アーティストを保護しつつ音楽の創造的な表現を強化するための「YouTube Music AI Incubator」を設立した。 TBSアナの謝罪で話題、YouTubeの「コンテンツID」って?

TBSアナの謝罪で話題、YouTubeの「コンテンツID」って?

TBSテレビの宇内梨沙アナウンサーは23日、YouTubeで誤操作により他の動画投稿者に不適切な「著作権の申し立て」をしてしまったと謝罪した。ここに登場する「コンテンツID」とは何か。 ドレイクとザ・ウィークエンドの声を無断で使った生成型AI楽曲がSpotifyで人気に

ドレイクとザ・ウィークエンドの声を無断で使った生成型AI楽曲がSpotifyで人気に

ドレイクとザ・ウィークエンドの声で歌われる楽曲「Heart On My Sleeve」がSpotifyで公開され、25万回以上再生された。投稿したghostwriterと名乗る人物はこの曲をAIで生成したと説明。「これは始まりに過ぎない」と語った。 Google、テキストから音楽を生成する「MusicLM」発表 リリースはせず

Google、テキストから音楽を生成する「MusicLM」発表 リリースはせず

Googleは、テキストから音楽を生成するAIモデル「MusicLM」を発表した。多数のサンプルを聞くことができるが、著作権侵害などの恐れがあるため、現時点では公開はしない。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR