Sakana AI、AIの“多様性”を尊重した集団を開発する手法「CycleQD」発表 生物の“すみ分け”がヒント:Innovative Tech(AI+)

Innovative Tech(AI+):

このコーナーでは、2014年から先端テクノロジーの研究を論文単位で記事にしているWebメディア「Seamless」(シームレス)を主宰する山下裕毅氏が執筆。新規性の高いAI分野の科学論文を山下氏がピックアップし、解説する。

X: @shiropen2

AIベンチャー「Sakana AI」が発表した論文「Agent Skill Acquisition for Large Language Models via CycleQD」は、自然界の生物の「すみ分け」の仕組みをヒントに、小規模なAIモデル(AIエージェント)を複数育て上げ、それぞれが得意分野を持ちながら協力し合える新しい開発手法を提案した研究報告である。

大規模言語モデル(LLM)に特定のスキルを習得させる訓練には、依然として大きな課題が存在している。特に問題となっているのは、異なるスキルを学習させるためのデータの比率調整と、タスク固有の性能を適切に反映できない目的関数の設計である。

これらの課題を解決するため、研究チームは「CycleQD」という手法を開発した。この研究は、生態学における「ニッチ」(生態的地位)の概念をAI開発に応用するアプローチを提案している。

生態学では、ニッチとは生物種が持つ固有の能力や特性によって決定されるもので、その環境との関係を指す。これには、捕食する餌や占有する生活空間など、種の生存を可能にする特定のスキルや能力が含まれる。一度ニッチが占有されると、他の種がその既存の種を置き換えることは困難となる。

この生態学的なニッチの概念をAIエージェントに適用すると、各エージェントのニッチはその能力、実行可能なタスク、使用するリソースによって定義できる。十分に進化したエージェントは特定のニッチを効果的に占有し、他のエージェントとの競争に対して耐性を持つようになる。このアプローチにより、それぞれが特定の能力を持ち、互いに補完し合いながら全体として進化していくAIエージェントの集団を生み出すことが可能となる。

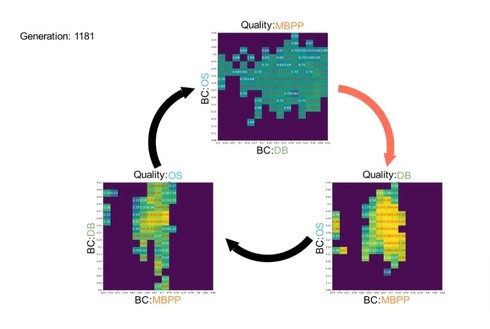

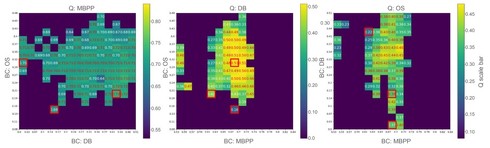

CycleQDフレームワークは、この考えを実践に移すものである。CycleQDの核となる特徴は、Quality Diversity(QD)フレームワークを周期的に適用する点にある。QDは単一の最適解を追求するのではなく、それぞれが独自の方法で優れた多様な解を発見することに焦点を当てる。

この周期的なアプローチにより、データの比率調整が不要となり、目的関数の設計も大幅に簡素化される。さらに、モデルマージによるクロスオーバーと特異値分解(SVD)ベースの突然変異を組み合わせることで、より効果的な学習を実現している。

初期集団には特定のタスクに特化した専門家モデルを配置し、そこから一般的な言語能力を保持しながら、エージェントタスクで高い性能を発揮する多様な小規模モデルの集団を進化させていく。

実験では、LLM「Llama3-8B-Instructモデル」を使用し、コーディング(MBPP)、データベース操作、オペレーティングシステム操作という3つのコンピュータサイエンスタスクに対してCycleQDを適用。各モデルは8Bパラメータという比較的小規模なサイズながら、従来の微調整やモデルマージングアプローチを上回る性能を示し、より多くのパラメータを持つとされる「GPT-3.5-Turbo」と同等の性能を達成した。

Sakana AIは、CycleQDの技術についてブログでは「知識やスキルを忘却せず蓄積していく『生涯学習』の実現への第一歩」と述べている。

Source and Image Credits: Kuroki, So, et al. “Agent Skill Acquisition for Large Language Models via CycleQD.” arXiv preprint arXiv:2410.14735(2024).

関連記事

科学研究をAIで全自動化──論文執筆や査読ができる「The AI Scientist」 Sakana AIが発表

科学研究をAIで全自動化──論文執筆や査読ができる「The AI Scientist」 Sakana AIが発表

AIモデルを使って、科学研究を自動化できないか?──AIベンチャーのSakana AIは、そんな需要に対応するAIシステム「The AI Scientist」を発表した。 生成AIベンチャー・Sakana AI、米NVIDIAなどから1億ドル超を調達

生成AIベンチャー・Sakana AI、米NVIDIAなどから1億ドル超を調達

AIベンチャーのSakana AIは米NVIDIAから出資を受けると発表した。 Sakana AI、複数の画像を扱える“日本語視覚言語モデル”公開 非英語圏での先駆けに

Sakana AI、複数の画像を扱える“日本語視覚言語モデル”公開 非英語圏での先駆けに

AIスタートアップのSakana AIは、複数の画像について日本語で質疑応答できるAIモデル「Llama-3-EvoVLM-JP-v2」を発表した。 LLMが別のLLMを何度も改善 より良い回答を出す最適化手法をAIが発見する技術 Sakana AIなどが開発

LLMが別のLLMを何度も改善 より良い回答を出す最適化手法をAIが発見する技術 Sakana AIなどが開発

AIベンチャーのSakana AIやFLAIR、英ケンブリッジ大学、オックスフォード大学に所属する研究者らは、人間の介入を最小限に抑えて新しい最適化アルゴリズムをAIによって発見する手法を提案した研究報告を発表した。 生成AI開発に革新か “自律進化”で目的のAIを自動生成 超低コスト&短期間で高性能モデルも開発済 トップ研究者集団「Sakana AI」

生成AI開発に革新か “自律進化”で目的のAIを自動生成 超低コスト&短期間で高性能モデルも開発済 トップ研究者集団「Sakana AI」

生成AIのトップ研究者らが東京で創業したAIベンチャーが、生成AI開発の新たな手法を開発した。同社の手法では設計を機械が自動で行い、“ほぼ無視できるレベル”の計算資源で開発が可能になるという。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.