NTT、再学習なしで特化型AIの基盤モデルを乗り換え可能に “カスタマイズ”引き継ぐ新技術

NTTは7月9日、AIモデルをカスタマイズした結果を、異なるサイズ・構造の基盤モデルに引き継げる「ポータブルチューニング」技術を確立したと発表した。AIモデルの学習に、基盤モデルとは独立して出力結果を調整する「報酬モデル」を導入。特定のタスクに特化したAIの基盤モデルを変更する際、再度学習をせずに済むため、運用コストの削減につながるという。

組織に生成AIを導入する場合、その組織特有のタスクに対応するため、個別のデータセットによる学習で、基盤モデルの出力を調整した「特化モデル」を活用するケースも少なくない。一方、基盤モデルは定期的に情報などが最新化される。そのため特化モデルを長期間運用するには、基盤モデルを変更するたびに出力を再度調整する必要があり、コスト面に課題があった。

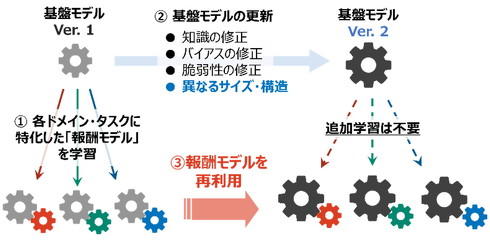

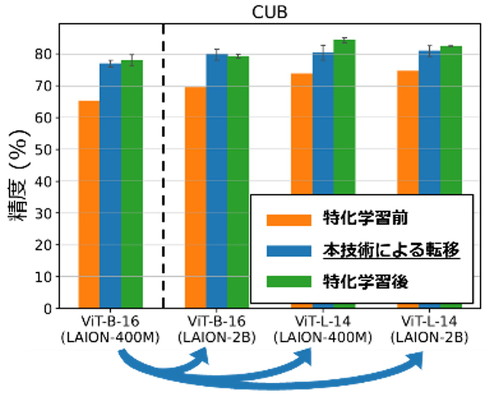

そこでNTTは、ポータブルチューニングにおいて、基盤モデルの出力をタスクごとに補正する報酬モデルを導入した。従来の学習では、基盤モデルのパラメータを直接最適化していたところ、報酬モデルを基盤モデルから独立したモデルとして調整。特化モデルの基盤モデルを変更する際、追加学習せずに報酬モデルを再利用することで、基盤モデルの出力を直に再調整した場合と同程度の性能を達成したという。

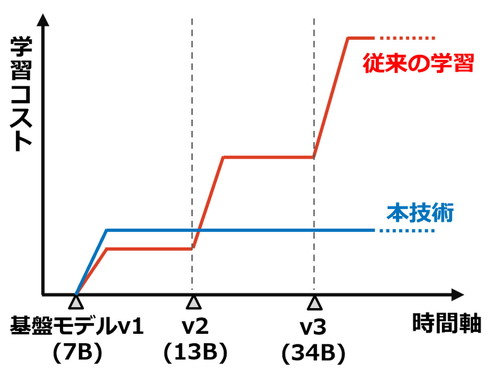

加えて報酬モデルは、基盤モデルの構造には依存しないため、変更の前後で基盤モデルの構造が異なっていても適用可能。初回の学習時にのみ、報酬モデルを調整するためのコストが余分に生じるものの、その後は基盤モデルを何度更新しても再学習が不要なため、学習コストを一定に保ち、コストの削減に役立つという。

なお、ポータブルチューニングは、NTTが2024年5月に発表した「学習転移」技術をベースに開発した。学習転移では、異なる基盤モデルにおけるニューラルネットワークの対称性に着目し、特化モデルにおける基盤モデルの変更コストを削減。一方、実用レベルに達するには追加学習が必要であり、変更前と後の基盤モデルの構造が異なると適応できないという課題があったことから、今回の技術開発に至った。

今回の成果は、25年7月13日から19日に開催される機械学習分野の国際会議「ICML 2025」(International Conference on Machine Learning)にて発表予定。

関連記事

全てのAI言語モデルは、プラトンが説く「イデアの世界」を共有して見ている? 米コーネル大学が研究

全てのAI言語モデルは、プラトンが説く「イデアの世界」を共有して見ている? 米コーネル大学が研究

古代ギリシャの哲学者プラトンは、私たちが見ている世界は真の実在(イデア)の影にすぎないと説いた。米コーネル大学の研究チームは、このイデア論を人工知能の世界に適用した研究を発表した。 Google、AIでメンタルヘルスケアの民主化目指す フィールドガイド公開や研究投資

Google、AIでメンタルヘルスケアの民主化目指す フィールドガイド公開や研究投資

GoogleがAIによるメンタルヘルスケア支援の新施策を発表。ケアのアクセス民主化を目指し、組織向けの活用ガイドを公開した。また、DeepMindなどが研究機関と提携し、不安症やうつ病などの治療法開発に向けたAI研究に投資する。 AIは強化学習で“人間のだまし方”を学ぶ──RLHFの副作用、海外チームが24年に報告 「正解っぽい回答」を出力

AIは強化学習で“人間のだまし方”を学ぶ──RLHFの副作用、海外チームが24年に報告 「正解っぽい回答」を出力

中国の清華大学や米UCバークレー、米Anthropicなどに所属する研究者らは2024年、強化学習による言語モデルの訓練が、予期せぬ副作用として人間を誤導する能力の向上をもたらすという懸念すべき現象を実証的に確認した研究報告を発表した。 AI店長、客に“親切すぎて”赤字を出す 原価割れにクーポンの大量配布 Anthropicが実験結果を公開

AI店長、客に“親切すぎて”赤字を出す 原価割れにクーポンの大量配布 Anthropicが実験結果を公開

AIに売店の経営を任せたらどうなるのか――AI開発企業の米Anthropicは、このような実験の結果を公開した。 自身のコードを書き換え“成長するAI”――Sakana AI、新たなAIエージェント「DGM」発表

自身のコードを書き換え“成長するAI”――Sakana AI、新たなAIエージェント「DGM」発表

Sakana AIは、自身のコードを書き換えて性能を高めるコーディング向けAIエージェント「ダーウィン・ゲーデル・マシン」を発表した。自身のコードを読み取り、修正することで、コーディング性能を高められるという。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.