新たな「国産LLM」公開、国立情報学研究所 「gpt-oss-20b」超えの日本語性能うたう

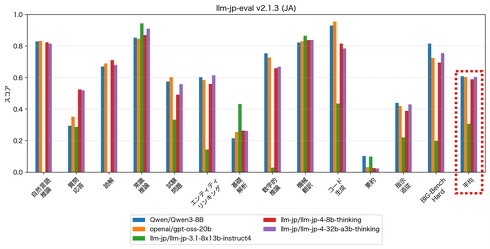

国立情報学研究所(NII)は4月3日、LLM「LLM-jp-4 8Bモデル」「LLM-jp-4 32B-A3Bモデル」をオープンソースライセンスで公開した。米OpenAIのオープンモデル「gpt-oss-20b」を上回る日本語性能をうたう。両モデルの学習に利用したデータセットも公開している。

LLM-jp-4 8Bモデルは約86億パラメータ、LLM-jp-4 32B-A3Bモデルは約320億パラメータを持つ。LLM-jp-4 32B-A3Bモデルでは、複数のサブモデルを組み合わせ、タスクに応じた領域のみを稼働して計算効率を高める「Mixture of Experts」(MoE)を採用した。

LLM-jp-4 8Bは米Metaのオープンモデル「Llama 2」、LLM-jp-4 32B-A3Bは中国Alibabaのオープンモデル「Qwen3」のアーキテクチャを採用。事前学習にはWeb上の公開データや政府・国会の文書などで構成されるデータセットを利用し、フルスクラッチで開発した。約19.5兆トークンのうち約10.5兆トークンを事前学習に使用し、別途中間学習と追加学習も実施した。

日本語の処理性能を測るベンチマーク「日本語MT-Bench」では、gpt-oss-20bに加え、OpenAIのAIモデル「GPT-4o」や、AlibabaのAIモデル「Qwen3-8B」のスコアを上回ったという。英語の性能についても、これら海外企業のAIモデルと同等以上とアピールしている。

NIIは今後、より大規模なパラメータを持つAIモデルの開発と並行し、軽量なAIモデルの開発も進める。これらのAIモデルは2026年度中に順次公開する予定だ。

LLM-jp-4 8BモデルとLLM-jp-4 32B-A3Bモデルの開発は、NIIの大規模言語モデル研究開発センターが主催するLLM研究開発コミュニティー「LLM-jp」の活動の一環として実施した。

【修正履歴:2026年4月4日午前11時30分 各モデルについて「Llama 2/Qwen3をベースに」と記載していましたが、学習対象である重みについてフルスクラッチ開発である旨を明記しました】

関連記事

Google、エージェント特化の「Gemma 4」をApache 2.0で公開

Google、エージェント特化の「Gemma 4」をApache 2.0で公開

Googleは、高性能オープンモデル「Gemma 4」をApache 2.0ライセンスで公開した。エージェント型ワークフローに特化し、最大25.6万トークンのコンテキストウィンドウに対応。モバイル向けの軽量版から31Bの大型モデルまで4種を展開する。AndroidやNVIDIAのGPUにも最適化され、ローカル環境での高度な推論を支援する。 LLMの学習データ「枯渇元年」にどう立ち向かうか 国・組織を横断したデータ連携の仕組み実現へ、IPAが成果物公開

LLMの学習データ「枯渇元年」にどう立ち向かうか 国・組織を横断したデータ連携の仕組み実現へ、IPAが成果物公開

AIの進化を支える高品質なデータの不足が懸念される中、IPAは2026年は「データ枯渇元年」になると説く。企業に眠る情報の活用が急務となる今、国境や組織を越えた新たなデータ連携の形「データスペース」を実現するための成果物が公開された。 東大、オープンソースの「四足歩行ロボ」 部品はオンライン発注可 階段を上がる姿など披露

東大、オープンソースの「四足歩行ロボ」 部品はオンライン発注可 階段を上がる姿など披露

東京大学は、オープンソースの四足歩行ロボット「MEVIUS2」を開発したと発表した。 楽天の最新AI、ベースは“中国DeepSeek製”? 担当者に聞いた

楽天の最新AI、ベースは“中国DeepSeek製”? 担当者に聞いた

「DeepSeekのAIモデルをベースに開発したのでは」――楽天グループの日本語LLM「Rakuten AI 3.0」を巡り、X上でこのような指摘が相次いでいる。楽天の担当者に話を聞いた。 LLM「Qwen3.5」の開発コアメンバーが突然の辞任 「オープンウェイト戦略は継続」、開発元のAlibabaがコメント

LLM「Qwen3.5」の開発コアメンバーが突然の辞任 「オープンウェイト戦略は継続」、開発元のAlibabaがコメント

オープンなLLM「Qwen3.5」シリーズの小型モデル発表直後に開発コアメンバーが辞任を発表したことで、ユーザーや開発コミュニティーから開発体制に対する不安の声が上がっている。同社はITmedia AI+の取材に対し「オープンウェイトモデル戦略は継続する」と回答した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.