Google、発話障害者をAIでサポートする「Project Euphonia」:Google I/O 2019

米Googleは5月7日(現地時間)、年次開発者会議「Google I/O 2019」の基調講演で、ALS(筋萎縮性側索硬化症)やパーキンソン病の患者など、発話が困難な人をAIでサポートするプロジェクト「Project Euphonia」を発表した。

ALS患者をサポートする米国の非営利団体ALS Therapy Development Institute(ALS TDI)やALS Residence Initiative(ALSRI)の協力の下、患者が一定のテキストを読み上げる音声データを収集し、発話障害のある人の発話を正しく聞き取るAIアルゴリズムの訓練に使っている。

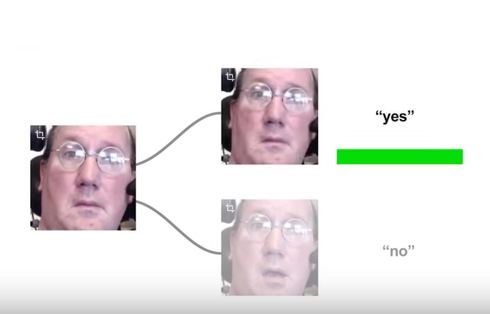

プロジェクトに協力しているALS患者のスティーブ・サイリング氏は、Googleが作った機械学習モデル訓練用ツールを使って、顔の表情でコミュニケートする方法をAIに教えている。

サイリング氏はこの方法で、テレビでスポーツ観戦中、ひいきのチームがゴールを決めたらホーンを鳴らしたり、部屋の照明を消したりすることに成功している。

一般的な音声AI同様、データが多いほどシステムの精度は上がる。Googleおよび協力団体は、障害を持つ人々にデータ提供を呼び掛けている。こちらから申し込める。

Project Euphoniaは、Googleが長年従事しているアクセシビリティの取り組みの一環だ。昨年のGoogle I/Oでは、Gboardでのモールス信号入力機能や目の不自由な人用の音声アプリ「Lookout」を発表した。今年の2月には、耳の聞こえない人のための、会話をリアルタイムでテキストに変換するアプリ「音声文字変換」を発表した。

今年のGoogle I/Oでは、Project Euphoniaの他に、スマートフォン上の動画や音声にリアルタイムで字幕を付ける「Live Caption」も発表した。

関連記事

Google I/O 2019まとめ 「AI for Everyone」、Pixel 3aも発表

Google I/O 2019まとめ 「AI for Everyone」、Pixel 3aも発表

Googleの年次開発者会議「Google I/O 2019」で発表されたことを時系列にまとめた。今年のテーマは「「Building a more helpful Google for everyone」。AI採用のアクセシビリティ機能や「Googleアシスタント」の新機能、手ごろな価格の「Pixel 3a」などが発表された。 Google、モバイル検索結果画像の3D→AR化機能や「Google Lens」の新機能を発表

Google、モバイル検索結果画像の3D→AR化機能や「Google Lens」の新機能を発表

Googleが開発者会議「Google I/O」でモバイル検索関連の新機能を発表した。検索結果の画像を3Dに、さらにはARにして表示する機能は5月中にローリングアウト予定。Google Lensも進化する。 言い間違いも直してくれるGoogleの「音声文字変換」、かなり使える

言い間違いも直してくれるGoogleの「音声文字変換」、かなり使える

Googleが早期アクセス版として公開した音声をリアルタイムで字幕にして表示する「音声文字変換」アプリを使ってみました。多少滑舌が悪くても意味が通るよう解釈してくれ、書籍タイトルなどもばっちり正しく表示してくれます。 Google、聴覚障害者向けリアルタイム字幕アプリ「Live Transcribe」と補聴アプリ「Sound Amplifier」

Google、聴覚障害者向けリアルタイム字幕アプリ「Live Transcribe」と補聴アプリ「Sound Amplifier」

Googleが、聴覚障害者向けの2つのアプリを発表した。リアルタイム字幕アプリ「Live Transcribe」(β)は日本語もサポートする。補聴アプリ「Sound Amplifier」はAndroid 9 Pie以降に対応する。 MicrosoftのスーパーボウルCMは障害者向けXboxコントローラで「We All Win」

MicrosoftのスーパーボウルCMは障害者向けXboxコントローラで「We All Win」

Microsoftが4年ぶりにスーパーボウル向けCMを公開した。「We All Win」と題し、昨年発売した障害者向けゲームコントローラ「Xbox Adaptive Controller」で遊ぶ子どもたちを紹介する。 「障害のある人にAIができること」 MicrosoftとGoogleのアクセシビリティ最前線

「障害のある人にAIができること」 MicrosoftとGoogleのアクセシビリティ最前線

Microsoftの「Build 2018」、Googleの「Google I/O 2018」――2社の年次開発者会議が続いた1週間。両社とも障害のある人を支援するAI活用の発表が印象に残りました。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR