Google I/O 2019まとめ 「AI for Everyone」、Pixel 3aも発表:Google I/O 2019

米Googleは5月7日(現地時間)、本社キャンパス近くの野外ホールShoreline Amphitheatreで年次開発者会議「Google I/O 2019」の基調講演を開催した。発表されたことを時系列にまとめる。

恒例のオープニング動画は、モノクロの「スター・トレック」の映像(Mr.スポックがコンピュータを操作する場面)から現代までのAIやロボットの進化を示すものだった(Pixel 3aのティーザーで採用した「アベンジャーズ/エンドゲーム」は基調講演の最後まで登場しなかった)。動画の最後のメッセージは「Keep making magic.(魔法を作り続けよう)」。

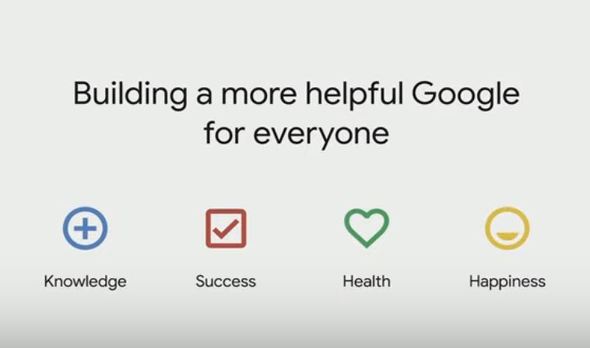

最初に登場したスンダー・ピチャイCEOは、Googleのミッションである「世界中の情報を整理し、世界中の人がアクセスできて使えるようにすること」を示し、「われわれは人々が答えを見つけることを助ける企業から、物事を成し遂げるのを助ける企業にシフトする」と語った。今年のI/Oのテーマは「Building a more helpful Google for everyone(すべての人々のためにより役立つGoogleを構築する)」だ。

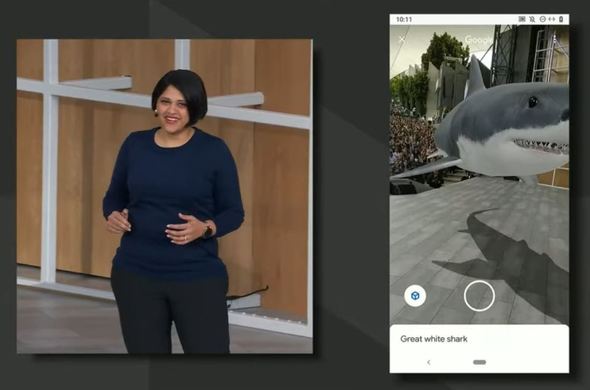

検索の3D AR機能

最初に紹介したのはGoogle検索で検索した動物や人体などの画像を3D化し、さらにARとして表示する新機能だ。例えば「白ザメ」を検索して画像をタップすると3D表示になり、さらにタップすると実物大のAR表示になる。ARにすることによって実際のサイズ(白ザメは約5.5メートル)を実感できる。

Googleはこの機能のためにNASA、New Balance、Samsung、Target、Visible Body、Volvo、Wayfairなどと提携した。これらの企業が扱う画像データで3D→ARが可能になる。

この機能は5月中にローリングアウトしていく見込みだ。

Google Lensの新機能(メニューからのお勧めピックアップや翻訳)

2017年のGoogle I/Oで登場した画像内情報検索AI「Google Lens」も進化する。

デモでは、レストランのメニューをスマホのカメラで写しながらGoogle Lensを起動すると、その店で人気のメニューがハイライトされる。ハイライトされたメニューをタップすると、そのメニューについてのレビューが表示される。

これは、位置情報からこのレストランを特定し、Googleマップのレビューからの情報を反映させることで実現している。

デモでは、レストランの請求書をカメラで写すとチップの計算を自動でする機能も紹介された。

さらに、軽量版検索アプリ「Google Go」でもGoogle Lensが使えるようになる。Google Goを使うような廉価版端末でもLensを使ってテキストの音声読み上げや翻訳が可能になる。この機能を使えば、例えば海外旅行先の看板などのテキストを読み取ってまず自国語に翻訳し、それを音声読み上げすることができる。

検索結果のAR化とGoogle Lensの新機能については別記事にまとめた。

DuplexがWebブラウザに

昨年のGoogle I/Oで評判を呼んだ「Duplex」が、Android端末のChromeブラウザやカレンダー、Gmailで使えるようになる。

デモでは、Webでレンタカーを予約する手順が紹介された。レンタカーのWebサイトを開いて複数のステップで予約する代わりに、「OK Google、次の出張のためにNational Car Rentalでレンタカーを手配」と音声で命令すると、Duplexがメールから“次の出張”の情報を集めて出張先のレンタカーオフィスを特定し、ユーザーの過去のレンタカー履歴から車種の候補まで提示した。

この機能は年内に英米の英語で利用可能になる見込み。

次世代Googleアシスタントはコンパクトで10倍速く

現行の「Googleアシスタント」がユーザーのリクエストを解析するには100GB程度のデータを必要とするが、次世代は0.5GBで理解するという。この進化により、Googleアシスタントは端末内でデータを処理できるようになり、オフラインでも利用可能で、しかも10倍速くなる。

デモでは様々な命令を矢継ぎ早に下すと画面がそれに対応する様子が紹介された。デモでは各命令の間に「OK Google」などのウェイクワードは言わなかった。

次世代Googleアシスタントは、今秋発売予定の次期Pixel端末(Pixel 4(仮))から利用可能になる見込みだ。

Gogoleアシスタントについてはこの他、個人情報に基づいて最適な返事をするパーソナライズドヘルプや「Android Auto」での機能なども紹介された。

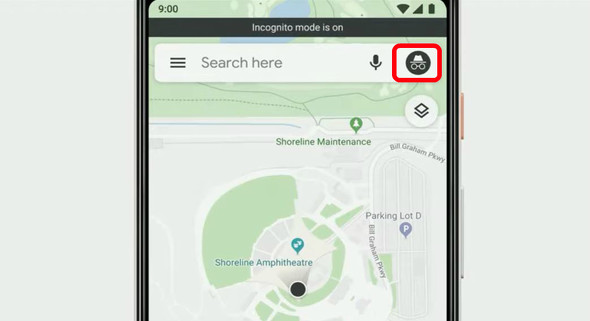

Googleマップにも「シークレットモード」

Chromeブラウザと「YouTube」で履歴を残さずにWebを使える「シークレットモード」が「Googleマップ」でも使えるようになる。目的地の検索などが履歴として残らない。

Googleは位置情報をオフにしていても追跡を続けているとして批判された後、プライバシー関連の機能を改善している。

先週には「Googleアカウント」で履歴の保存期間を選択できるようにした。

プライバシー関連の発表は別記事にまとめた。

アクセシビリティ関連(ライブ字幕やライブ音声読み上げ)

「for everyone」の一環として、アクセシビリティ関連の新機能も発表した。

「Live Caption」は文字通りライブで音声にキャプション(字幕)を付ける機能。2月に発表した「Live Transcribe(日本では「音声文字変換」)」と同様の技術を採用している。

スマートフォンでYouTube動画やInstagramの動画、Duoでの会話などの音声付き動画や、Podcastや音声チャットなどのオーディオが再生されると、Live Caption機能により自動的に字幕が表示される。この機能は80MBとコンパクトで、オフラインでも利用可能だ。

同様に、声を出せない人が電話にテキストを音声に変換する「Live Relay」も紹介した。

さらに、ALS患者など、会話が困難な人のための取り組み「Project Euphonia」で、個人の特定の声やしぐさを登録し、言語に“翻訳”する技術を開発していることも紹介した(別記事)。

Android Qは正式に「Android 10」に

「Android Q」と紹介されてきた次期Android OSが「Android 10」として新機能を紹介された。

折りたたみや5Gへの対応、ダークテーマ、セキュリティ機能、スマートリプライなどの機能のデモが行われた。

新しいAndroid Qのβ版はPixelだけでなく、ソニーやNokiaの端末でも試せる。

スマートディスプレイ「Nest Hub」と「Nest Hub Max」

Googleは昨年2月、NestをGoogleのハードウェアチームに統合した。リック・オステルロー上級副社長は基調講演で、Made by GoogleのハードウェアをNestブランドにまとめていく計画を発表した。

その一環として、昨年10月に発表した「Google Home Hub」を「Nest Hub」に改名した。日本でも発売する(価格はまだ不明)。

さらに、Nest Hubの上位モデルとして新たに「Nest Hub Max」を発表した。こちらは日本ではまだ発売されない。

詳細は別記事にまとめた。

Pixel 3aと3a XLの発表 日本でも発売

うわさされていたミッドレンジスマートフォン「Pixel 3a」と「Pixel 3a XL」も発表された。日本でも発売する(別記事)。

こちらも「Google for everyone」の一環。高価格なPixelシリーズの高機能をすべての人に届けるのが目的。現行の多くのハイエンドスマートフォンから消えた3.5ミリオーディオジャックを復活させたのも、無線イヤフォンを購入できない層への配慮のようだ。

日本を含む13の国と地域で同日から予約を受け付け、17日に発売する。価格はPixel 3aが4万8600円、Pixel 3a XLが6万円(いずれも税込)。

AIの取り組み

最後のプレゼンターは同社の広告技術からディープラーニングまで、幅広い製品の立ち上げに関わってきたGoogle Senior Fellowのジェフ・ディーン氏。汎用言語表現モデル「BERT(Bidirectional Encoder Representations from Transformers)」やTensorFlowの進捗、AIを医療や災害対策に生かすための取り組みになどについて語った。

ちなみに、予想していたゲームストリーミングサービス「Stadia」、VR関連、自動運転企業Waymoについては、少なくとも基調講演では触れられなかった。Waymoは1日目のセッションで進捗を報告し、Lyftとの提携を発表した。

基調講演の録画は既にYouTubeで公開されている。

関連記事

Google I/Oプライバシー関連まとめ──Chromeのcookie対策やシークレットモード

Google I/Oプライバシー関連まとめ──Chromeのcookie対策やシークレットモード

Google I/Oで発表されたプライバシー関連の取り組みをまとめた。「すべての人のためにより役立つGoogle」を目指すためにユーザーデータの収集は必要なので、データ収集に当たってはより安全に、透明性を強化していく。さらに、データを集めずに機械学習する「Federated Learning」も紹介した。 Google、発話障害者をAIでサポートする「Project Euphonia」

Google、発話障害者をAIでサポートする「Project Euphonia」

Google、モバイル検索結果画像の3D→AR化機能や「Google Lens」の新機能を発表

Google、モバイル検索結果画像の3D→AR化機能や「Google Lens」の新機能を発表

Googleが開発者会議「Google I/O」でモバイル検索関連の新機能を発表した。検索結果の画像を3Dに、さらにはARにして表示する機能は5月中にローリングアウト予定。Google Lensも進化する。 Google、新スマホは廉価版 「Pixel 3a/3a XL」発表 4万8600円から FeliCaも対応

Google、新スマホは廉価版 「Pixel 3a/3a XL」発表 4万8600円から FeliCaも対応

米Googleが自社開発の新型スマートフォン「Pixel 3a」「Pixel 3a XL」を発表した。価格を抑えた廉価版モデル。 Googleの自動車アプリ「Android Auto」、「ダークテーマ」などのアップデート

Googleの自動車アプリ「Android Auto」、「ダークテーマ」などのアップデート

Googleが、自動車向けアプリ「Android Auto」をアップデートした。画面のデザインを車のダッシュボードになじむ「ダークテーマ」にし、ナビ画面でのメディアアプリの操作バーや通知画面の改善が行われた。 「Nest Hub Max」発表 「Nest Hub」(旧Home Hub)は日本でも発売

「Nest Hub Max」発表 「Nest Hub」(旧Home Hub)は日本でも発売

Googleがスマートディスプレイのブランドを「Nest」に変え、「Google Home Hub」を「Nest Hub」に改名し、上位モデル「Nest Hub Max」を発表した。「Nest Hub」は日本でも発売する。 Google、ロケーションや検索履歴データの自動削除機能 3カ月か18カ月から選択可能に

Google、ロケーションや検索履歴データの自動削除機能 3カ月か18カ月から選択可能に

Googleが、ユーザーのロケーション履歴や検索履歴のデータを一定期間保存した後、自動的に削除できるようにする。「Googleアカウント」の管理ページで設定できるようになる。 「Android Q」のBeta 1公開 Pixelシリーズにインストール可能

「Android Q」のBeta 1公開 Pixelシリーズにインストール可能

Googleが次期モバイルOSを「Android Q」とし、最初のBeta版を公開した。初代からのすべてのPixel端末にインストールできる。位置情報などのプライバシーの強化や折りたたみ端末のサポートなど多数の新機能が盛り込まれる。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR