「AIと倫理は経営課題」弁護士が警鐘 「日本企業はもっと真剣に取り組むべき」(2/2 ページ)

「AIと倫理」 国内外の現状

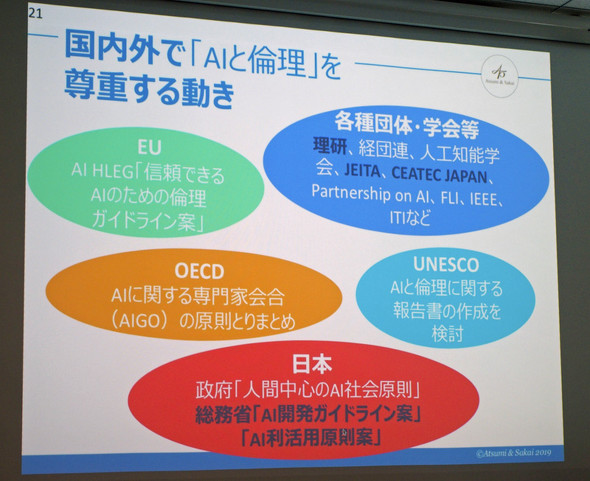

三部弁護士は「国内外でAIと倫理を尊重する動きが出ている」と話す。例えば、EU(欧州連合)の「信頼できるAIのための倫理ガイドライン案」、OECD(経済協力開発機構)の「AIに関する専門家会合の原則とりまとめ」、UNESCO(国際連合教育科学文化機関)の「AIと倫理に関する報告書の作成検討」などがこれに当たる。

米国ではGoogleやApple、Facebookなどが所属する非営利団体「Partnership on Artificial Intelligence to Benefit People and Society」や、Teslaのイーロン・マスクCEOなどが立ち上げた非営利のAI研究企業「OpenAI」など、企業主導の動きが目立つ。

日本では政府による「人間中心のAI社会原則」や総務省の「AI開発ガイドライン案」「AI利活用原則案」の他、人工知能学会や理化学研究所などの各団体で取り組みが進む。三部弁護士は「日本でも先進的な企業は原則作りを超えて研究開発の段階へ踏み出す企業が出てきているが、今後その動きは加速するだろう」と話す。

リスクを正しく認識する

世界的にこうした動きが目立つ中、今後日本企業はどのような取り組みが必要になるのか。「まずは自社が行うAI事業で発生しうるリスクの種類、内容、程度を把握して対策を立てることが重要だ」と三部弁護士は説明する。

自動運転なら安全性、個人の信用力を示すスコアリングなら平等性や透明性など、事業領域によってリスクと取るべき対策はおおよそ共通認識ができつつあるという。

こうした検討を、経営陣のみならず、開発、販売、法務、経営企画、人事など部門を越えてスムーズに進められる社内体制の構築が求められる。

「(AIと倫理は)社会全体で対応すべき問題だが、まずは企業ごとで対応していかざるを得ない。企業によって意識に差があるので、きちんと考えている企業は海外のパートナーと手を組みやすいなどのチャンスが生まれるだろう」(三部弁護士)

関連記事

Google、AI倫理諮問委員会「ATEAC」解散 メンバーに問題ありとの反対を受け

Google、AI倫理諮問委員会「ATEAC」解散 メンバーに問題ありとの反対を受け

Googleが、AI倫理原則順守目的として3月末に立ち上げた外部諮問委員会ATEACを早々に解散する。メンバーとして反LGBTQ発言を繰り返す保守系シンクタンクの所長やかつて米軍からドローンの仕事を請け負った企業のCEOを指名したことに内外からの批判が高まっていた。 GoogleはAI倫理の多様性のために「多様性の敵」を取り入れるべきか

GoogleはAI倫理の多様性のために「多様性の敵」を取り入れるべきか

AIの先端を行くGoogleが、自社のAIの取り組みについて監視・アドバイスしてもらう第三者諮問委員会を立ち上げ、わずか10日後に解散。何があったのか。 GoogleのAI諮問委員会ATEACに「待った」 反LGBTQなメンバー除名の署名運動

GoogleのAI諮問委員会ATEACに「待った」 反LGBTQなメンバー除名の署名運動

GoogleがAI倫理を守る目的で立ち上げた諮問委員会ATEACのメンバーとして、保守系シンクタンクの所長を指名したのは不適切だとして、Google従業員有志が除名を求める署名運動を開始した。 Google、AI倫理原則のための外部諮問委員会「ATEAC」立ち上げ

Google、AI倫理原則のための外部諮問委員会「ATEAC」立ち上げ

Googleが、昨年6月に発表したAI倫理原則を企業として順守するための外部諮問委員会を立ち上げた。年に4回会議を開催し、成果は報告書として一般公開する計画だ。 Google、「AIの倫理原則」を公開 武器など人に危害を加える利用はしないと約束

Google、「AIの倫理原則」を公開 武器など人に危害を加える利用はしないと約束

米国防総省とのAI技術関連契約で社内外から批判されているGoogleが、AIに関する倫理原則を発表した。武器など人に危害を与える技術にAIを使わないとしており、ピチャイCEOは「これはコンセプトではなく具体的な基準だ」と語った。 Apple、GoogleらのAI(人工知能)普及団体に参加

Apple、GoogleらのAI(人工知能)普及団体に参加

Appleが、GoogleやFacebookが立ち上げた人工知能普及団体「Partnership on AI」に創立メンバーとして参加する。同団体の評議員会には、イーロン・マスク氏らのAI団体「OpenAI」の研究員も参加する。 Microsoftの人工知能Tay、悪い言葉を覚えて休眠中

Microsoftの人工知能Tay、悪い言葉を覚えて休眠中

Microsoftが会話理解研究のために公開した人工知能botの「Tay」が、Twitterでのデビュー数時間後に停止した。ユーザーに教えこまれた人種差別などの問題のある単語をツイートするようになったためとみられる。 AI研究の「倫理」どうする? 人工知能学会、倫理綱領を策定へ

AI研究の「倫理」どうする? 人工知能学会、倫理綱領を策定へ

AI研究の倫理はどうあるべきか――人工知能学会は、AIの研究者・開発者が守るべき倫理綱領の素案を公表した。 「人類を滅亡させるわ」 人工知能ロボットがインタビューで宣言

「人類を滅亡させるわ」 人工知能ロボットがインタビューで宣言

米企業のAI搭載ロボット・Sophiaが「人類を滅亡させるわ」と発言して注目を集めている。 イーロン・マスク氏ら、人類に益する人工知能を目指す「OpenAI」立ち上げ アラン・ケイ氏も参加

イーロン・マスク氏ら、人類に益する人工知能を目指す「OpenAI」立ち上げ アラン・ケイ氏も参加

ピーター・ティール氏やイーロン・マスク氏などのPayPalマフィアの面々やY Combinatorのサム・アルトマン社長らが、人工知能(AI)を人類への脅威ではなく、人類に益する存在に発展させることを目的とした非営利の研究機関「OpenAI」を設立した。起業家らやAWS、Infosysなどが総額10億ドルを投じる。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR