ITmedia NEWS >

AI+ >

半沢直樹は東京中央銀行にAIを導入できるか? 技術導入の責任論を考える:マスクド・アナライズのAIベンチャー場外乱闘!(3/5 ページ)

» 2020年11月13日 16時00分 公開

[マスクド・アナライズ,ITmedia]

問題を起こしたAIを修正するだけでは、事態を収拾できないでしょう。金融業の社会的意義は大きく、AIに対する責任の所在や、世論の反発も予想されます。取引先や競合他社に対する面子もあり、監督する金融庁は沽券(こけん)にも関わります。

そこで最後に残るのは、責任や謝罪やケジメといった、いわば感情論です。

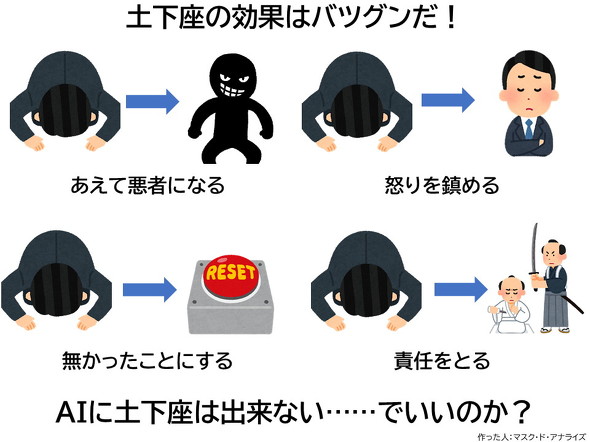

ここで半沢直樹における「土下座」という答えがあります。土下座はいわば最後の切り札。根本的な解決策ではありませんが、組織と感情の面では非常に有効です。

人間の土下座によって関係各所の留飲を下げることができても、AI自体は責任を取ることはできません。人間が退職すれば反感は収まりますが、AIを停止させても納得はしません。

理論ではなく感情が勝る場面において、責任を取れるのはAIではなく人間であり、土下座なのです。

テクノロジー利用の責任の取り方は東証のシステム障害会見に学べ

では、テクノロジーの利用における責任は、感情論としての土下座でいいのでしょうか。批判的な感情に対して、事態を収集させる手段は土下座だけでしょうか。

失敗すれば担当者をクビにして、別の人間にすげ替える罰ゲーム要員を配置しても、組織におけるデジタル化は進みません(ドラマでも銀行における減点主義が描写されており、失敗すれば出世どころか安定した地位さえも脅かされます)。

このような複雑化するITにおける責任問題について、一つの形を見せたのが東京証券取引所です。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PRアイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR