ITmedia NEWS >

社会とIT >

ELYZAが新たな日本語LLMを開発 「GPT-3.5 Turboにも匹敵」 チャット形式のデモサイトも公開

» 2024年03月12日 16時34分 公開

[松浦立樹,ITmedia]

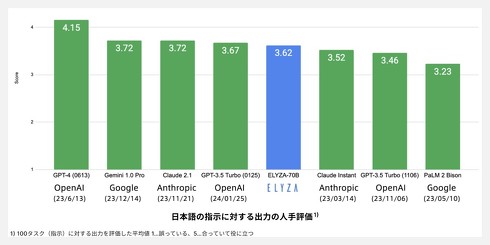

東大発のAIスタートアップ企業であるELYZA(東京都文京区)は3月12日、700億パラメータの大規模言語モデル(LLM)「ELYZA-japanese-Llama-2-70b」を開発したと発表した。日本企業のLLMの性能を大きく上回り、グローバルモデルの性能にも匹敵するという。このLLMを試せるチャット形式のデモ版も公開している。

同社が公開している日本語LLM性能を評価するベンチマーク「ELYZA Tasks 100」などで、開発したLLMの性能評価を行ったところ、日本企業が公開しているLLMの性能を大きく上回った。また、米OpenAIの「GPT-3.5 Turbo」シリーズや、米Anthropicの「Claude 2」シリーズ、米Googleの「Gemini 1.0 Pro」に匹敵する性能を達成したという。

同社は今回開発したLLMを皮切りに春以降、「ELYZA LLM for JP」シリーズと打ち出して、企業向けに順次提供を始める予定。

関連記事

ELYZA、新たな日本語言語モデルを一般公開 同社「日本語ならGPT-3.5を上回る性能」 商用利用も可

ELYZA、新たな日本語言語モデルを一般公開 同社「日本語ならGPT-3.5を上回る性能」 商用利用も可

東大発のAIスタートアップ企業であるELYZAは、商用利用可能な日本語の大規模言語モデル(LLM)「ELYZA-japanese-Llama-2-13b」を公開した。日本語性能の評価では「GPT-3.5(text-davinci-003)」を上回るという。 東京海上日動、生成AIで一部業務を約50%省力化 AIスタートアップ・ELYZAが協力

東京海上日動、生成AIで一部業務を約50%省力化 AIスタートアップ・ELYZAが協力

東大発のAIスタートアップ企業であるELYZAは、東京海上日動火災保険との言語生成AIの実証実験の結果、一部業務で約50%の省力化に成功したと発表した。 生成AIで電話応対を効率化 最大54%の時間削減に成功 ELYZAとJR西日本のコンタクトセンターの事例

生成AIで電話応対を効率化 最大54%の時間削減に成功 ELYZAとJR西日本のコンタクトセンターの事例

AIベンチャーのELYZAは、JR西日本のコンタクトセンターと共同で、言語生成AIを使って一部業務の効率化に成功したと発表した。月間で約7万件の電話問い合わせの応対記録を全てテキスト化しているが、AI導入したところ、対応時間を18〜54%削減できたという。 話題のチャットAI「Claude 3」のプロンプト集、公式が公開中 「Excelの数式作って」など64種

話題のチャットAI「Claude 3」のプロンプト集、公式が公開中 「Excelの数式作って」など64種

話題のチャットAI「Claude 3」について、提供元の米Anthropicは3月11日までに公式プロンプト集を公開している。「プロンプトライブラリ」と題したWebサイトで、全部で64種類の使用例を公開中。 今週、生成AI「Grok」をオープンソースにする──イーロン・マスク氏が発表 「OpenAIはうそつき」

今週、生成AI「Grok」をオープンソースにする──イーロン・マスク氏が発表 「OpenAIはうそつき」

米xAIは今週、生成AI「Grok」をオープンソースにする──同社を率いるイーロン・マスク氏は、X上にそのように投稿した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PRアイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR