リコー、モデルマージで“GPT-4レベル”の大規模言語モデル開発 プライベートLLMの開発効率化に貢献

» 2024年09月30日 13時53分 公開

[松浦立樹,ITmedia]

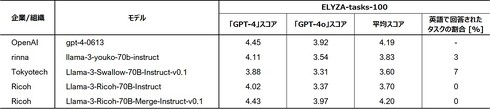

リコーは9月30日、モデルマージ技術によって高性能な日本語大規模言語モデル(LLM)を開発したと発表した。東京工業大学などが開発したLLM「Llama-3-Swallow-70B」をベースにしたAIモデルで、米OpenAIのLLM「GPT-4」と同等の性能を持つとしている。

モデルマージとは、複数の学習済みのLLMモデルを組み合わせて、より性能の高いモデルを作る方法のこと。

リコーは今回、Llama-3-Swallow-70Bをベースにしてモデルマージを実行。Metaの指示学習済みモデルから抽出した「Chat Vector」(AIモデルから抽出した指示追従能力のベクトルのこと)と、リコーが作成したChat Vectorを独自のノウハウでマージさせて、新たなLLMを開発した。

開発したLLMは、日本語性能の評価指標「ELYZA-tasks-100」でGPT-4と同等のスコアを記録。また、比較対象にした他のLLMでは、タスクによって回答を英語でする場合もあったが、リコー製のLLMは全てのタスクに対して日本語で回答し、高い安定性を示したという。

リコーは「AIを実際の業務に適用するには、企業固有の用語や言い回しなどを含む大量のテキストデータをLLMに学習させ、その企業独自のAIモデル(プライベートLLM)を作成する必要がある」と指摘。モデルマージ技術は、プライベートLLMや特定業務向けの高性能LLMの開発の効率化につながるとし、今後も研究開発を進める方針を示した。

関連記事

リコー、低コスト・高速うたう新LLM 日英中対応で今秋提供

リコー、低コスト・高速うたう新LLM 日英中対応で今秋提供

リコーは日英中3言語に対応した700億パラメータの大規模言語モデル(LLM)を開発したと発表した。 リコー、2000人規模の希望退職者を募集 理由は「収益性の改善ため」

リコー、2000人規模の希望退職者を募集 理由は「収益性の改善ため」

リコーは、同社とグループ会社で計2000人の希望退職者を募集すると発表した。国内で1000人と海外グループで1000人をそれぞれ募集する。 リコー、顧客情報3841件流出の可能性 発送業務の委託先がランサムウェア被害

リコー、顧客情報3841件流出の可能性 発送業務の委託先がランサムウェア被害

リコージャパンは、ノベルティ発送業務を委託している倉業サービスのサーバが不正アクセスを受けてランサムウェアに感染し、顧客情報や社員情報が流出した可能性があると発表した。 富士通、大規模言語モデル「Takane」提供開始 「世界一の日本語性能を持つ」とうたう

富士通、大規模言語モデル「Takane」提供開始 「世界一の日本語性能を持つ」とうたう

富士通は、カナダのAI開発企業Cohereと共同開発した大規模言語モデル(LLM)「Takane」の提供を始めた。同社はこのLLMについて「世界一の日本語性能を持つ」とうたっている。 AIは“コンマイ語”を乗り越えられるか 遊戯王「AI電脳戦」、開発エンジニアたちの舞台裏

AIは“コンマイ語”を乗り越えられるか 遊戯王「AI電脳戦」、開発エンジニアたちの舞台裏

2つのエンジニアチームが対戦用のAIを開発。実際に対戦させる様子をドキュメンタリー形式で描く。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

SpecialPR

SpecialPR

アイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR