リコー、日本語で“GPT-5と同等性能”うたう金融業務特化型LLMを開発

» 2025年10月10日 18時40分 公開

[松浦立樹,ITmedia]

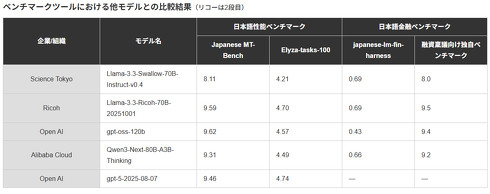

リコーは10月10日、GPT-5と同等の性能を持つ金融業務特化型LLMを開発したと発表した。同社が開発する700億パラメータのLLMに、有価証券報告書などから金融業特有の専門用語を学習させたもの。このLLMに対して、リーズニング性能を追加搭載したところ、特定の日本語ベンチマークにおいて米OpenAIのLLM「GPT-5」と同等の性能を記録したという。

リコーでは、米MetaのLLMをベースに、東京科学大学が日本語性能を向上させたモデル「Llama-3.3-Swallow-70B-v0.4」を採用。このモデルに対して、独自手法によるファインチューニングやモデルマージ、学習カリキュラムを組み合わせることで、700億パラメータの日本語LLMを開発。オンプレミス環境で、企業固有の情報を追加学習できるプライベートLLMとして提供している。

今回リコーでは、こうして開発したLLMを元に、金融情報に特化した金融業務特化型LLM「Llama-3.3-Ricoh-70B-20251001」を開発した。このモデルに対して、多段推論能力(CoT)を付加することで専門業務の遂行能力を強化。ベンチマーク「ELYZA-tasks-100」などを使い、日本語性能を評価したところ、GPT-5などの他社モデルと同等レベルのスコアを記録した。

リコーでは今後、製造業や医療などの業種特化モデルの開発も進めていく。

関連記事

リコー、“GPT-4o並み”の日本語性能持つLLMを開発 企業の「プライベートLLM」として導入へ

リコー、“GPT-4o並み”の日本語性能持つLLMを開発 企業の「プライベートLLM」として導入へ

リコーは、米OpenAIのAIモデル「GPT-4o」と同等の日本語性能を持つLLMを開発したと発表した。複数の学習済みのAIモデルを組み合わせ、より性能の高いモデルを作る手法「モデルマージ」で開発したという。 リコー、プリンタや複合機の“フルタイム保守”を廃止へ 24時間・365日から縮小

リコー、プリンタや複合機の“フルタイム保守”を廃止へ 24時間・365日から縮小

リコージャパンは、プリンタや複合機などの休日や夜間での保守対応を10月1日から縮小・廃止すると発表した。 日本が“AI競争”で海外に勝つには?──Sakana AIデビッド・ハーCEOの見方 「ソブリンAI」「和製LLM」はどう捉える

日本が“AI競争”で海外に勝つには?──Sakana AIデビッド・ハーCEOの見方 「ソブリンAI」「和製LLM」はどう捉える

Sakana AIデビッド・ハーCEOがITmedia AI+の単独取材に応じた。“AI競争”において、日本勢は海外とどう差別化すべきか。その考えのもと、Sakana AIは今後どんな方向性を目指すのか。同氏へのインタビューから手掛かりを探る。 GPT-5は“期待外れ”だった? 「革新的ではない」「keep4o」 最新AIモデルのマーケティングの難しさ

GPT-5は“期待外れ”だった? 「革新的ではない」「keep4o」 最新AIモデルのマーケティングの難しさ

米OpenAIは待望の新AIモデル「GPT-5」を発表した。しかし満を持してリリースされたこの次世代モデルは、技術的な進歩とは裏腹に、ユーザーから前例のない批判の嵐に見舞われた。なぜGPT-5は、歓迎されなかったのだろうか? “引っ張ると縮む”新機構「カウンタースナッピング」とは? オランダの研究者らが発表

“引っ張ると縮む”新機構「カウンタースナッピング」とは? オランダの研究者らが発表

オランダのAMOLF研究所とナノリソグラフィー先端研究センター(ARCNL)などに所属する研究者らは、従来の物理的直感に反する「引っ張ると縮む」という機構を提案した研究報告を発表した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

SpecialPR

SpecialPR

アイティメディアからのお知らせ

SpecialPR

あなたにおすすめの記事PR