ディープラーニングで急激に進化――意外と奥が深い「音声合成」の世界:週末エンプラこぼれ話(2/2 ページ)

当時NTTが研究していたのは、隠れマルコフモデル(Hidden Markov Model)と呼ばれる確率モデルを用いた音声合成だった。これは、周波数や持続時間などの組み合わせを機械学習で覚えさせ、音声波形を生成(推定)するもので、少量の音声から短期間で人の声を再現できるようになったという。

「声優さんの負担も少なくなりましたし、録音から2週間くらいでシステムが完成するようになりました。製作費も数十万程度にまで下がったのですが、声質や抑揚といった点では波形接続方式にかなわず、特に想定したシナリオから外れたような言葉をしゃべらせようとすると、機械っぽさが出てしまうのが難点でした」(鳥居さん)

「音声合成×ディープラーニング」の可能性

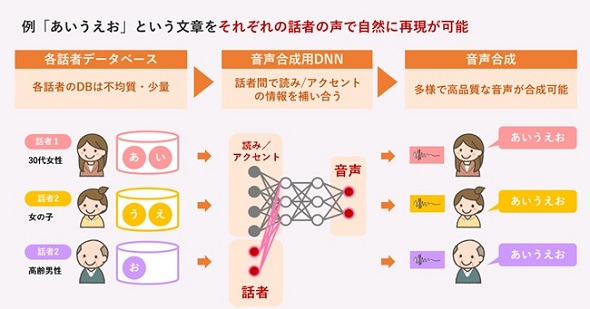

そこで研究者たちが目を付けたのが「深層学習(ディープニューラルネットワーク=DNN)」だ。NTTでも4年ほど前から研究を重ねており、2017年12月に音声合成ソフトウェア「FutureVoice Crayon」に実装した。同社が持つ音声データベースを学習に活用することで、話者の音声データが少なくても、他人のアクセント情報などを補い、自然な音声合成を実現するという。

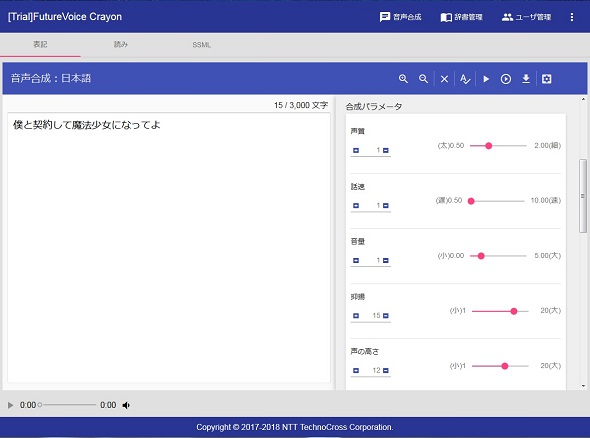

FutureVoice Crayonはクラウドサービスで、50パターン以上のバリエーションを利用でき、声の太さや高さ、抑揚などをパラメータとして変更することも可能だ。日本語以外にも英語やドイツ語、フランス語をはじめとした10言語に対応しており、30分程度の録音でも人間の声と遜色ないような高品質な音声合成が行えるという。

「NTTドコモの対話サービス『おしゃべり』やヴイストンのロボット『Sota』などに、この技術を提供しています。外国語にも対応しているので、増え続けている訪日外国人向けへのサービスなどへの応用も考えられます。最近では、キャラクターやロボットのオリジナルの声を作りたいという引き合いが強いですね」(鳥居さん)

NTTだけではなく、AppleやMicrosoftといった巨大ITベンダーも機械学習による音声合成に取り組んでおり、人工知能やロボットの普及によって、その需要は高まり続けている。地方ラジオ局でのニュース読み上げにも導入された例からは、労働力減少への対策になる可能性も感じられる。現在急速に音質が向上している音声合成だが、まだまだ進化の余地はあると鳥居さんは言う。

「ある程度クリアな30分以上の音声をベースに、人間がチューニングを行わないと、質の良い声を再現できないのが、今の技術の限界です。将来的には、少し話した音声をベースに、自動的に質の良い似た声を作れるようになるでしょう。他にも、翻訳技術と組み合わせて、日本語を話した“その人”の声で、自動的に外国語が話せるようなことが実現する日も、案外遠くはないかもしれません」(鳥居さん)

関連記事

NTTの音声合成ソフト、深層学習で自然な声を実現 ナレーションや書籍の読み上げに期待

NTTの音声合成ソフト、深層学習で自然な声を実現 ナレーションや書籍の読み上げに期待

NTTテクノクロスが、NTTのAI技術corevoを活用した音声合成ソフトウェア「FutureVoice Crayon」の新バージョンを発表した。DNNによる深層学習を活用した音声合成によって、自然で滑らかな音声を実現した。 レーザー照射で野菜の産地が分かる? NTTの新技術にびっくり

レーザー照射で野菜の産地が分かる? NTTの新技術にびっくり

NTTテクノクロス、ザファーム、エス・アイテックスの3社が、野菜のネット販売のプロジェクトを共同で展開。この中でNTTテクノクロスが、野菜の産地を「科学的」に証明する新技術を使っている。高速通信を実現するための技術をどう転用したのだろうか。 人工知能と人が、本当の意味で“話せる”ようになる日

人工知能と人が、本当の意味で“話せる”ようになる日

昨今「Watson」や「りんな」など、人間と会話ができる人工知能が注目を集めている。しかし、これらは人間の心を理解してコミュニケーションを取っているかというと、そうではない。いつか本当に人工知能と人が心を通わせるような時代は来るのか。人間と雑談できる対話システムを開発し続ける第一人者に話を聞いた。 そのWebページ、“みんな”が読めますか――企業が知るべき「Webアクセシビリティ」とは?

そのWebページ、“みんな”が読めますか――企業が知るべき「Webアクセシビリティ」とは?

インターネットが当たり前のインフラになった今、「誰でも同じように情報にアクセスできる」というテーマに再び注目が集まっている。その1つが「Webアクセシビリティ」だ。最近ではクラウドがその普及の後押しをしているのだという。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

アイティメディアからのお知らせ

人気記事ランキング

- 「AIを使えば全員同じになる」 羽生善治九段が語るAI時代の差別化と意思決定

- やはりClaude Codeの品質は下がっていた Anthropicが調査し特定した3つの要因

- 「日本のDXは期待外れ」が64% 世界平均を大きく上回るとGartnerが警告

- Anthropicの新指標 AIの影響を受けにくい「3割の人々」の共通点は?

- NECが人材育成サービスを刷新 「今後必要とされる人材像」を再定義した背景

- 「Windows+R」は絶対に押さないで! 新入社員に贈るセキュリティの新常識5選

- AI活用で足らないのは「ビジョン」や「熱量」じゃない 経営層と現場で拡大する“ズレの正体”

- NTTデータが「商品企画AI」を発表 社内データを基に150秒でコンセプト生成

- Windowsのリモートデスクトップ接続が刷新 情報の自動共有は「原則禁止」に

- メインフレーム「IBM Z」は51%増、全事業セグメントが増収 IBMが2026年Q1決算を発表