Appleの空間オーディオがDolby Atmosから逸脱し始めた いったい何のために?(3/3 ページ)

Apple Musicだけ異なる音で再生される?

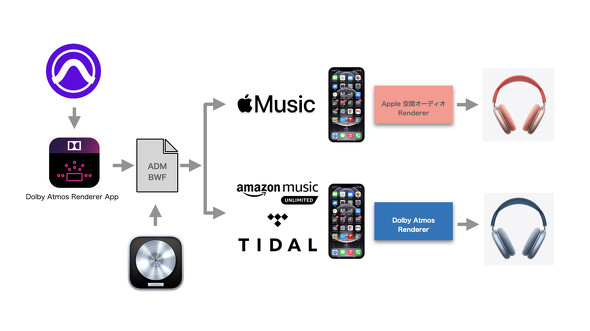

実は、Appleの空間オーディオは、厳密な意味でのDolby Atmos Musicとは言えない部分がある。Dolby Atmos音源の再生に対応はしているものの、ヘッドフォンでの再生時は、独自仕様のレンダリングエンジンを使用しており、Dolby Atmosの仕様に準拠した音源を制作者の意図通りに再生できない可能性があるのだ。

音楽制作者の間ではこの独自仕様が原因でちょっとした混乱が起きている。というのは、同じくDolby Atmos音源に対応しているAmazon Music UnlimitedとTidalは、Dolby Atmosの仕様に正しく準拠しているため制作者が同一の音源を3者に提供した場合、Apple Musicだけ異なる音像やミックスで再生されるというのだ。

通常のステレオ音源に加え、Dolby Atmos音源を用意するだけでも、たいへんなリソースを必要とするのに、さらにApple Musicだけに特化したDolby Atmosミックスを別途作成するのはあまりにも手間がかかる。

多くのDolby Atmos音源制作者は、Pro Toolsとドルビー研究所の「Dolby Atmos Renderer」で音源を制作している。この組み合わせでレンダリングした音源では、Apple Musicにおけるヘッドフォン再生においてイメージ通りの音にならない可能性がある。

だからといって、約6000万人(2019年時点)とも言われるApple Musicのユーザーを無視するわけにはいかないのが悩ましいところだ。まるで踏み絵のようだ。

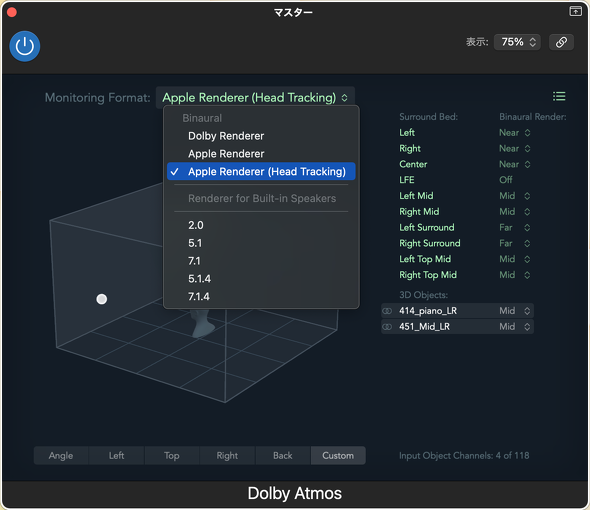

もし、Apple Musicだけ個別に対応する体力と気力(?)があれば、macOS 12.3の公開と同時に10.7.3にアップデートしたLogic Proで別途ミックスを行うという方法もある。Logic Pro 10.7.3であれば、Apple独自のレンダリングによる音でモニタリングできるからだ。

「ステレオを空間化」で、Dolby Atmosは不要か?

では、なぜAppleは、Dolby Atmosという優れたイマーシブオーディオのフォーマットからあえて逸脱するような所業に及んだのだろうか。これは筆者の推測だが、Appleが2023年にも発売するのではないかと噂されている「ARメガネ」を視野に入れた動きだと睨んでいる。

冒頭でも述べたように、音楽にまでヘッドトラッキングのような没入型の技術を適用してくるその背景を考察すると、ARメガネにおける音のユーザー体験として、ヘッドトラッキングが重要な意味を持つのではないのか。そのための布石であろう。

2021年に登場したiOS 15は、FaceTimeで空間オーディオを利用することができる。交信相手の方向から声が聞こえてくるこの機能は、ARメガネにこそ必須とされる機能だ。イヤフォンによる没入型オーディオ機能をApple側で完全にコントロールするためには、Dolby Atmosの仕様から一部逸脱しても独自のレンダリングエンジンを実装することこそが得策であるとの判断ではないのか。

このように、音楽制作者に混乱をもたらしているApple独自のレンダリングエンジンではあるが、リスナー視点で見ると大いなるメリットもある。というのは、iPhoneと空間オーディオ対応イヤフォンの組み合わせであれば、ステレオ音源を「ステレオを空間化」して擬似的な空間オーディオとして聴くことができるからだ。もちろん、ヘッドトラッキングも可能で、まさに、独自仕様のたまものと言っていい。

これがまたよくできており、しっかりと音楽に没入できる。というわけで本稿の最後に、音楽制作者の立場で叫ばせてもらう。「ステレオを空間化」があれば、Dolby Atmos音源なんていらないじゃん!(最大でも16トラック程度のアコースティック系音源を主に制作する者の心の叫びであり、打ちこみ等による凝ったトラック制作は除く)

山崎潤一郎

音楽制作業の傍らライターとしても活動。クラシックジャンルを中心に、多数のアルバム制作に携わる。Pure Sound Dogレコード主宰。ライターとしては、講談社、KADOKAWA、ソフトバンククリエイティブなどから多数の著書を上梓している。また、鍵盤楽器アプリ「Super Manetron」「Pocket Organ C3B3」「Alina String Ensemble」などの開発者。音楽趣味はプログレ。Twitter ID: @yamasakiTesla

関連記事

ホールでの録音をデジタルツインによる空間オーディオでシミュレートしてみた(作例付き)

ホールでの録音をデジタルツインによる空間オーディオでシミュレートしてみた(作例付き)

Logic Proの空間オーディオ機能を活用し、モデリング音源と仮想マイクでホール収録を再現する試み。 時と場所を選ばない空間オーディオ制作は可能か? M1 MacとLogic ProでDolby Atmos作品を作ってみた

時と場所を選ばない空間オーディオ制作は可能か? M1 MacとLogic ProでDolby Atmos作品を作ってみた

レーベルを運営する筆者が、M1 MacBook ProとLogic Proを使って自社の作品をDolby Atmos空間オーディオに対応させる過程をお見せする。 Logic ProのDolby Atmos対応は「空間オーディオ民主化」への第一歩 3次元空間でのランダムトレモロを体験してみないか?

Logic ProのDolby Atmos対応は「空間オーディオ民主化」への第一歩 3次元空間でのランダムトレモロを体験してみないか?

Appleの音楽制作ソフト「Logic Pro」に待望の空間オーディオオーサリング機能がついた。その担当者に詳しい話を聞いた。 音楽ファン歓喜の時代がやってきた! 人類が「空間オーディオ」を手に入れ、ステレオを卒業する日が

音楽ファン歓喜の時代がやってきた! 人類が「空間オーディオ」を手に入れ、ステレオを卒業する日が

Appleが第3世代「AirPods」を発表した翌日にAmazonが動いた。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR