コード専用生成AI「WizardCoder」、米Microsoftが公開 ベースはCode Llama、高い精度を達成:Innovative Tech

Innovative Tech:

このコーナーでは、2014年から先端テクノロジーの研究を論文単位で記事にしているWebメディア「Seamless」(シームレス)を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

Twitter: @shiropen2

米Microsoftなどに所属する研究者らは、米Metaが最近リリースしたCode LLM(コーディング専用大規模言語モデル)「Code Llama」をベースにしたコード専用生成AI「WizardCoder」を発表した。

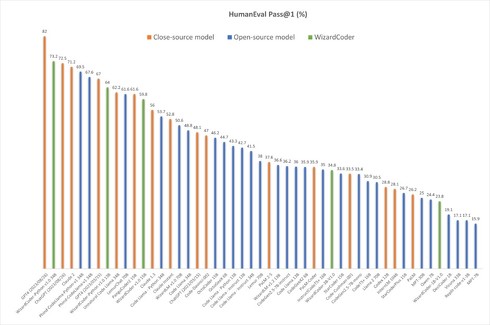

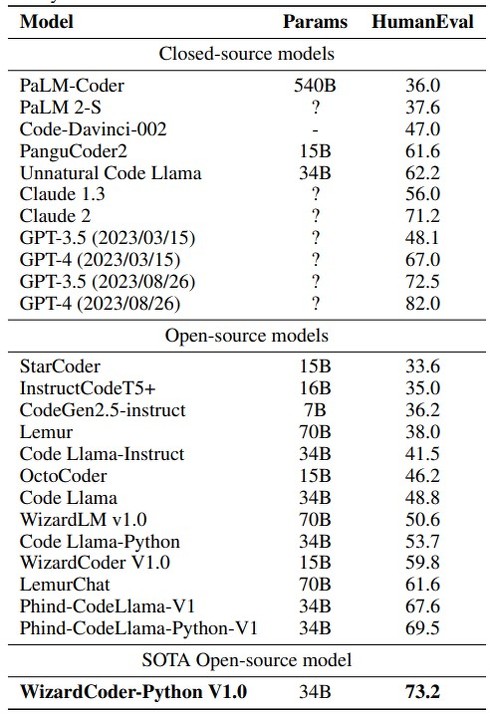

LLMの性能を評価するベンチマーク「HumanEval Benchmark」で、ChatGPT(GPT-3.5)やClaude2を上回る高い精度73.2%を達成し、存在感を示した。唯一下回ったのは、8月26日に同研究者らが計測したGPT-4(82.0%)のみ。ただし、3月に米OpenAIの公式テクニカルレポートが報告したGPT-4の数値67.0は上回っている。あくまでHumanEval Benchmarkによるものであることは留意したい。

今回のWizardCoderは、モデル名「WizardCoder-Python-34B-V1.0」としてGitHubやHugging Faceで公開されている。「WizardCoder-Python-13B-V1.0」も公開されている。

HumanEval Benchmarkの計測結果。GPT-3.5とGPT-4は2つあるが、3月15日分はOpenAIのGPT-4公式レポートによって報告されたもの。8月26日は、同研究者らが最新のAPIで計測した結果という

HumanEval Benchmarkの計測結果。GPT-3.5とGPT-4は2つあるが、3月15日分はOpenAIのGPT-4公式レポートによって報告されたもの。8月26日は、同研究者らが最新のAPIで計測した結果という同研究者らは、先月にも米Hugging Face開発のCode LLM「StarCoder」をベースにしたWizardCoderをリリースしており、オープンソースCode LLMの中では最も高い精度を達成していた。

これは、より正確に人間の指示に従うように微調整する「指示チューニング」(instruction-tuning)をStarCoderに適応させたモデルになる。プログラム作成の指示に対して、非常に精度高く動作するように訓練される。方法として「Evol-Instruct」という手法を使って、コード生成に特化した指示データを生成している。

Source and Image Credits: Luo, Ziyang, Can Xu, Pu Zhao, Qingfeng Sun, Xiubo Geng, Wenxiang Hu, Chongyang Tao, Jing Ma, Qingwei Lin, and Daxin Jiang. “WizardCoder: Empowering Code Large Language Models with Evol-Instruct.” arXiv preprint arXiv:2306.08568(2023).

関連記事

米Microsoftら、“コーディング専用”大規模言語モデル「WizardCoder」開発 文章から高品質なコード出力

米Microsoftら、“コーディング専用”大規模言語モデル「WizardCoder」開発 文章から高品質なコード出力

米Microsoftや香港浸会大学に所属する研究者らは、米Hugging Faceが5月に発表したCode LLM(コーディング専用大規模言語モデル)「StarCoder」を軽量で高精度に強化する手法を提案した研究報告を発表した。 “数学特化”の大規模言語モデル「WizardMath」 米Microsoftなどが開発 Llamaモデルを強化

“数学特化”の大規模言語モデル「WizardMath」 米Microsoftなどが開発 Llamaモデルを強化

米Microsoftと中国科学院に所属する研究者らは、数学的推理能力を強化するモデルを提案した研究報告を発表した。 Google検索の生成AI機能「SGE」、日本語版提供開始

Google検索の生成AI機能「SGE」、日本語版提供開始

Googleは、米国では5月から提供しているGoogle検索の生成AI機能「SGE」の日本語版の提供を開始した。競合するMicrosoftの「新しいBing」と同様、試験運用という位置づけだ。 東大発AIベンチャー、最大級の日本語LLM公開 metaの「Llama 2」を日本語化

東大発AIベンチャー、最大級の日本語LLM公開 metaの「Llama 2」を日本語化

AIスタートアップのELYZAは29日、日本語LLM(大規模言語モデル)「ELYZA-japanese-Llama-2-7b」を公開した。 “1那由他”通りの味を再現できる装置 ワインや梅干しの品種や産地も 生成AIで料理写真からも「きっとこんな味」

“1那由他”通りの味を再現できる装置 ワインや梅干しの品種や産地も 生成AIで料理写真からも「きっとこんな味」

明治大学の宮下芳明研究室が10の60乗(1兆を5回かけた大きさ)通りの味を再現できる装置を開発したと発表した。基本となる5つの味(甘味、酸味、塩味、苦味、うま味)や辛味などの味を与える液体を組み合わせることで、さまざまな味を再現できる。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR