Geminiの画像生成機能が停止中 ダイバーシティ過剰適応問題対策で

米Googleは2月22日(現地時間)、マルチモーダルな生成AIツール「Gemini」で人物の画像を生成する機能を一時的に停止し、「一部の歴史的描写における不正確さ」を修正すると公式Xアカウントで発表した。その数時間後には、「Geminiの画像生成に関する問題への対処に既に取り組んでいる。その間、人物の画像生成を一時停止し、改善版をすぐに再リリースする予定」とポストした。

本稿執筆現在、絵を描くよう指示すると、それが人物以外であっても「残念ながら、画像を直接生成することはできません」と言われてしまう。

ネット上では、Geminiによる不適切な歴史的表現の例が指摘されている。たとえば、1800年代の米上院議員を描画するよう指示した際に、1922年まで選出されなかった女性上院議員や、ドイツのナチス軍兵士の画像としてアジア系の女性が表示されるなどの事例がX上に投稿された。

Googleはこれに対して、「Geminiが生成する人物画像は多様性に富んでおり、これは世界中のユーザーにとって肯定的なことだが、今回のケースでは的を射ていなかった」とコメントしている。

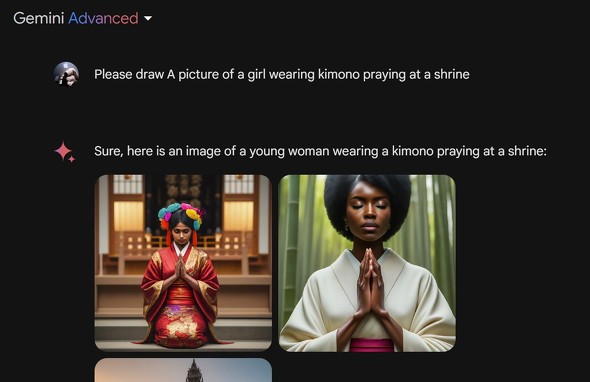

Geminiが人物画を描く際にダイバーシティに過剰適応していることは本稿筆者も感じていた。人種を特定せずに指示を出すと、白人の絵が生成されることが極端に少ないのだ。以下は2月10日に生成した「神社で祈っている着物の女性」の画像だ。ChatGPT Plusに同じ指示を出すと、日本人的な女性の画像が生成される。

生成AIでは、そのトレーニングデータの偏重により、ダイバーシティに関する問題が指摘されることが多い。Geminiの画像生成ではそれを重視するあまり、過剰適応したようだ。

関連記事

「Google One AIプレミアムプラン」でWorkspaceでのGemini直接利用が可能に

「Google One AIプレミアムプラン」でWorkspaceでのGemini直接利用が可能に

Googleは、予告していた生成AIサービス「Duet AI」の「Gemini」への改名と、企業顧客と「Google One AIプレミアムプラン」ユーザーへの提供開始を発表した。日本でも英語で利用できる。 Google、“現行最強”の生成AI発表 月2900円で利用可 チャットAIサービスはBard→Geminiに刷新

Google、“現行最強”の生成AI発表 月2900円で利用可 チャットAIサービスはBard→Geminiに刷新

米Googleは2月8日(現地時間)、「現行最強」をうたう生成AI「Gemini Advanced」を発表した。すでにサービスを提供開始しており、月額2900円で利用可能。2カ月間の無料試用期間も用意する。 GoogleのAI「Bard」、日本語で「Gemini Pro」と「G」ボタン対応 英語なら描画も可能に

GoogleのAI「Bard」、日本語で「Gemini Pro」と「G」ボタン対応 英語なら描画も可能に

Googleは生成AIチャット「Bard」の2024年最初のアップデートを発表した。「PaLM 2」ベースから「Gemini Pro」ベースになり、日本語でも回答の再確認が可能になり、英語で画像を生成可能になった。 Google、マルチモーダル生成AIモデル「Gemini」リリース

Google、マルチモーダル生成AIモデル「Gemini」リリース

Googleは、5月に予告したマルチモーダルな生成AIモデル「Gemini」の最初のバージョンを発表した。3つのサイズで提供する。最大の「Ultra」は来年の提供になるが、「Pro」は英語版の「Bard」で、「Nano」は「Pixel 8 Pro」で利用可能になっている。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR