無断転載防止の切り札? 自分のデジタル作品に“来歴情報”を埋め込む、Adobeの無料ツールを試す:小寺信良の「プロフェッショナル×DX」(2/2 ページ)

どのように機能するか

本サイトもそうだが、一般に記事中で使用する写真は、オリジナル解像度のものを原稿とともに編集部に入稿すると、編集部が記事ページを作る際に適切なサイズにリサイズして掲載する。つまり何らかの編集と再保存行為が行われるわけである。

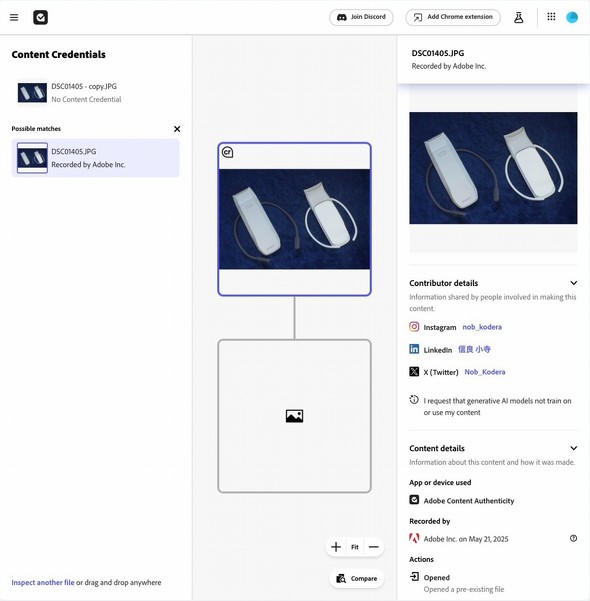

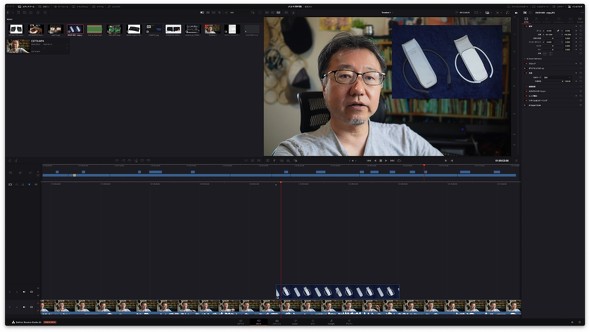

この段階で、画像に埋め込まれたCC情報は削除されてしまう。再保存した画像を「Instect」しても、情報なしと表示される。だがサムネイルの下の「Search for passible matches」をクリックすると、先に登録したオリジナルの画像と登録情報が表示される。

もう少しひどい例を試してみよう。このリサイズされた画像のスクリーンショットを取り、動画の中にPinPしてみた。そしてその画面をスマートフォンのカメラで再撮した。

この画像を「Instect」し、同じく「Search for passible matches」で探してみたところ、無事オリジナル画像にたどり着いた。情報を判別する技術としては、メタデータ、フィンガープリント、ウオーターマークを組み合わせている。複製や加工によってどれかの情報が欠けても、他の情報を元に判別できる。

つまり他人の記事の写真を無断で拝借して自分の動画の中に使うYouTuberがいても、視聴者の誰かがその画面を写真に撮ってACAのサイトで確認すれば、誰の写真を盗んだのかが分かる。CCの情報をたどってSNSに連絡してくれれば、著作権者本人がそのYouTuberに対して何らかの法的手段を取ることができる。

こうした利用に関連して、もう少し別の使い方も考えられる。例えばメーカーが自社製品の広報のために利用していい写真にCCを付けておいてくれると、われわれ記事を書く側も入手方法に頼らず、記事中に使用可能なものなのかどうかが判断できる。

ただ、現時点でβ版のACAでは、法人著作の情報を付加することができないようだ。LinkedInのペルソナ機能は、その名の通り個人しか認証できないからである。法人著作の場合は、別の企業認証の方法を考える必要がある。

他方で多くのクリエイターが気にしているのは、自分の作品が無断でAIに学習されることであろう。ACAには「I request that generative AI models not train on or use my content.」のチェックボックスがあるが、これはあくまでもコンテンツ側の意思表示として機能しているだけで、AIに学習させないという技術的、あるいは法的拘束力は持たない。このチェックがある画像をAIが学習しないようにするには、AIモデルの開発者側の対応が必要になる。

すでに現段階でこのような「AIに学習されない手段」としては、画像にノイズを加えることで学習させないという強制的な解決方法や、「AIに学習されない権利」の創出といった議論が進み始めている。ただその前に、意思表示とその尊重というきれいな関係が、一度きちんと構築されるべきだろう。この点においては、まずクリエイター側から意思表示しておくことは重要である。

関連記事

Adobe、コンテンツの生成AIトレーニング使用を拒否できる「Content Authenticity」提供へ

Adobe、コンテンツの生成AIトレーニング使用を拒否できる「Content Authenticity」提供へ

Adobeは、クリエイターが作品のAIによる無断使用を防ぐためのWebアプリ「Adobe Content Authenticity」を発表した。2025年第1四半期に、無料の公開β版として提供する計画だ。 “誰が作ったか”をデジタル作品に埋め込めるWebアプリ、Adobeがパブリックβとして公開

“誰が作ったか”をデジタル作品に埋め込めるWebアプリ、Adobeがパブリックβとして公開

米Adobeは4月24日(現地時間)、クリエイターが画像に帰属情報を埋め込む「コンテンツクレデンシャル」を付与できるWebアプリ「Adobe Content Authenticity」をパブリックβとして公開した。生成AIの普及で作品の出所判断が難しくなる中、“誰が作ったか”を示す電子透かし機能を無償提供する。 アドビの生成AI「Firefly」正式リリース、商用利用OK 無料でも利用可能

アドビの生成AI「Firefly」正式リリース、商用利用OK 無料でも利用可能

アドビが生成AI「Adobe Firefly」の一般提供を開始した。同社は6カ月間ほどβ版としてFireflyを提供してきたが、これまでは商用利用は不可となっていた。今回の正式提供により商用利用も可能となる。 生成画像で知財トラブルあればアドビが補償 画像生成AI「Adobe Firefly」にエンタープライズ版

生成画像で知財トラブルあればアドビが補償 画像生成AI「Adobe Firefly」にエンタープライズ版

米Adobeは6月8日(現地時間)、画像生成AI「Adobe Firefly」のエンタープライズ版を2023年下半期に提供すると発表した。「Creative Cloud」「Adobe Express」に加え、CMSソリューション「Adobe Experience Mnager」に、商用利用できる画像生成、編集機能を提供するという。 応用情報技術者試験に「生成AIと著作権」出題 あなたは解ける? SNSでは「サービス問題」との声も

応用情報技術者試験に「生成AIと著作権」出題 あなたは解ける? SNSでは「サービス問題」との声も

情報処理推進機構(IPA)が4月20日に実施した「応用情報技術者試験」午前の部で、生成AIと著作権に関する選択式の問題が出題された。

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR