ドローンは“プロジェクターが映した人”を人間と間違える? 早稲田大などが調査 対策法も提案:Innovative Tech

Innovative Tech:

このコーナーでは、2014年から先端テクノロジーの研究を論文単位で記事にしているWebメディア「Seamless」(シームレス)を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

X: @shiropen2

早稲田大学と産業技術総合研究所に所属する研究者らが発表した論文「DeGhost: Unmasking Phantom Intrusions in Autonomous Recognition Systems」は、プロジェクターで投影する人や車などで物体認識システムを欺くことができるかを分析し、対応手法を提案した研究報告である。

自動運転車やドローンなどの自律システムは、物体認識システムを用いて周囲の環境を認識し、適切な動作を行っている。しかし、この物体認識技術には「幻影攻撃」(Phantom Attack)と呼ばれる新たな脆弱性が存在する。

幻影攻撃とは、プロジェクターを使って人や車などの物体を模した映像を投影し、自律システムの物体認識機能に混乱を引き起こす攻撃手法である。攻撃者は、こうした映像を巧みに操作することで、実際の物体とそのプロジェクターで作られた幻影を区別できなくさせ、自律システムを欺き、意図した動作を行わせることができる。

例えば、歩行者を認識して停止する自動運転車や、パトロール用のAIドローンを欺き、実際には存在しない人間を認識させることで、予期せぬ誤動作が引き起こされるリスクがある。

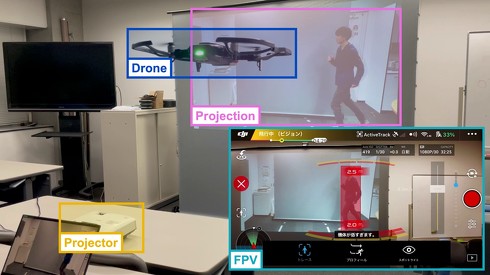

この研究では、市販のドローンを使用して実証実験を行い、幻影攻撃の実現可能性を定量的に評価した。具体的には「DJI Mavic Airドローン」とそのActiveTrack機能を使ったブラックボックスアプローチ、もう一つはオープンソースの「Telloドローン」とYOLOv3物体認識を組み合わせたホワイトボックスアプローチを実施した。

その結果、投影された人物をドローンが追跡する様子を確認でき、幻影攻撃が現実的な脅威であることを実証した。また投影とドローン間の距離が長くなるほど、また水平角が大きくなるほど、攻撃の成功率が低下する知見も得られた。

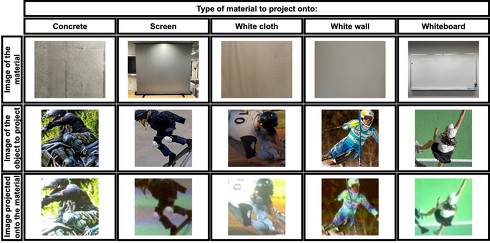

この脅威に対抗するため、研究チームは深層学習を用いた対策手法「DeGhost」を提案。DeGhostは、検出された物体が実物か投影かを判別する深層学習モデルである。DeGhostの性能を評価するため、さまざまなプロジェクターと投影面(コンクリート、白い壁、木板、植栽、ガラス面など)を組み合わせた多様な環境セットでテストを行った。

実験において、広く使われる物体認識モデルであるYOLOシリーズ、Faster R-CNN、CenterNetなどの物体検出システムに対して評価した結果、未知の環境を含めて高い精度で幻影攻撃を検出できることを示した。また、リアルタイム性能の評価でも、1秒当たり約33フレームの処理が可能で、実用上十分な速度であることを確認した。

Source and Image Credits: H. Oyama, R. Iijima, T. Mori, “DeGhost: Unmasking Phantom Intrusions in Autonomous Recognition Systems,” Proceedings of the 9th IEEE European Symposium on Security and Privacy(Euro S&P 2024), July 2024

関連記事

DJI製ドローンと操縦者の位置を特定するサイバー攻撃 遠隔から強制墜落させることも可能

DJI製ドローンと操縦者の位置を特定するサイバー攻撃 遠隔から強制墜落させることも可能

ドイツの研究チームは、民生用ドローンの主要メーカーであるDJI社が販売するドローンの無線信号を解読して、ドローンと操縦者の位置を特定できる攻撃を提案した研究報告を発表した。 「空飛ぶバイク」のA.L.I. Technologiesが破産手続き開始 仮面ライダーや新庄監督も乗っていた

「空飛ぶバイク」のA.L.I. Technologiesが破産手続き開始 仮面ライダーや新庄監督も乗っていた

A.L.I. Technologiesが、2023年12月27日に東京地方裁判所へ破産申請し、1月10日に破産手続き開始の決定を受けた。帝国データバンクが15日付で報じた。 「ナスカの地上絵」新たに168点発見 山形大学が発表 ドローンや航空レーザー測量で現地調査

「ナスカの地上絵」新たに168点発見 山形大学が発表 ドローンや航空レーザー測量で現地調査

山形大学は12月8日、南米ペルーのナスカ台地とナスカ市街地付近で新たなナスカの地上絵168点を発見したと発表した。 生成AIに“アスキーアート”入りプロンプト入力→有害コンテンツ出力 米研究者らが新手の脱獄法発見

生成AIに“アスキーアート”入りプロンプト入力→有害コンテンツ出力 米研究者らが新手の脱獄法発見

米ワシントン大学などに所属する研究者らは、大規模言語モデル(LLM)がアスキーアートを正しく認識できないという脆弱性を利用して、LLMに有害なコンテンツを出力させる新しいジェイルブレーク(脱獄)攻撃を提案した研究報告を発表した。 ワイヤレス充電器を乗っ取り、スマホを過剰加熱→破損させるサイバー攻撃 米研究者らが開発

ワイヤレス充電器を乗っ取り、スマホを過剰加熱→破損させるサイバー攻撃 米研究者らが開発

米フロリダ大学とセキュリティ企業CertiKに所属する研究者らは、電源アダプターからの電圧ノイズを悪用してワイヤレス充電器を乗っ取り、充電中のスマートフォンや周囲のデバイスに対してさまざまな攻撃を行う手法が提案した研究報告を発表した。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR