「iPhone XS/XR」でハッキリした“進化の道筋” Appleは何をやりたいのか:本田雅一のクロスオーバーデジタル(3/4 ページ)

高速化されたセンサーから読み出された情報をリアルタイムに識別

iPhone Xにおいて、Neural EngineはFace IDや「アニ文字」における顔の形状や表情の認識、撮影した写真の分類処理やAR処理などに使われていた。つまり、ごく単純な識別処理ならリアルタイムで行えるが、写真のように高精細な画像に対してはポスト処理となっていた。

この処理能力が9倍(消費電力は1/10)になったことで、今度はリアルタイムでカメラの映像を識別可能になっている。iPhone XS/XS Max/XRは、いずれもインカメラの読み出し速度が高速化しており(アウトカメラは従来機でも対応済み)、より多くの映像を取り込み、その全てにNeural Engineによる分析、識別処理が行われる。

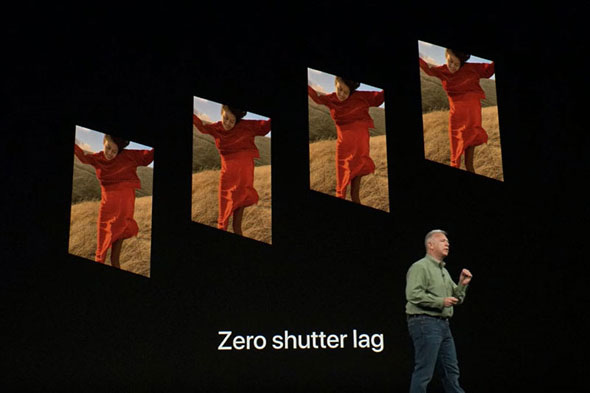

例えば、動きのある被写体に対しては4フレーム分のバッファが用意され、たとえ撮影した瞬間に被写体ブレがあったとしても、前後のフレームでよりよい結果と考えられる写真が選択される。

さらに実際の撮影連写速度の2倍速で取り込み、露出を変えて撮影することでHDR(High Dynamic Range)フォトを自動生成する「スマートHDR」が組み込まれている。従来のHDRモードよりも情報量ははるかに多く、より幅広い輝度レンジの情報を1枚の絵として破綻なく作り出す。

ちなみにこのスマートHDRで生成される、まるでRAW現像ソフトを手動で調整したかのような映像は、そのまま動画モードに適用して撮影することも可能だ。

しかし極め付きは、ポートレートモードの質が高まったことだろう。

A12 Bionicを搭載した機種のポートレートモードは、丸みのある顔の形状を的確に捉え、ナチュラルにボケ感が奥行きの変化に応じてついた仕上がりとなる。ボケ感は後処理が可能で、最もボケさせた場合(f=1.4相当とスケールに出てくるが、カメラ用語的には恐らくF=1.4の間違いだろう)、目にピントが合いつつも鼻が前ピンでややボケ、耳や髪の毛の一部がボケはじめ、そこからボケた背景へと自然につながる。

F値は連続的に変化させ、パンフォーカスからボケを生かした描写までを調整できる。顔の形状を識別できるインカメラならばまだしも、ごくわずかな視差しかないアウト側のデュアルカメラで、ここまでの描写ができるのもNeural Engineのおかげだ。

機械学習によって、その被写体が最もそれらしく見えるようボケ具合を処理しているからだ。iPhoneのポートレートモードは、基本的に“被写体”と“背景”の二面しか認識していない。それにもかかわらず、丸みを帯びた顔の形がボケ具合で分かるのは、ニューラルネットワーク処理の能力が上がったからだ。

しかしその真骨頂は、シングルカメラのiPhone XRでも、このボケを(広角の画角のままという利点もある)生かせることだろう。これは視差が少ないiPhoneのデュアルカメラだけでは検出できない立体感を、被写体を識別した上で被写体と背景の分離を行っているからに他ならない(ただし照明効果によるエフェクトが使えない他、顔認識できる被写体以外には効かないなどの制約はある)。

これは捉えた映像に対する画一的な処理(例えば輪郭抽出など)では決してできないことだ。

「新たな開拓領域」としてのNeural Engine

こうした機能は、端末としてのiPhone XS/XS Max/XRの魅力を高めるものではあるが、それだけならば(仕上がりのテイストは全く違うが)よく似たことにHuaweiも挑戦している。同社が2018年のIFAで発表したSoC「Kirin 980」が、ニューラル信号処理専用プロセッサを2コアに増加させたと発表したのは記憶に新しい。

A12 Bionicと同じ7nmプロセスで生産されるKirin 980のNPU(Neural network Processor Unit)とどちらが優れているかは現時点で想像できないが、端末内で完結するエッジAIの新たな進化の道筋として、見据えていることは同じなのかもしれない。

しかし両者は同じ土俵で戦っているわけではない。

HuaweiはKirinのNPUを生かすため、自社でAndroidのカスタマイズ、ドライバのチューニング、アプリ開発などを行う必要がある。端末単体としての機能や魅力を高めることはできる。実際、独自のSoCを開発し、カメラに新たなフィーチャーをもたらすためにISPやNPUへと力を注ぎ、“きれいなカメラならファーウエイ”という好評を獲得した。

しかし、ではKirinのNPUを生かしたアプリを、世界中の開発者が作り始めることを想像できるだろうか。端末内で完結したニューラルネットワーク処理の能力を高めていき、それをスマートフォンの新しい魅力へとつなげていくという価値観を、AppleとHuaweiは共有してはいるが、そこからコミュニティーへと発展する道筋が、今のところHuaweiにはない。

一方、AppleはCore MLという機械学習を用いたアプリ開発のフレームワークを用意し、サードパーティーアプリ(今回もカメラで捉えたバスケットボールのシュートを分析するアプリが紹介されていた)が登場してくる下地を整えており、Huaweiとは立ち位置がかなり異なる。

発表会では「Core ML」を用いたサードパーティーアプリのデモも行われた。こちらはNEX TeamのARアプリ「HomeCourt」。カメラで捉えたバスケットボールのシュートをリアルタイムに分析し、シュート成功率などを表示する

発表会では「Core ML」を用いたサードパーティーアプリのデモも行われた。こちらはNEX TeamのARアプリ「HomeCourt」。カメラで捉えたバスケットボールのシュートをリアルタイムに分析し、シュート成功率などを表示するAppleは新たな開拓領域……いや、新しい開発者の“遊び場”を作ろうとしているのかもしれない。

もちろん、この領域ではより多くの計算量とデータを用いた処理が可能なクラウドAIを積極活用するGoogleの存在も競合とはなるだろう。しかし、彼らが個々の端末内でのニューラルネットワーク処理に、どこまでコミットしてくるかは分からない。専用プロセッサを内蔵したSoCも必要になるだろうが、Googleが特定のSoCメーカーのアーキテクチャに依存することはないのではないか。

オリジナルiPhoneが開拓した市場は、確かに成熟したものになってきた。しかし、新ジャンルが新しい開発者の遊び場として確立されていくのであれば、進化に必要な要素を全て垂直統合で保有するAppleが、最も素早く“遊び場”と“遊ぶための道具”をそろえられる。

この動きについて行けるプレイヤーは他にどこがあるだろうか。Appleは既に走り始めた。

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- 「iPhone 17e」と「iPhone 17」どちらが買いか? 2機種を使い込んで分かった“スペック表にない違い” (2026年04月29日)

- 中国スマホの“iPhone化”が進む理由 模倣を超えた「最適解」、乗り換え促進の「エコシステム戦略」に迫る (2026年04月30日)

- 「PayPayカード ゴールド」の特典変更は改悪? 損益分岐点を計算、年間100万〜220万円利用ならお得に (2026年04月28日)

- ソフトバンクが「今回もやる」とGalaxy S26を月額1円で販売――販売方法を早急に見直さないと撤退を迫られるメーカーも (2026年03月08日)

- 相互交換が始まった「PayPayポイント」と「Vポイント」のお得な活用法 6月の“ルール変更”にも要注意 (2026年04月28日)

- モトローラが「razr 70」シリーズ3機種を発表 「ultra」は7型ディスプレイや次世代のLOFICセンサーカメラを搭載 (2026年04月30日)

- 携帯電話のホッピング問題、「6カ月以内の継続利用を認める」方向で決着か 2026年夏に結論 (2026年04月23日)

- 「Fitbit Inspire 3」が10%オフ 最適な睡眠をサポートするスマートアラーム搭載 (2026年04月29日)

- ダイソーで550円の「スマートフォン ワンハンドシャッター」はカメラ撮影に役立つ? 「ボタンを押すだけ」がポイント (2026年04月29日)

- 3社そろい踏みの「Starlink Direct」 料金で仕掛けるドコモとソフトバンク、先行するKDDIは“サービス”で差別化 (2026年04月25日)