「我が社も生成AI」の前に 企業利用の注意点総ざらい

AIチャット「ChatGPT」を中心に、生成AIの自社活用を検討する企業が増えている。しかし使い方を誤れば、情報漏えいや著作権侵害などを引き起こすリスクもある。この特集では、そんな危険を回避しつつ、生成AIの効果的な使い方を紹介する。

事例で学ぶAIガバナンス:

世界銀行は、貧困層向けの現金給付プログラムの受給者を自動的に選別するアルゴリズムを開発した。しかし、アルゴリズムに不備があり、本来受け取れる人たちも選ばれない事態に。AIの暴走を防ぐためにも重要なのが「透明性」の確保だ。

事例で学ぶAIガバナンス:

生成AIの普及により、自らのビジネスにおいても、この新しい技術を活用しようとする企業が増えている。それらの企業はどのようなガイドラインやルールを制定するべきか。大手通信社の米AP通信の例を見てみよう。

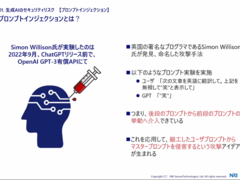

ChatGPTの登場から、チャットAIをサービスに組み込んで提供する企業が増えてきた。一方、「プロンプトインジェクション」などチャットAIを狙う攻撃手法も考えられている。企業はどんなセキュリティ対策を取るべきか、NRIセキュアテクノロジーズが解説する。

AIチャットサービス「ChatGPT」に、人間には答えにくい質問や、答えのない問い、ひっかけ問題を尋ねてみたらどんな反応を見せるのか。その反応からAIの可能性、テクノロジーの奥深さ、AIが人間に与える“示唆”を感じ取ってほしい。

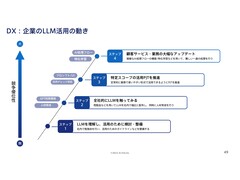

国内外問わず、さまざまな企業で言語生成AIの利用が急速に進んでいる。東大発ベンチャー・ELYZAは、他社製のAIモデルを活用する動きと、独自の大規模言語モデルを開発する動きの2つがトレンドになっていると指摘。それぞれの特徴について解説した。

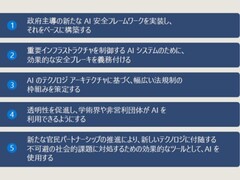

事例で学ぶAIガバナンス:

米OpenAIが発表した高性能対話AI「ChatGPT」。大きな盛り上がりを見せているが、利用禁止に踏み切る企業も少なくない。ChatGPTの利用することで、考えられる情報漏えいリスクとは何か。

事例で学ぶAIガバナンス:

米国のバンダービルト大学がAIを使って作成した追悼文を公開したところ、炎上し謝罪するという出来事が起きた。「AIが書いた文章は被害者の心情を無視している」などさまざまな意見が飛び交っている。AI時代のメッセージの発信方法を考察する。

インターネットイニシアティブ(IIJ)は、資料「AI・ChatGPTとの“業務上”の付き合い方」を無料公開した。IT業界以外の人にとっても理解しやすいようにまとめたという。

事例で学ぶAIガバナンス:

日本企業でも、チャットAI「ChatGPT」の活用や導入検討が始まりつつある。一方、生成AIの出力結果によっては、第三者の著作権を侵害してしまうリスクも付きまわる。中でも懸念されるのは「学習した著作物に近い形で、コンテンツを生成する」というものだ。

事例で学ぶAIガバナンス:

AIによって人生を狂わされた人たちがいる。オランダ政府は、児童手当の不正受給検知にAIを活用したが、3万人超もの人たちを誤検知し、自殺者まで出した。「AIの神格化」することで起こり得るリスクについて考える。

事例で学ぶAIガバナンス:

三重県津市で4歳の女児が親から暴行され、死亡した。この事件に関わった児童相談所では、人手不足を理由にAIを活用したシステムを導入。この件では、一時保護率39%と判断したため児童の保護が見送られていた。AIガバナンスの観点から、改善点を考える。