「ポケモンGO」はより現実に溶け込んでいく AIと共有技術で世界をプラットフォーム化するNianticの戦略(1/2 ページ)

AR、VR、MR……どれもここ数年で特によく聞くようになった言葉だ。

ゲームや映像コンテンツを中心に少しずつ広がりを見せるVR(Virtual Reality:仮想現実)がある一方で、Windows MR(Mixed Reality:複合現実)を標ぼうするMicrosoftはヘッドセット型デバイス「HoloLens」を特定業界向けのツールとして活用すべくパートナーとの協業を進めている。

そしてAR(Augmented Reality:拡張現実)は、スマートフォンなどのデジタル機器を通じて現実世界に付加情報を与えることで世界観をさらに広げる仕組みを提供するものだ。最近ではAppleがiOS向けに「ARKit」を、GoogleがAndroid向けに「ARCore」を提供しており、スマホを通じて空間拡張を行う仕組みの実装が容易になりつつある。

2013年に正式リリースとなったスマホゲームアプリの「Ingress」では、地理上に仕掛けられたポイントに対し、ユーザーが実際に移動してアプリを通じてゲーム世界に介入していくという、後の世界的ヒット作「Pokemon GO(ポケモンGO)」につながる「位置情報ゲーム」の基礎を築いた。現実世界という空間に、ゲームという要素を通じて新たな情報を付加して新しい世界を生み出しているわけで、これもARの一種だろう。

両ゲームアプリを開発した米Nianticは、2018年中のリリースを目標に「Harry Potter : Wizards Unite」というポケットモンスターに匹敵する人気コンテンツのハリー・ポッターを題材にしたARゲームを開発中だ。同ジャンルのゲームの大家として新しいチャレンジを続けている。

そんなNianticだが、6月28日(米国時間)に英ロンドンを拠点にAR技術を研究開発している会社であるMatrix Millの買収を発表した。また、AR技術をさらに高度なものにすべく、新しい幾つかのデモも公開している。

Nianticではこうした最新技術の他、過去の世界規模のゲームでの実績を基に、ゲームが稼働するシステムそのものを「Niantic Real World Platform」の名称でプラットフォーム化し、サードパーティーに提供する形で活用していくという。今回はこの動きについてレポートする。

機械学習でよりリアリティーあるARを

Nianticは、もともとGoogleで「Google Maps」や「Google Earth」などを開発していたチームが、その中核にいたジョン・ハンケ氏をトップとして2015年8月に独立した会社だ。当然ながら位置情報や地図描写の面で秀でた技術を有している。IngressやポケモンGOはその集大成であり、同社の特徴を端的に表したゲームアプリだ。

一方で、前述のARKitやARCoreなどで一般的に想像される「現実風景にコンピュータで描画された付加情報を載せる」というARの面では、まだまだという印象がある。

例えば、ポケモンGOにおけるポケモン捕獲時の「AR」モードは、単にスマホの背面カメラで撮影された映像に3Dでモデリングされたポケモンのグラフィックスを重ねて描写しているだけで、「現実世界に溶け込んでいる」という印象からは残念ながら程遠い。

iOS版のポケモンGOでは、2017年12月にARKitのフレームワークを使った「AR+」モードが利用可能になり、大きなポケモンを見上げたり、遠くから近づいたりといった位置やサイズ感の表現が進化したが、これも現実感という点ではまだ道半ばにある。

iOS版のポケモンGOは、ARKitのフレームワークを使った「AR+」モードが利用できる。捕獲時にポケモンに近づけるなど、通常の「AR」モードより進化した表現が可能になったが、現実感という点ではまだ道半ばにある

iOS版のポケモンGOは、ARKitのフレームワークを使った「AR+」モードが利用できる。捕獲時にポケモンに近づけるなど、通常の「AR」モードより進化した表現が可能になったが、現実感という点ではまだ道半ばにあるこのように仮想現実のキャラクターが現実世界に溶け込めない理由の一つに、「キャラクターが現実世界から分離している」というのが挙げられる。

例えば、森のような場所であれば、木々に逃げ隠れるポケモンを捕獲するために周囲を徘徊(はいかい)しながら見つけ出す必要があるだろうし、空を飛べないポケモンが位置的に不自然な場所で宙に浮いているのは変だ。背景となる現実世界の状況を“リアルタイム”で適切に認識し、適時最適な形でキャラクターを描画するのがリアリティー実現への近道となる。

そこで登場するのが機械学習を使った、いわゆる「AI」だ。物体認識の他、“深度”情報を加味することで背景に存在するオブジェクトのそれぞれの立体的な位置を把握し、これを基に描画を行う。

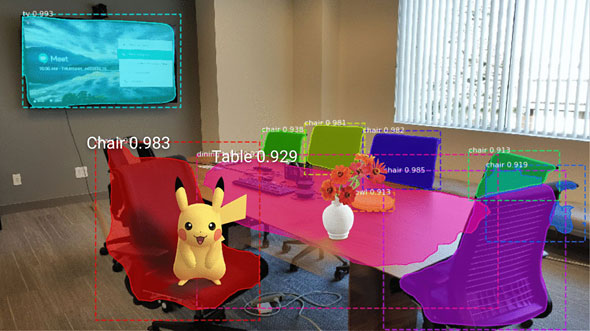

下記は一例だが、「椅子の上にピカチュウ」「机の上に花瓶」というのを、物体認識を行うことでより自然な形で描画しようとしている。これは「Computer Vision」と呼ばれるもので、深層学習で学習データを記憶させていくことにより、コンピュータ自らが一定の確率で写真内の物体を認識できる仕組みだ。

背景の属性を認識することで、より自然な描画が行えるようになる。水の上をキャラクターが普通に歩き回っていたら変だし、明らかに車と思われる物体に特攻していったら引かれて大けがをしてしまう。雑踏では人混みの間を縫って動く必要があるだろう。ここでは奥行きも重要となる。

従来のARでは距離にかかわらず、必ず背景となる写真の上にキャラクターが描写されることが多かったが、互いの位置関係を認識して重ね合わせができるようになれば、キャラクターはより生き生きとしてくる。Nianticでは「Niantic Occlusion」というデモンストレーション動画をYouTubeで公開しており、よりリアリティーあふれるARの世界を紹介している。

この機械学習による物体認識や、奥行きを把握するための技術を開発しているのが、今回Nianticが買収を発表したMatrix Millのロンドンチームだ。

Matrix Millは「MonoDepth」という技術を開発し、スマホのような単眼のカメラでも奥行き情報を含んだ物体認識を可能とした。露出を変更した複数枚の画像情報を入手し、これを機械学習済みライブラリを通すことで奥行きの分かる濃淡表示された要素を抽出、最終的に画像を機械合成することで目的となる出力を得る。

写真の補正にも応用できる技術だが、このリアルタイム処理の仕組みをARやゲームの世界に応用することで、よりリアリティーのある映像を得られる。

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- 引越し後にNHKが「勝手に住民票を取得」…これって違法? ネット上に広がる違和感と不信感 (2026年06月01日)

- ファミマに「セブン銀行ATM」が導入された理由 進む“ATMガチャ”解消と金融インフラの地殻変動 (2026年06月04日)

- 楽天ペイと楽天ポイントのキャンペーンまとめ【6月3日最新版】 1万〜3万ポイントの高額還元あり (2026年06月03日)

- 光回線業者を装い「ご自宅のコンセント見せて」──“偽装チラシ”の恐怖ネットに、自衛策は? (2026年06月04日)

- KDDIが「au Flex Style」で“とがったスマホ”を扱う理由 単に「SIMフリーを持ってきた」とは違う安心感とは (2026年06月03日)

- ソフトバンクが「今回もやる」とGalaxy S26を月額1円で販売――販売方法を早急に見直さないと撤退を迫られるメーカーも (2026年03月08日)

- 楽天モバイルの「Rakuten Turbo」がホームルーターの満足度1位に、コスパを評価 オリコン調べ (2026年06月03日)

- au PAYとPontaのキャンペーンまとめ【6月2日最新版】 最大39%還元や5000ポイント還元あり (2026年06月02日)

- 腰に装着する送風ギア「FIELD WAIST FAN」 モバイルバッテリーや冷却プレート機能も搭載 (2026年06月02日)

- SIMフリー版「motorola edge 60」6月12日に発売 3眼カメラ搭載、防水+FeliCa対応で5万9800円 (2026年06月03日)