AppleのAI戦略発表はなぜ他社より大幅に遅れたのか 「Apple Intelligence」の真価を読み解く:松尾公也のAppleWIRE(3/3 ページ)

2024年秋のターゲットは妥当 オンデバイスで実用的な機能をこなすことの難しさも

一方LLMの世界では、より小さなサイズと計算力で効果的なAI処理を可能にする技術として、bfloat16、4bit量子化、BitNetなどが登場している。

こうした技術の進展を考えると、2024年秋というターゲットは、オンデバイスLLMとしては妥当な線だったと考えられる。

ユーザーが欲しがる処理全てをオンデバイスだけで実行するのは、これから登場してくるであろう技術を総動員してもかなわない。そこでAppleが考えたのは、オンデバイスLLMと、プライベートクラウドであるPCCの2段式アーキテクチャだった。

オンデバイスは3B(30億パラメータ以下)の小型LLMで処理し、それよりも処理能力を必要とするタスクはPCCに送り出す。PCCはApple Siliconベースのサーバシステムが集積された独自のデータセンターで処理する仕組みで、そのためのセキュアでプライバシーを確保したOSも開発している。

このために1年以上かけたのなら仕方ないし、データセンターや専用Apple Siliconサーバプロセッサの開発を含めるとなると、さらに数年の開発期間が必要だったろう。

それらをこなした上での今回の発表だったのだ。

しかし、それだけでは十分ではない。高速なSoCとオンデバイスLLMが可能になったことをうたっても、結局ローカル処理する機能はごく少数というCopilot+ PCを見れば分かるように、オンデバイスで実用的な機能を使えるようにするには困難が伴う。

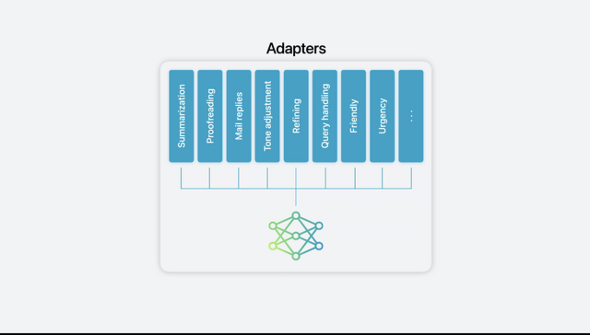

Appleが採用したのは、1パラメータあたり16bitのモデルを1パラメータあたり平均4bit未満に圧縮する量子化技術と、量子化は一般的な手法だが、Adaptersは独特のものだ。

テキストの概要作成、校正、メールの返信などの用途別にファインチューニングを施した学習モデルをFoundationモデルの上にダイナミックにロードしたりスワップしたりする手法がAdapters。タスクによって、使用するモデルを動的に換えていくため、少ないメモリでも動作する。

ただ、そのためには学習モデルの最適化が必要で、ここに時間と手間がかかる。だからAppleはAI技術者を総動員する必要があり、そのためにApple Carプロジェクトを犠牲にしたのではないかとも推測できる。

まずは米国の英語環境で動くようにし、それができたら他の言語圏、文化への適応が必要となる。1つの巨大なLLMであれば力技で済むことだが、最適化しながらだとそれだけの時間を要する。

Apple Intelligenceがすぐに出ないのは、そのための時間が必要だからだし、日本語対応が2025年のいつかまだ分からない状況だというのも、そういう状況だからなのだろう。

このことに気付くまでは「秋まで出せないとか努力が足りない」という印象だったのだが、今では「分かる。むしろ秋で間に合うのか」という考えに変わった。

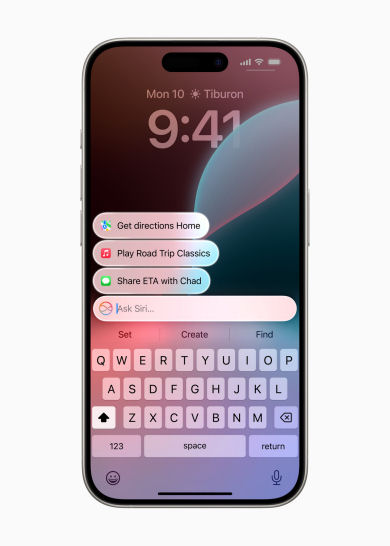

Apple IntelligenceとSiriとChatGPTの関係

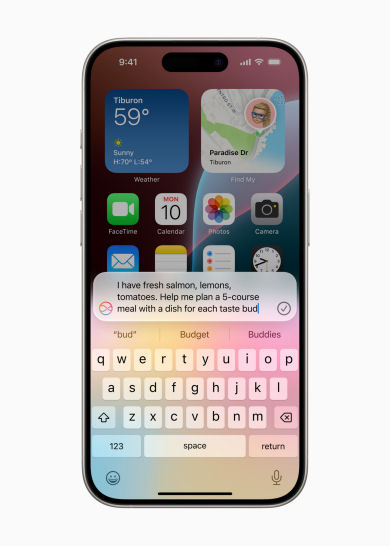

ChatGPTのボイスモードと比較すると、Siriは応答性、知識のいずれにおいても劣っていた。しかし、秋以降の英語版Siriにおいては少なくとも応答性は抜群に向上するはずだ。これまでとは異なり、Appleデバイスにある情報はサードパーティーアプリも含めコンテキストに応じた振る舞いができるため、より理解力のあるパートナーとなる。

ここ数年は進化の見られなかったSiriだが、今度は大きな進化が見られそうだ。

その新機能の1つとして、ChatGPTへの仲介機能もある。Siriからテキスト、写真、書類を呼び出してChatGPTに伝え、回答を得ることができる。ChatGPTアプリがあれば別になくてもいい機能だが、GPT-4oを無料で使えるというのはメリットの1つだし、有料ユーザーは限定機能も利用可能だ。

だが、実はApple Intelligenceの構造図にはChatGPTは存在しておらず、Platforms State of the Unionでも全く言及されていない。

ChatGPTはWriting Toolsから呼び出すことはできるし、Composeアプリで画像生成も可能だ。このあたりはAppleがChatGPTを組み込んだAPIを提供しているわけではなく、Apple純正アプリが個別に対応しているということなのかもしれない。

Appleは、OpenAIべったりというわけではなく、Google Geminiの採用もにおわせている。また、主要マーケットの1つである中国においてはどちらのLLMも使えないだろうから、Baiduあたりのサービスを採用する可能性もある。

このあたりの構造も今後、明確になっていくものと考えていいだろう。

そんなわけで期待の大きいApple Intelligenceと次期OSだが、日本で活用できるのはまだまだ先。秋以降は英語で生活する時間が増えそうだ。

関連記事

Apple、生成AI「Apple Intelligence」発表 オンデバイス処理でSiriも大幅進化、ChatGPTとも連携

Apple、生成AI「Apple Intelligence」発表 オンデバイス処理でSiriも大幅進化、ChatGPTとも連携

Appleが独自の生成AI「Apple Intelligence」を発表した。さまざまなデバイスやアプリで活用できる。 Apple Intelligenceでオリジナル絵文字を生成する「Genmoji」、「メッセージ」で利用可能に

Apple Intelligenceでオリジナル絵文字を生成する「Genmoji」、「メッセージ」で利用可能に

Appleは、新しいAIパーソナルアシスタント「Apple Intelligence」で生成するオリジナル絵文字「Genmoji」(ジェンモジ)を発表した。今秋リリースのOS上の「メッセージ」で利用できるようになる見込み。テキストで説明すると新しい絵文字を提示する。 「ChatGPT」アプリの登場で“生成AIとSiriの関係”はどう変わる? AppleのAI戦略を予想する

「ChatGPT」アプリの登場で“生成AIとSiriの関係”はどう変わる? AppleのAI戦略を予想する

間近に迫ったWWDC23に何を期待するか? 多くの人はApple製HMDと答えるだろうが、筆者は新たなAI戦略に期待する。WWDCで発表されるであろうiPhoneの次期OSであるiOS 17では、大規模言語モデル(LLM)が何らかの形で使えるようになるのではないか。 「Siri」と「AI」の関係を整理する

「Siri」と「AI」の関係を整理する

最近話題を集めている「AI(人工知能)」。AppleのAI技術といえば、音声アシスタントの「Siri」を思い浮かべる人も多いでしょう。今回は、AppleとSiri、AIの関係を整理していきます。 Androidに“Google AI”の新機能 OSにGeminiを統合、「かこって検索」で問題を解く機能など

Androidに“Google AI”の新機能 OSにGeminiを統合、「かこって検索」で問題を解く機能など

米Googleが、Android向けに搭載するAI関連の新機能を発表した。特定の部分を丸で囲って検索ができる「かこって検索」を、学習に活用できるようにする。Androidに生成AIモデルの「Gemini」を統合し、アプリ上のオーバーレイ表示から、より簡単にGeminiを利用可能になる。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- 3社そろい踏みの「Starlink Direct」 料金で仕掛けるドコモとソフトバンク、先行するKDDIは“サービス”で差別化 (2026年04月25日)

- スマホの「残価設定」にメス? 総務省がルール統一を検討も、Appleは「不当な扱い」と猛反発 (2026年04月25日)

- 楽天モバイル、ルーター「Rakuten WiFi Pocket 5G」の販売を一時停止 理由は? (2026年04月24日)

- ダイソーで1100円の「USB充電器(PD20W)」は、きちんと20Wで充電できるのか? (2026年04月26日)

- Xiaomiの前に、中国スマホの“雄”だったMeizu、またしてもピンチ (2026年04月26日)

- ダイソーの1100円「シースルーイヤフォン」に一目ぼれ “音質と個体差”に目をつむれば「あり」な選択肢 (2026年04月23日)

- 携帯電話のホッピング問題、「6カ月以内の継続利用を認める」方向で決着か 2026年夏に結論 (2026年04月23日)

- 1.72型ディスプレイ搭載スマートバンド「Xiaomi Smart Band 10」、高精度の睡眠モニタリングも可能 (2026年04月25日)

- ソフトバンクが「今回もやる」とGalaxy S26を月額1円で販売――販売方法を早急に見直さないと撤退を迫られるメーカーも (2026年03月08日)

- 「Pixel 10a」と「Pixel 10」どちらを選ぶ? 実機比較で分かった「約5万円差の価値」と「明確な違い」 (2026年04月20日)