AMDのGPUアクセラレーター「Instinct」のロードマップを公表 「Insinct MI350X」は2025年内に登場:COMPUTEX TAIPEI 2024

» 2024年06月03日 12時15分 公開

[井上翔,ITmedia]

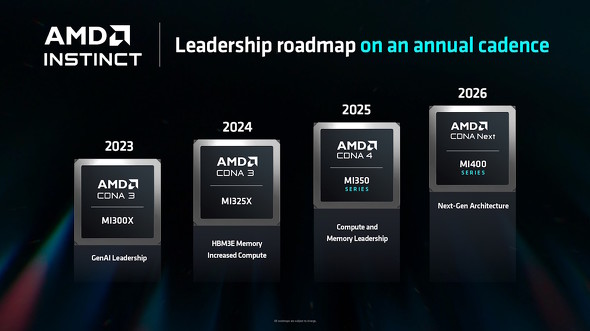

AMDは6月3日(台湾時間)、AI(人工知能)/HPC(ハイパフォーマンスコンピューティング)向けGPUアクセラレーター「AMD Instinctシリーズ」のロードマップを披露した。2024年第4四半期に「Instinct MI325X」を投入する他、2025年内に新アーキテクチャの「Instinct MI350シリーズ」を、2026年内にさらに新しいアーキテクチャの「Instinct MI400シリーズ」を投入する予定だという。

Instinct MI325Xの概要

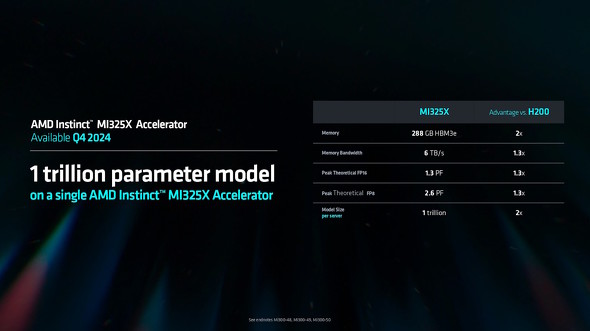

Instinct MI325Xは、2023年12月にリリースされた「Instinct MI300シリーズ」のうち、OAMモジュールとして提供される「Instinct MI300X」を改良したモデルとなる。本モジュールは

主な改良点は以下の通りだ。

- メモリモジュールの高速化(HBM3→HBM3E)

- メモリの増量(最大192GB→最大288GB)

- メモリアクセス速度の向上(毎秒5.3TB→毎秒6TB)

これらにより、NVIDIAの「NVIDIA H200」よりも高速なAIパラメーターの処理を時限したという。

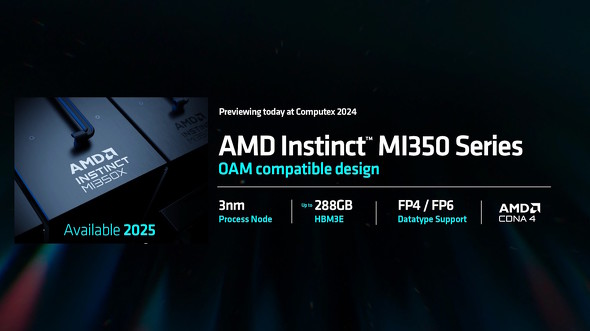

Instinct MI350シリーズの概要

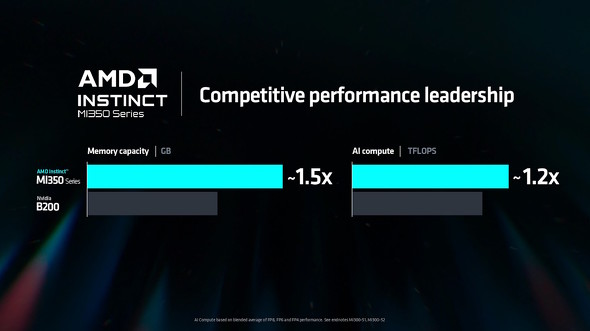

Instinct MI350Xシリーズは、3nmプロセスの新しい「CDMA 4アーキテクチャ」を採用する。現時点ではOAMモジュールとして提供される予定だ。

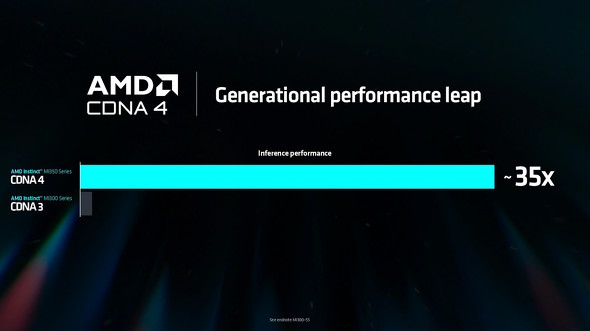

グラフィックスメモリはHBM3E規格で、最大288GBまで搭載できる。新たに浮動小数点演算において「FP4」「FP6」での演算に対応するという。インターフェンスのスループットは、現行のCDNA 3アーキテクチャの比で最大35倍にも上るという。

関連記事

AMDが新型GPUアクセラレータ「Instinct MI300シリーズ」の詳細を発表 「NVIDIA H100」よりも強い?

AMDが新型GPUアクセラレータ「Instinct MI300シリーズ」の詳細を発表 「NVIDIA H100」よりも強い?

AMDが、投入を予告していたGPUアクセラレータ「Instinct MI300シリーズ」の詳細情報を公表した。「NVIDIA H100」のSMX5ボード版と比べると、ほぼ同じか上回るパフォーマンスを発揮できるという。 AMDが「Instinct MI210」を発売 PCI Express接続で使いやすく

AMDが「Instinct MI210」を発売 PCI Express接続で使いやすく

米AMDが、AI/HPC向けGPUアクセラレーターの新製品「AMD Instinct MI210」の販売を始めた。 AMD、HPC向けのGPUアクセラレーター「AMD Instinct MI200」シリーズを発表 業界初のマルチダイGPU構成を採用

AMD、HPC向けのGPUアクセラレーター「AMD Instinct MI200」シリーズを発表 業界初のマルチダイGPU構成を採用

米AMDは、このほど開催したオンラインイベント「AMD Accelerated Data Center Premiere」にて最新GPUアクセラレーターとなる「AMD Instinct MI200」シリーズの発表を行った。 AMDがデータセンター向けCPU「第5世代EPYC」の登場を予告 Zen 5アーキテクチャ採用で最大128コア 2024年後半に発売予定

AMDがデータセンター向けCPU「第5世代EPYC」の登場を予告 Zen 5アーキテクチャ採用で最大128コア 2024年後半に発売予定

AMDが、Zen 5アーキテクチャを採用する「第5世代EPYC」を2024年後半に投入することを明らかにした。最大で192コア384スレッド構成で、128コア構成モデルは、Intelの現行Xeonで最高スペックの「Xeon Platinum 8592+」比で高いパフォーマンスを発揮できるという。 AMDのプロ向けGPU「Radeon PRO W7900」にコンパクトなデュアルスロットモデル登場 複数枚運用やコンテンツ制作に威力を発揮

AMDのプロ向けGPU「Radeon PRO W7900」にコンパクトなデュアルスロットモデル登場 複数枚運用やコンテンツ制作に威力を発揮

AMDのプロ向けGPUの最上位モデルに、スロット厚を抑えた新モデルが登場した。ボディースペースに余裕のないワークステーションにおける複数枚運用の他、プロフェッショナル/ハイアマチュアのコンテンツクリエイターの利用も想定しているという。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

SpecialPR

SpecialPR

アクセストップ10

2026年06月10日 更新

- 「次世代Apple Intelligence」をフル活用するにはどのような条件がある? 「Siri AI」は日本で使える? 知っておくべき対応モデルのハードル (2026年06月09日)

- 実売1万円切りでパススルー給電にも対応! KTCの15.6型モバイルディスプレイ「H15F9」は“買い”か (2026年06月09日)

- 「macOS 27 Golden Gate」が2026年秋に登場 初のApple Silicon専用バージョンに (2026年06月09日)

- 初のカラー対応「Kindle Scribe Colorsoft」の実力は? 通常モデルとの価格差1万7000円の価値を検証 (2026年06月10日)

- Apple Siliconはなぜ「オンデバイスAI」に強いのか? NVIDIA「RTX Spark」との比較で読み解くシリコン設計の哲学 (2026年06月08日)

- 「Geminiの技術は使うが、Geminiではない」 WWDC26で見えたApple流AIとプライバシー戦略の核心 (2026年06月10日)

- 高騰中のSSD、品薄のHDD──けれど“最終処分”のニーズは変わらず (2026年06月06日)

- 新GPU「RX 9070 GRE」搭載カード発売! 既存上位モデル「RX 9070 XT」との価格差に悩む声も (2026年06月08日)

- コンパクトボディーにスパコン並みのAI性能! 「NVIDIA RTX Spark」搭載ミニデスクトップPCを見てきた (2026年06月04日)

- エレコム、Windows Hello対応の指紋認証リーダー2製品を発売 (2026年06月09日)

最新トピックスPR