AMDが新型GPUアクセラレータ「Instinct MI300シリーズ」の詳細を発表 「NVIDIA H100」よりも強い?

AMDは12月6日(米国太平洋時間)、HPC(ハイパフォーマンスコンピューティング)/データセンター向けのGPUアクセラレータ「Instinct MI300シリーズ」の詳細を発表した。搭載する製品は、2024年初頭から登場する予定だ。

Instinct MI300シリーズの概要

Instinct MI300シリーズは、AMDのGPUアクセラレータ「Instinct MI」の最新モデルで、最新の「CDNA 3アーキテクチャ」のGPUコアを搭載している。先代の「Instinct MI200シリーズ」と比べると、演算ユニット(CU)は最大約40%増加し、対応するメモリ容量は最大1.5倍となり、メモリ帯域幅(ピーク時)は最大1.7倍となっている。

ラインアップは、CPUコアも備えるAPU「Instinct MI300A」、PCI Express 5.0接続のOAMモジュールとして提供される「Instinct MI300X」、Instinct MI300Xを8基まとめて搭載した「Instinct MI300X Platform」の3種類が用意される。

Instinct MI300A

Instinct MI300Aは、24基の「Zen 4アーキテクチャ」CPUコアと、128GBのHBM3メモリ(第4世代広帯域メモリ)を統合したAPUだ。対応ソケットは「Socket SH5」で、TDP(熱設計電力)は550W(ピーク時で760W)に設定されている。

GPUコア部の主なスペックは以下の通りだ(演算性能はピーク値、以下同)。

- CU:228基

- ストリームプロセッサ(SM):1万4592基

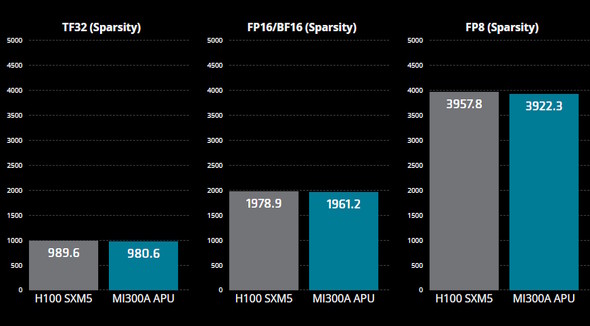

- FP16(半精度浮動小数点数)演算性能:980.6TFLOPS

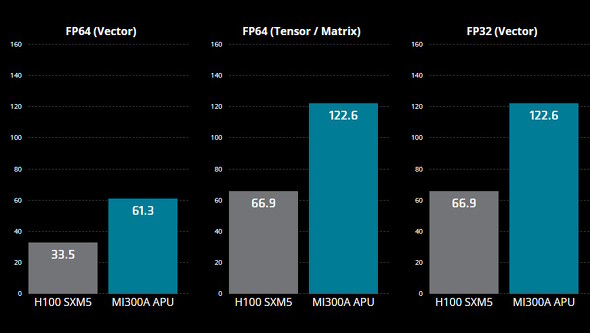

- FP32(単精度浮動小数点数)演算性能:122.6TFLOPS

- FP64(倍精度浮動小数点数)演算性能:61.3TFLOPS

- INT8(8バイト整数)演算性能:1.96POPS

- bfloat16 (ブレイン浮動小数点) 演算性能:980.6TFLOPS

AMDによると、FP32の演算性能は先代の「Instinct MI250X」比で最大2.6倍になるという。AIの処理性能は「NVIDIA H100」(SMX5ボード、以下同)とおおむね同等で、HPC向け演算は内容によって最大1.8倍のピーク性能を確保しているという。

Instinct MI300X

Instinct MI300Xは、OAMモジュールとして提供される。192GBのHBM3メモリを備え、「生成AIやHPCアプリケーションで先頭に立つパフォーマンス」を実現しているという。

主なスペックは以下の通りとなる。

- CU:304基

- ストリームプロセッサ(SM):1万9456基

- FP16(半精度浮動小数点数)演算性能:1.3PFLOPS

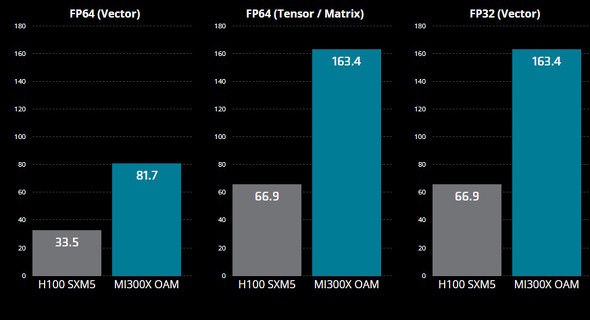

- FP32(単精度浮動小数点数)演算性能:163.4TFLOPS

- FP64(倍精度浮動小数点数)演算性能:81.7TFLOPS

- INT8(8バイト整数)演算性能:2.6POPS

- bfloat16 (ブレイン浮動小数点) 演算性能:1.3PFLOPS

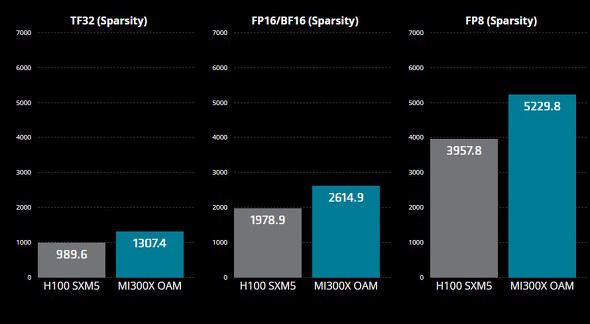

AMDによると、先代の「Instinct MI250」と比べると、AIトレーニングのワークロード(処理作業)パフォーマンスは最大6.8倍(※1)になったという。また、NVIDIA H100と比較した場合、AI処理性能は最大1.3倍、HPC向け演算は内容によって最大2.4倍のパフォーマンスを発揮できるという。

Instinct MI300X Platform

Instinct MI300X Platformは、先述の通りInstinct MI300Xを8基搭載したもので、カード間の接続にはAMDの「第4世代Infinity Fabric」が使われるという。

フォームファクターは「OCP(Open Compute Project)」の規格に準拠しており、既存のOCPラックに収納することも可能なので「低コストでAI/HPCのパフォーマンスを向上できる」選択肢として展開されるようだ。

関連記事

AMDがモバイル向け「Ryzen 8040シリーズ」をリリース Ryzen AIのパフォーマンスを改善(非対応モデルもあり)

AMDがモバイル向け「Ryzen 8040シリーズ」をリリース Ryzen AIのパフォーマンスを改善(非対応モデルもあり)

AMDがモバイル向け「Ryzen 8040シリーズ」のラインアップを発表した。Ryzen 7040シリーズのマイナーチェンジ版だが、CPUコアとAIプロセッサの処理パフォーマンスを改善したことが特徴だ。 AMDが「Instinct MI210」を発売 PCI Express接続で使いやすく

AMDが「Instinct MI210」を発売 PCI Express接続で使いやすく

米AMDが、AI/HPC向けGPUアクセラレーターの新製品「AMD Instinct MI210」の販売を始めた。 AMD、HPC向けのGPUアクセラレーター「AMD Instinct MI200」シリーズを発表 業界初のマルチダイGPU構成を採用

AMD、HPC向けのGPUアクセラレーター「AMD Instinct MI200」シリーズを発表 業界初のマルチダイGPU構成を採用

米AMDは、このほど開催したオンラインイベント「AMD Accelerated Data Center Premiere」にて最新GPUアクセラレーターとなる「AMD Instinct MI200」シリーズの発表を行った。 最大96コア192スレッドのハイエンドCPU「Ryzen Threadripper PRO 7000WX」登場 AMD PRO非対応の「Ryzen Threadripper 7000X」も

最大96コア192スレッドのハイエンドCPU「Ryzen Threadripper PRO 7000WX」登場 AMD PRO非対応の「Ryzen Threadripper 7000X」も

AMDが、デスクトップワークステーションやハイエンドデスクトップPC向けのCPUを刷新する。最新の「Zen 4アーキテクチャ」を採用し、最大で96コア192スレッド構成を選べる。各種入出力ポートも充実しており、通常のRyzenプロセッサではポートが足りないというエンスージアストのニーズもカバーしている。 ワークステーション向けCPU「Ryzen Threadripper PRO 5000」が登場 Zen 3アーキテクチャを採用

ワークステーション向けCPU「Ryzen Threadripper PRO 5000」が登場 Zen 3アーキテクチャを採用

AMDのワークステーション向けCPU「Ryzen Threadripper PRO」が、Zen 3アーキテクチャベースに移行する。最大で64コア128スレッド構成を用意しており、Lenovoの「ThinkStation P620」を皮切りに搭載製品が順次登場する見通しだ。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- Windows 11の不満解消へ Microsoftの最優先プロジェクト「Windows K2」とは何か (2026年04月28日)

- 手のひらサイズでAIが動く! 産業・ビジネスを支える最新「ミニPC」「GPUサーバ」展示レポート (2026年04月28日)

- 15.6型モバイルディスプレイ「ASUS ZenScreen MB169CK-J」が21%オフの1万7172円に (2026年04月27日)

- 発表時の批判は裏返る? スペック据え置きでも“買い”と言える、極上の普段着スマホ「Pixel 10a」を触ってみた (2026年04月27日)

- 4K有機ELのモバイルディスプレイ「JAPANNEXT JN-MD-OLED1331UHDR」がセールで2万6586円に (2026年04月27日)

- マザーボードは「細部まで白」が今の主流? 高コスパ水冷など見逃せない最新自作PCパーツ事情 (2026年04月27日)

- ナトリウムイオン電池が航空機への持ち込み・預け入れ不可に エレコムが注意喚起 (2026年04月28日)

- 炊飯器サイズで大容量なポータブル電源「BLUETTI AORA 100 V2」が64%オフの6万2989円に (2026年04月27日)

- USB4対応の「ORICO M.2 SSD 外付けケース」が44%オフの8999円に (2026年04月27日)

- キーボード「FILCO」ブランドのダイヤテックが閉業 4月22日付で (2026年04月24日)