ついにApple全デバイスが同じ操作体系に 共通の“皮膚”と“神経”を取り入れて新たな時代へ踏み出したApple:WWDC25(2/4 ページ)

Apple Intelligence:OSを貫く“神経系”の進化

Liquid Glassが新しいApple OSの共通の「皮膚」だとすれば、その下でシステム全体に知性を宿らせる「神経系」と言えるのが、さらなる進化を遂げた「Apple Intelligence」だ。ユーザーの作業を中断させて対話を求めるタイプのAIではなく、OSの機能と深く融合し、私たちが日々行っている操作を、より賢く、より効率的に進化させる縁の下の力持ちのような存在だ。

最近の対話型AIは確かにユーザーの意図を正確に読み取り、あらゆるタイプの情報を生成してくれるが、例えば書いた文章を校正させたり、文章のスタイルを変更しようとしたりするといった場合、いちいち文章をコピー&ペーストしてどのようにしたいのかをプロンプトとして打ち込む必要がある。

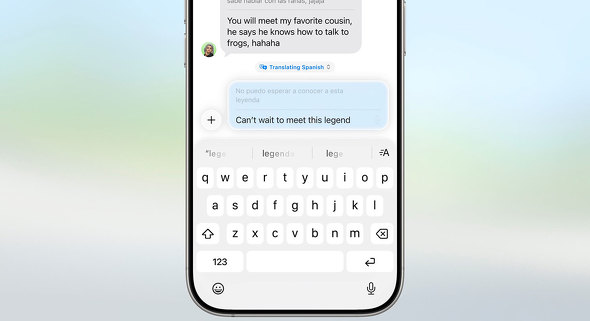

言葉の通じない外国人とチャットをする際も、確かにAIを使って翻訳はできるが、いちいち相手の言葉をコピー&ペーストして「翻訳して」とプロンプトを打ち込む必要がある。

Apple Intelligenceは、2024年の登場以来、それとは異なるユーザーが作業をするその場に組み込まれたプロンプト不要のインテリジェンスを目指してきた。

文章スタイルの変更はワープロ画面でテキストを選んだ後、コンテクストメニューから「作文ツール」を呼び出し、「フレンドリー」「プロフェッショナル」などあらかじめボタンとして用意された文章スタイルをクリックして選択。表示された内容に満足したら、ワープロ上の文章をそれに差し替えるといった形で使う。

一方、言葉の通じない相手とのチャットや、FaceTimeのビデオ通話でも新たに追加された「ライブ翻訳」というApple Intelligenceを使えば、文字でのやり取りなら翻訳文が一緒に表示されるようになり、ビデオ通話などでは相手が話し終わると、逐次通訳をしてくれる。

どんなことでも頼める代わりに操作が面倒だったり、たまに偽情報が紛れ込んでいたりするので真偽を見極めながら利用する他社のAIとは異なり、AIの使い方として最も間違いがなく失敗しない用途を厳選して、丁寧に機能という形にまで落とし込んだのがデザインの会社、AppleのApple Intelligenceだ。

おでんの種のようにいろいろな種類のインテリジェンスの集合体で、「これがApple Intelligence」と言える顔がないために実態の把握がしにくい難点は確かにある。だが、技術が苦手な人にも優しいデジタルツールを提供する会社のAI戦略としては極めて正しいと筆者は思う。

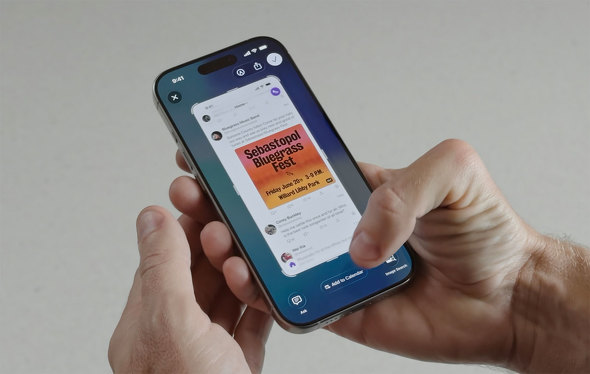

ライブ翻訳と並んで重宝しそうなのが、画面上に表示されている写真などについて、さまざまな情報を教えてくれるビジュアルインテリジェンス機能の拡張だ。従来はカメラで撮影した書類の文字をテキストとして取り込んだり、植物の名前を調べたり、Googleでイメージ検索したりするための機能だったが、新たにスクリーンショットを撮る操作を行うと、開いていたWebページに表示されていたランプの部分を指でなぞって、その商品をネットで探し出したりできる。

スクリーンショットを通して利用するビジュアルインテリジェンスで特に重宝しそうなのが、ソーシャルメディアに投稿されたイベントのチラシやポスターのイメージから日時や場所、イベント名などの情報を取り出し、カレンダーの予定を作成してしまう機能だろう。

個人的には、これまでやや強制的に3種類のアクの強すぎる絵柄の利用を強いていたImage Playgroundが進化して、ChatGPTを使っての絵の描画もできるようになったので、その点にも期待している。

関連記事

Appleが全てのOSを共通のバージョン番号に統一

Appleが全てのOSを共通のバージョン番号に統一

Appleが年次イベント「WWDC25」で、全ての次期OSからバージョン番号を導入すると発表した。 「macOS Tahoe 26」発表 MacもLiquid Glassでデザインを刷新、Spotlightの改良や新ゲームアプリも登場

「macOS Tahoe 26」発表 MacもLiquid Glassでデザインを刷新、Spotlightの改良や新ゲームアプリも登場

「macOS Tahoe 26」はパブリックβを7月に開始し、今秋に一般公開する。 新UIデザインを採用した「watchOS 26」が2025年秋に登場 Apple Intelligence対応iPhoneとの組み合わせでより便利に

新UIデザインを採用した「watchOS 26」が2025年秋に登場 Apple Intelligence対応iPhoneとの組み合わせでより便利に

Apple Watch用の「watchOS」に新バージョンが登場する。Appleの新方針に基づきバージョンは「26」となり、Apple Intelligenceを活用した機能も条件付きで使えるようになる。 Appleの新OSデザイン「Liquid Glass」で、往年の“Windows Vista”を思い出す人が続出

Appleの新OSデザイン「Liquid Glass」で、往年の“Windows Vista”を思い出す人が続出

AppleはvisionOSで初めて採用した同デザインを改良し、その他のAppleデバイスにも統一感を持たせる狙いがあるようだ。 「tvOS 26」ではiPhoneをマイクにカラオケが可能/プロファイルの切り替えも容易に

「tvOS 26」ではiPhoneをマイクにカラオケが可能/プロファイルの切り替えも容易に

Appleが次期tvOSとなる「tvOS 26」の概要を発表した。2025年秋にリリース予定だ。

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- 「次世代Apple Intelligence」をフル活用するにはどのような条件がある? 「Siri AI」は日本で使える? 知っておくべき対応モデルのハードル (2026年06月09日)

- 「macOS 27 Golden Gate」が2026年秋に登場 初のApple Silicon専用バージョンに (2026年06月09日)

- 実売1万円切りでパススルー給電にも対応! KTCの15.6型モバイルディスプレイ「H15F9」は“買い”か (2026年06月09日)

- 初のカラー対応「Kindle Scribe Colorsoft」の実力は? 通常モデルとの価格差1万7000円の価値を検証 (2026年06月10日)

- Apple Siliconはなぜ「オンデバイスAI」に強いのか? NVIDIA「RTX Spark」との比較で読み解くシリコン設計の哲学 (2026年06月08日)

- 「Geminiの技術は使うが、Geminiではない」 WWDC26で見えたApple流AIとプライバシー戦略の核心 (2026年06月10日)

- 高騰中のSSD、品薄のHDD──けれど“最終処分”のニーズは変わらず (2026年06月06日)

- 新GPU「RX 9070 GRE」搭載カード発売! 既存上位モデル「RX 9070 XT」との価格差に悩む声も (2026年06月08日)

- ミニPCに強みの「MINISFORUM」 ミニワークステーションの新モデルから「謎の拡張カード」まで多彩な製品を披露 (2026年06月10日)

- コンパクトボディーにスパコン並みのAI性能! 「NVIDIA RTX Spark」搭載ミニデスクトップPCを見てきた (2026年06月04日)