「HoloLens 2」が変える会議の「基盤」――生みの親キップマン氏に聞く:そろそろ会議やめませんか(1/2 ページ)

究極の会議の姿は何か? それは、SFやアクション映画の中に出てくる「ホログラムで自分の姿が投影され、空間を超えてコミュニケーションできること」だろう。

もちろん今は、それを実現するのは難しい。だからビデオ会議をやっている。

しかし、夢物語でなくなる日も遠くない。少なくとも、それを真剣に信じて開発を行っている人々はいる。

その1人が、米Microsoft テクニカルフェローのアレックス・キップマンだ。キップマン氏は同社のMRヘッドセット「HoloLensの産みの親」として知られている。彼は、会議や空間を超えるコミュニケーションのあり方をどのように考えているのだろうか? 単独インタビューで聞いてみた。

場所を超えたコミュニケーションのためにHoloLensを開発

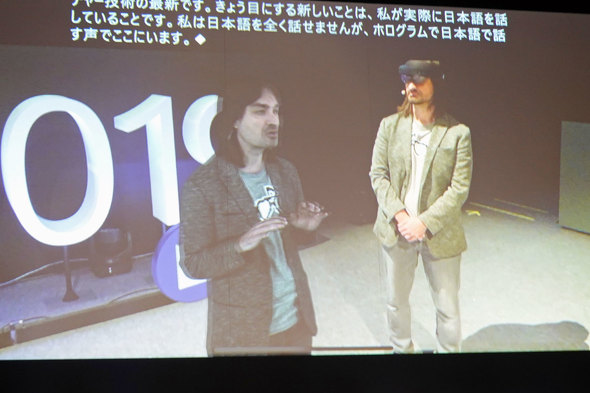

今回キップマン氏は、5月29日と30日に東京都内で開催された、日本マイクロソフトの開発者向けイベント「de:code 2019」に参加するために来日した。初日の基調講演の最後に登場し、日本に向けてHoloLens 2をお披露目した。

HoloLens 2は2019年2月末、スペインのバルセロナで開催された「MWC 2019」で発表された製品だが、その後、公の場でのデモは数えるほどしかない。日本でのデモは、キップマン氏自身の手による珍しいもので、しかも、今回初披露の新しいデモである。

デモの中でも興味深かったのは、以下のものだ。

壇上には、キップマン氏の3Dキャプチャモデルが現れ、HoloLens 2をかぶったキップマン氏本人と並んで見える。HoloLens 2をかぶっているキップマン氏には、実景の中にCGのキップマン氏がいるように見えている。

そこでCGのキップマン氏は、スピーチを始めた。英語ではなく、日本語で。キップマン氏は日本語がしゃべれるわけではない。

「ああ、なら吹き替え?」 それも違う。スピーチの声色は、キップマン氏のものだ。少し甲高く、早口で、でも情熱的な語り口は日本語になっていても「キップマン氏だ」と分かるものだ。

彼のスピーチ原稿(英語)は自動翻訳されて日本語になり、さらに、Microsoftが作った「本人の声を学習して話す音声合成」を使い、キップマン氏の3Dモデルを通して日本語で話す。

キップマン氏は、HoloLens 2の狙いを次のように語る。このデモは、まさにその理想を表現したものだ。

キップマン:私たちの理想は、「物理的にそこにいる」のと同じ状態を作り出すことです。あなたが東京にいて、私がシアトルにいるとしいても、同じように「ここにいる」体験ができるよう、Mixed Realityを生成するのが目標なんです。

CGとしてキップマン氏が現れることは、「現実にCGを重ねる」というHoloLensの仕組みそのものである。だが、キップマン氏が目指すことは、映像として「見える」ことだけを示しているわけではない。

キップマン:没入感には「インプットの没入感」と「アウトプットの没入感」があります。

アウトプットは、あなたの目にホログラムがどう見えるのか、という部分です。解像度向上や視野角の向上がこれにあたります。

インプットの没入感は、ホログラムとどうインタラクションをするのか、ということです。例えば視線認識は、空間の利用を意味的に理解するために追加しました。多関節を物理的な法則に基づいて認識するので、指などの動きも取れます。結果として、ホログラムへのインタラクションはより密になります。このために最新技術をつぎ込みました。

単純にそこに映像があっても、人は没入感を感じない。現実と同じように「触れる」「動かす」ということができて初めて、人は「そこにいる」感じを得る。そのため、HoloLens 2では、手の動きを認識する機能を大幅に拡張した。

初代HoloLensでは、親指と人さし指の動きくらいは認識できたし、「手を開く」ようなはっきりした動作を把握することができた。だが、あくまでシンプルな動きだけを把握していたので、現実世界と同じようなインタラクションは難しかった。だがHoloLens 2では、両手合わせて10本の指の動きを認識できる。従来なら、外付けのセンサーを使わねば把握できなかった細かな動きも、ちゃんと本体だけで把握可能になっている。

机の上にある物体を持ってちょっと動かす、としよう。従来は「端をつまんで動かす」形だった。PC画面のウインドウのように、物体の端には仮想的なボックスがある。それをつまむことで動かすわけだ。現実とはずいぶん違う。

だがHoloLens 2では、指の動きを認識し、物体を「つかむ」ことができる。そこに本物の物体はないのだが、それに近い感覚でインタラクションできるのである。

簡単にいえば、キップマン氏の言う「インプットの没入感」とは、こうした部分から生まれるものだ。

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- 「次世代Apple Intelligence」をフル活用するにはどのような条件がある? 「Siri AI」は日本で使える? 知っておくべき対応モデルのハードル (2026年06月09日)

- 「macOS 27 Golden Gate」が2026年秋に登場 初のApple Silicon専用バージョンに (2026年06月09日)

- 実売1万円切りでパススルー給電にも対応! KTCの15.6型モバイルディスプレイ「H15F9」は“買い”か (2026年06月09日)

- 初のカラー対応「Kindle Scribe Colorsoft」の実力は? 通常モデルとの価格差1万7000円の価値を検証 (2026年06月10日)

- 「Geminiの技術は使うが、Geminiではない」 WWDC26で見えたApple流AIとプライバシー戦略の核心 (2026年06月10日)

- Apple Siliconはなぜ「オンデバイスAI」に強いのか? NVIDIA「RTX Spark」との比較で読み解くシリコン設計の哲学 (2026年06月08日)

- 高騰中のSSD、品薄のHDD──けれど“最終処分”のニーズは変わらず (2026年06月06日)

- ミニPCに強みの「MINISFORUM」 ミニワークステーションの新モデルから「謎の拡張カード」まで多彩な製品を披露 (2026年06月10日)

- 新GPU「RX 9070 GRE」搭載カード発売! 既存上位モデル「RX 9070 XT」との価格差に悩む声も (2026年06月08日)

- コンパクトボディーにスパコン並みのAI性能! 「NVIDIA RTX Spark」搭載ミニデスクトップPCを見てきた (2026年06月04日)