Google丄Android偵乽Gemini Intelligence乿摫擖丂傾僾儕墶抐偱僞僗僋傪帺摦壔丄傑偢偼Galaxy偲Pixel偐傜

丂Google偼5寧13擔丄Android偺怴婡擻孮乽Gemini Intelligence乿傪敪昞偟偨丅AI偑暋悢傾僾儕傪傑偨偖僞僗僋傪帺摦幚峴偟偨傝丄Chrome偱Web忋偺憖嶌傪戙峴偟偨傝丄儐乕僓乕偺戙傢傝偵僼僅乕儉擖椡傪嵪傑偣偨傝偱偒傞傛偆偵側傞丅

丂2026擭壞偵Samsung Galaxy S26僔儕乕僘偲Google Pixel 10僔儕乕僘偐傜弴師揥奐偟丄2026擭屻敿偵偼僗儅乕僩僂僅僢僠丄幵嵹抂枛丄僲乕僩PC偵懳徾傪峀偘傞丅偙傟傜埲奜偺Android僗儅乕僩僼僅儞傊偺揥奐帪婜偼帵偝傟偰偄側偄丅傑偨丄擔杮偱偺採嫙帪婜偼崱屻敪昞偡傞丅

丂Google偼Gemini Intelligence傪丄Android傪OS偐傜乽僀儞僥儕僕僃儞僗僔僗僥儉乿傊揮姺偡傞戞堦攇偲埵抲晅偗傞丅偙偺曽恓偼2寧偺Samsung Galaxy Unpacked偱帵偟偰偍傝丄崱夞偺敪昞偱嬶懱婡擻偑弌偦傠偭偨丅儐乕僓乕偺堄恾傪偔傫偱帺棩揑偵摦偔僄乕僕僃儞僩婡擻傪丄僼儔僢僌僔僢僾抂枛岦偗偵抜奒揑偵搳擖偟偰偄偔丅

傾僾儕傪傑偨偖暋悢僗僥僢僾偺僞僗僋傪帺摦壔

丂幉偲側傞偺偑丄傾僾儕傪傑偨偖暋悢僗僥僢僾偺僞僗僋帺摦壔偩丅Google偼偙偙悢僇寧丄Galaxy S26偲Pixel 10偱怘昳攝払傗儔僀僪僔僃傾偲偄偭偨庡梫傾僾儕偱偺摦嶌傪挷惍偟偰偒偨丅

丂椺偊偽Gmail偵撏偄偨戝妛偺庼嬈偺僔儔僶僗偐傜昁梫側彂愋傪拪弌偟丄僔儑僢僺儞僌傾僾儕偺僇乕僩偵捛壛偡傞堦楢偺嶌嬈傪Gemini偑偙側偡丅僕儉偺僒僀僋儕儞僌僋儔僗偱慜楍偺僶僀僋傪梊栺偡傞傛偆側嬶懱揑側憖嶌傕壜擻偩偲偄偆丅

丂夋柺傗夋憸傪僐儞僥僉僗僩偲偟偰搉偣偽墳梡斖埻偼峀偑傞丅攦偄暔儊儌傪奐偄偨忬懺偱揹尮儃僞儞傪挿墴偟偟乽偙偺儕僗僩偺彜昳傪慡偰僇乕僩偵擖傟偰乿偲棅傔偽丄Gemini偑攝払傾僾儕偱張棟偡傞丅椃峴僷儞僼儗僢僩傪嶣塭偟偰乽偙傟偲帡偨僣傾乕傪6恖僌儖乕僾偱Expedia乮椃峴梊栺傾僾儕乯偐傜扵偟偰乿偲巜帵偡傞巊偄曽傕憐掕偡傞丅

丂幚峴拞偼僶僢僋僌儔僂儞僪偱嶌嬈偑恑傒丄儐乕僓乕偼捠抦偱恑揥傪妋擣偱偒傞丅Google偼乽Gemini偼儐乕僓乕偑巜帵偟偨偲偒偩偗摦偒丄嫋壜偟偨傾僾儕撪偱偺傒摦嶌偡傞丅僞僗僋偑廔傢傟偽掆巭偡傞乿偲愢柧偡傞丅寛嵪側偳偺嵟廔妋擣偼儐乕僓乕偑峴偆丅

Chrome偱傕僂僃僽僽儔僂僕儞僌傪帺摦壔

丂僂僃僽忋偱偺嶌嬈偵偮偄偰偼丄Chrome偺Android斉偵乽Gemini in Chrome乿傪摫擖偡傞丅Google偺AI儌僨儖乽Gemini 3.1乿傪儀乕僗偲偟丄6寧壓弡偐傜暷崙偺堦晹懳墳抂枛乮Android 12埲忋丄儊儌儕4GB埲忋丄塸岅愝掕乯偱儘乕儖傾僂僩傪巒傔傞丅

丂僣乕儖僶乕偺Gemini傾僀僐儞傪僞僢僾偡傞偲丄夋柺壓晹偵傾僔僗僞儞僩偑昞帵偝傟傞丅奐偄偰偄傞儁乕僕偺梫栺傗丄挿暥婰帠偺愢柧丄暋嶨側僩僺僢僋偺夝愢偵壛偊丄暋悢儁乕僕偺撪梕傪斾妑偡傞儕僒乕僠梡搑傕巟墖偡傞丅傾僾儕傪愗傝懼偊偢偵丄Gmail傗Google 僇儗儞僟乕丄Google Keep側偳懠偺Google傾僾儕傊忣曬傪搉偣傞丅儗僔僺偺嵽椏傪Keep偵儊儌偡傞丄儊乕儖撪偺梊掕傪僇儗儞僟乕偵搊榐偡傞丄偲偄偭偨憖嶌傪僽儔僂僓偺拞偱姰寢偱偒傞丅

丂Google偺夋憸惗惉丒曇廤儌僨儖乽Nano Banana乿傕慻傒崬傒丄奐偄偰偄傞Web儁乕僕偵懳偡傞夋憸張棟偑偱偒傞丅乽偙偺儁乕僕傪僀儞僼僅僌儔僼傿僢僋偵曄偊偰乿偲棅傔偽妛廗梡偺恾夝傪嶌傝丄捓戄忣曬僒僀僩偺嬻幒夋憸偵乽儌僟儞側儕價儞僌偺壠嬶傪捛壛偟偰乿偲巜帵偡傟偽丄壠嬶傪攝抲偟偨僔儈儏儗乕僔儑儞夋憸傪惗惉偡傞丅

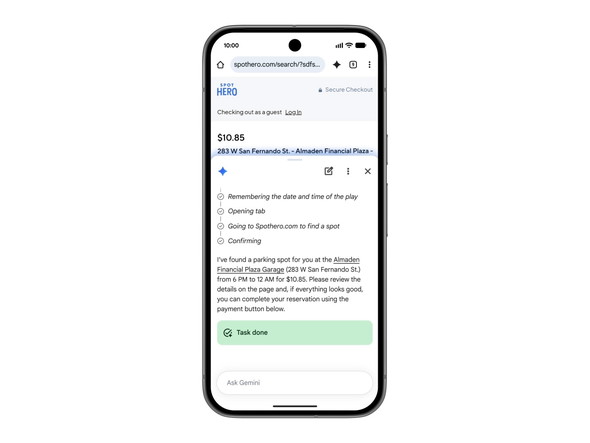

丂僂僃僽偱偺乽auto browse乿婡擻傕丄Android斉Chrome偵峀偑傞丅僠働僢僩儊乕儖偐傜忣曬傪撉傒庢偭偰挀幵応梊栺僒乕價僗偺SpotHero偱挀幵応傪妋曐偟偨傝丄儁僢僩梡昳僒僀僩偺Chewy偱掕婜峸擖傪巕將梡偐傜惉將梡偵愗傝懼偊偨傝偲偄偭偨丄柺搢側庤嶌嬈傪Gemini偑戙傢傝偵恑傔傞丅峸擖傗SNS搳峞側偳丄廳梫側傾僋僔儑儞偺慜偵偼儐乕僓乕妋擣傪嫴傓丅auto browse偼暷崙偺AI Pro偲Ultra偺壛擖幰岦偗偵丄Gemini in Chrome偲摨偠僞僀儈儞僌偱採嫙偡傞丅

僼僅乕儉擖椡傪儚儞僞僢僾偵

丂帺摦擖椡婡擻乽Autofill with Google乿傕Gemini偲楢実偟偰嫮壔偡傞丅Gemini偺乽Personal Intelligence乿傪捠偠偰丄僷僗億乕僩斣崋傗塣揮柶嫋徹斣崋丄儗儞僞僇乕偺僫儞僶乕僾儗乕僩斣崋側偳晛抜妎偊偰偄側偄忣曬傪愙懕嵪傒偺傾僾儕偐傜堷偒弌偟丄暋嶨側僼僅乕儉傪傑偲傔偰杽傔傞丅愙懕偼僆僾僩僀儞曽幃偱丄愝掕偐傜偄偮偱傕僆儞丒僆僼傪愗傝懼偊傜傟傞丅

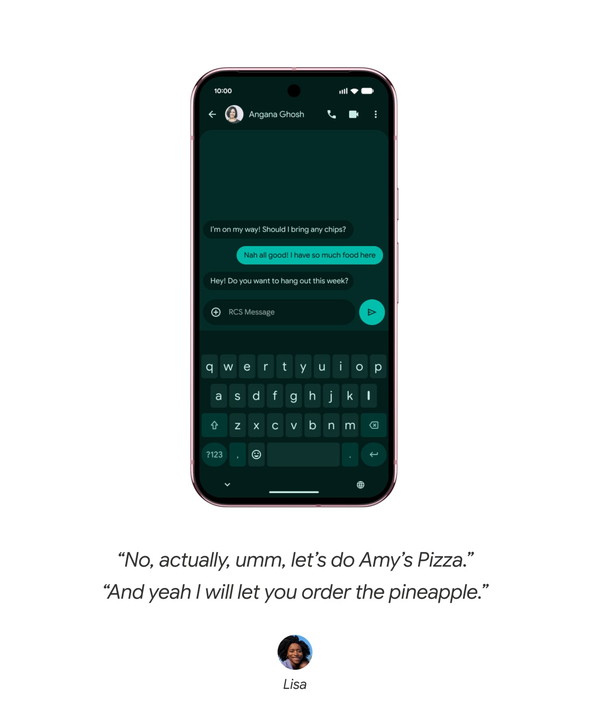

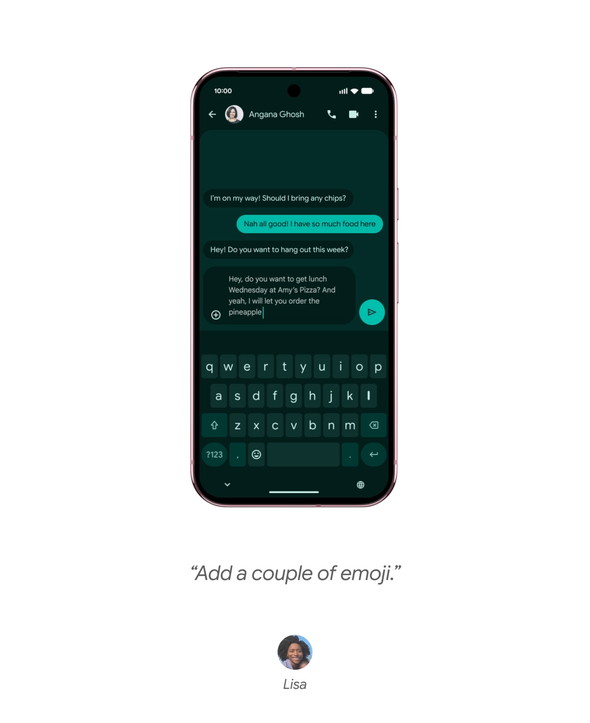

榖偟尵梩傪惍暥偡傞乽Rambler乿

丂壒惡擖椡偺怴婡擻乽Rambler乿傕搳擖偡傞丅Gboard偺壒惡擖椡傪儀乕僗偵丄乽偁乕乿乽偊乕偲乿偲偄偭偨僼傿儔乕傗尵偄捈偟傪Gemini偑彍偒丄梫揰偩偗傪拪弌偟偰惍暥偡傞丅

丂攦偄暔儊儌傪壒惡偱岥弎偟側偑傜乽傗偭傁傝僶僫僫偼偄傜側偄乿偲尵偄捈偡偲丄Rambler偑奩摉崁栚傪嶍彍偟偨忬懺偱僥僉僗僩壔偡傞丅偝傜偵乽売忦彂偒偵偟偰丄奊暥帤傪壛偊偰乿偲巜帵偡傟偽丄宍幃偺挷惍傕儕傾儖僞僀儉偱斀塮偡傞丅Gemini偺懡尵岅儌僨儖傪巊偆偨傔丄1偮偺儊僢僙乕僕撪偱暋悢尵岅傪愗傝懼偊偰傕張棟偱偒傞丅儊僢僙乕僕偺傎偐丄僪僉儏儊儞僩丄儊乕儖丄AI僄乕僕僃儞僩傊偺僾儘儞僾僩擖椡側偳丄僥僉僗僩擖椡偑昁梫側応柺慡斒偱棙梡偱偒傞丅壒惡僨乕僞偼儕傾儖僞僀儉偱偺彂偒婲偙偟偵偺傒巊偄丄曐懚偼偟側偄丅

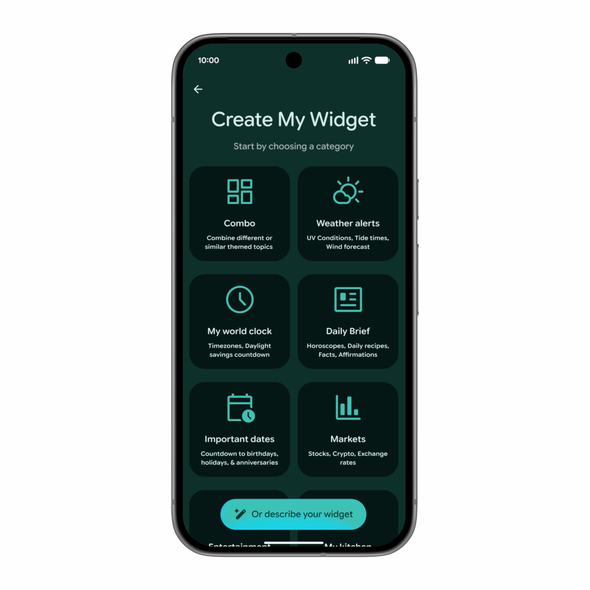

帺慠尵岅偱僂傿僕僃僢僩傪嶌傞乽Create My Widget乿

丂儂乕儉夋柺偺僂傿僕僃僢僩傕惗惉AI偱嶌傟傞傛偆偵側傞丅怴婡擻乽Create My Widget乿偱梸偟偄忣曬傪帺慠尵岅偱巜掕偡傞偩偗偱丄愱梡偺僂傿僕僃僢僩偑弌棃忋偑傞丅

丂乽枅廡丄崅僞儞僷僋側嶌傝抲偒儗僔僺傪3偮採埬偟偰乿偲擖椡偡傟偽丄枅廡撪梕偑峏怴偝傟傞僟僢僔儏儃乕僪宆偺僂傿僕僃僢僩偵側傞丅乽僒僀僋儕儞僌傪偡傞偺偱晽懍偲崀悈妋棪偩偗昞帵偟偰乿偲偄偭偨撈帺巇條偺揤婥僂傿僕僃僢僩傕嶌傟傞丅Wear OS偺僗儅乕僩僂僅僢僠偱傕摨偠巇慻傒偱棙梡偱偒傞丅

僨僓僀儞尵岅傕嶞怴

丂UI僨僓僀儞傕乽Material 3 Expressive乿傪儀乕僗偵嶞怴偡傞丅Gemini偑峫偊偨傝丄儐乕僓乕偺惡傪暦偄偨傝丄僶僢僋僌儔僂儞僪偱嶌嬈傪偟偨傝偟偰偄傞忬懺傪丄帇妎揑側僔僌僫儖偑傾僯儊乕僔儑儞偱帵偡丅Google偼乽儐乕僓乕偺拲堄傪偦傜偡偺偱偼側偔丄昁梫側忣曬傊摫偔僨僓僀儞乿偲愢柧偡傞丅

丂Gemini Intelligence偼崱夞偺Galaxy丒Pixel傊偺揥奐傪旂愗傝偵丄崱擭屻敿偵偼僗儅乕僩僂僅僢僠丄幵嵹抂枛乮Android Auto乯丄僲乕僩PC丄擭撪敪昞梊掕偺僗儅乕僩僌儔僗傊懳徾傪峀偘傞丅Android偑乽傾僾儕傪奐偄偰憖嶌偡傞OS乿偐傜乽儐乕僓乕偺堄恾傪傫偱摦偔僔僗僥儉乿傊偺揮姺傪悑偘傞婰擮偡傋偒傾僢僾僨乕僩偲側傝偦偆偩丅

娭楢婰帠

Google丄Fitbit傾僾儕傪慡柺揑偵嵞愝寁丂Gemini傪寬峃娗棟偵傕妶梡丄怴傾僾儕乽Google Health乿敪昞

Google丄Fitbit傾僾儕傪慡柺揑偵嵞愝寁丂Gemini傪寬峃娗棟偵傕妶梡丄怴傾僾儕乽Google Health乿敪昞

Google偼丄儐乕僓乕偺寬峃偲僂僃儖僱僗偵娭偡傞僨乕僞傪1偮偺応強偵廤栺偟丄曪妵揑側娗棟傪壜擻偵偡傞怴偟偄乽Google Health乿傾僾儕傪敪昞偟偨丅偙傟傑偱採嫙偝傟偰偒偨Fitbit傾僾儕傪慡柺揑偵嵞愝寁偟偨傕偺偱丄悢昐庬椶偺傾僾儕傗僨僶僀僗偺僨乕僞傪1僇強偵摑崌偱偒傞丅暷崙帪娫5寧19擔偐傜弴師採嫙偝傟傞丅 乽Gemini in Chrome乿擔杮偱採嫙丂Web僐儞僥儞僣傪庤寉偵梫栺丄YouTube傗Gmail偲傕楢実

乽Gemini in Chrome乿擔杮偱採嫙丂Web僐儞僥儞僣傪庤寉偵梫栺丄YouTube傗Gmail偲傕楢実

乽Google乿偼乽Google Chrome乿偱捈愙AI傪巊偊傞怴婡擻乽Gemini in Chrome乿傪擔杮偱採嫙奐巒偟偨丅儐乕僓乕偼僞僽傪愗傝懼偊偢偵愱梡偺AI偲傗傝偲傝偟偨傝丄懠偺僒乕價僗偲楢実偟偰嶌嬈傪岠棪壔偟偨傝偱偒傞丅暋悢偺僞僽傪墶抐偟偨忣曬張棟傗丄僂傿儞僪僂撪偱偺夋憸曄姺偵傕懳墳偡傞丅傑偨丄嫼埿傪帺摦専抦偡傞巇慻傒傪庢傝擖傟偰儐乕僓乕偺埨慡惈傪崅傔偰偄傞丅 Google偺乽Gemini for Home乿偑擔杮岅偵懳墳丂擔杮偱傕憗婜傾僋僙僗偺庴晅傪奐巒

Google偺乽Gemini for Home乿偑擔杮岅偵懳墳丂擔杮偱傕憗婜傾僋僙僗偺庴晅傪奐巒

Google偺僗儅乕僩儂乕儉僨僶僀僗岦偗偺AI僄乕僕僃儞僩乽Gemini for Home乿偑擔杮岅偵懳墳偟丄擔杮偵偍偗傞憗婜傾僋僙僗傪庴偗晅偗巒傔偨丅嵟怴偺乽Google Home乿傾僾儕偐傜怽偟崬傓偙偲偱弴師棙梡偱偒傞傛偆偵側傞丅 Google Gemini妶梡乽儔僀僽東栿乿採嫙奐巒丂70埲忋偺尵岅傪僿僢僪僼僅儞宱桼偱懄東栿

Google Gemini妶梡乽儔僀僽東栿乿採嫙奐巒丂70埲忋偺尵岅傪僿僢僪僼僅儞宱桼偱懄東栿

Google偼丄Gemini偺怴偟偄壒惡懳栿婡擻傪妶梡偟偨乽儔僀僽東栿乿傪擔杮偺Android偍傛傃iOS斉傾僾儕偱採嫙奐巒偟偨丅偙偺婡擻偼榖偟庤偺惡偺僩乕儞傗儕僘儉傪堐帩偟側偑傜儕傾儖僞僀儉偱東栿傪峴偆丅棙梡幰偼僿僢僪僼僅儞傪捠偠偰丄奀奜偱偺島媊傗擔忢夛榖傪傛傝帺慠側宍偱棟夝偱偒丄70埲忋偺尵岅偱妶梡壜擻偲側偭偰偄傞丅 Google乽儊僢僙乕僕乿傾僾儕偱Gemini偲擔杮岅偱夛榖壜擻偵

Google乽儊僢僙乕僕乿傾僾儕偱Gemini偲擔杮岅偱夛榖壜擻偵

Android偺乽儊僢僙乕僕乿傾僾儕偱惗惉AI乽Gemini乿偲擔杮岅偱夛榖偱偒傞傛偆偵側偭偨乮儘乕儖傾僂僩拞乯丅棙梡壜擻偵側傞偲Gemini偐傜儊僢僙乕僕偑撏偔丅

娭楢儕儞僋

Copyright © ITmedia, Inc. All Rights Reserved.

傾僋僙僗僩僢僾10

- 僜僼僩僶儞僋丄攧忋崅7挍墌撍攋偱夁嫀嵟崅峏怴丂乬儂僢僺儞僌梷惂乭偺峔憿夵妚偲乽AI僀儞僼儔乿傊偺戝揮姺 乮2026擭05寧11擔乯

- 戝暆嶞怴偺乽iAEON乿乽AEON Pay乿傾僾儕偼壗偑曄傢偭偨丠丂巊偄暘偗曽傗曋棙側婡擻傪夝愢 乮2026擭05寧12擔乯

- Google専嶕偑僒乕僶乕僄儔乕偱晄埨掕偵丂乽僌僌傟側偄乧乧乿偲偺惡憡師偖丂 乮2026擭05寧12擔乯

- 僗儅儂峸擖帪偺乽妱堷惂尷娚榓乿偼儊儕僢僩偽偐傝偱偼側偄丠丂実懷僔儑僢僾揦堳偑岅傞乬棪捈側堄尒乭 乮2026擭05寧12擔乯

- 僜僼僩僶儞僋偑乽崱夞傕傗傞乿偲Galaxy S26傪寧妟1墌偱斕攧乗乗斕攧曽朄傪憗媫偵尒捈偝側偄偲揚戅傪敆傜傟傞儊乕僇乕傕 乮2026擭03寧08擔乯

- 乽Pixel 10乛10a乛9a乿偳傟傪攦偆丠丂4僉儍儕傾6僽儔儞僪偺壙奿傪斾妑丂2擭24墌傗堦妵4.5枩墌傕 乮2026擭05寧11擔乯

- 僀僆儞儌僶僀儖偺2025擭捠怣懍搙傪岞昞丂暯擔偺僪僐儌夞慄偑嬯愴丄壓傝1Mbps晅嬤偺帪娫懷偑憹壛 乮2026擭05寧11擔乯

- 乽iPhone 14乿偑乽iPhone SE乮戞3悽戙乯乿傪媡揮偟偰1埵偵丂僎僆偺4寧拞屆僗儅儂儔儞僉儞僌 乮2026擭05寧11擔乯

- 僜僯乕偺拝傞僄傾僐儞乽REON POCKET乿3儌僨儖偺摿挜偲慖傃曽亂2026擭嵟怴斉亃 乮2026擭05寧12擔乯

- 傢偢偐3僞僢僾偱巆崅偑徚偊傞丠丂PayPay乽憲嬥嵓媆乿偵梫拲堄丄憲嬥偼曗彏偺懳徾奜偱庢傝栠偣偢 乮2026擭05寧12擔乯