写真から本人そっくりの動画をAIで生成 フェイク動画を後押しするリスクも:ITはみ出しコラム

先日、SNS×動画の力の脅威について実感することがありました。米民主党のナンシー・ペロシ下院議長がインタビューでなんだか酔っぱらっているような話し方をしている動画がYouTubeで公開され、瞬く間にTwitterやFacebookで拡散したのです。トランプ大統領も喜々としてツイートしました(後に削除)。

米Washington Postの記者、ドリュー・ハーウェル氏が、この動画が低レベルな動画編集方法で偽造したフェイク動画だと記事で喝破し、YouTubeとTwitterはサービス上から動画を削除しましたが、Facebookではこれを書いている今、まだ残っていて、既に255万回再生されています。

見てみると、動作が緩慢で、ろれつが回っていないように聞こえます。Facebookに投稿したのは保守的なFacebookページ「Politics WatchDog」で、添えられている説明は「ナンシー・ペロシ下院議長、トランプ大統領によるインフラ会議打ち切りについて語る:それはとてもとてもとても奇妙でした」というもので、あたかもインタビューの収録をそのまま掲載しているようです。

でもWashington Postの記事によると、これは動画をスロー再生して編集したもの。スローにすると音声は低くなりますが、簡単にピッチを上げることができます。記事には編集前の映像も紹介されているので、これがフェイク動画だということは一目瞭然。

こういう、高度な技術を必要としない手軽なフェイク動画は「シャロー(浅い)フェイク」と呼ばれています。もともと、AIを使って作る本格的なフェイクを「ディープフェイク」と呼ぶことから来ています。

シャローフェイクでもこれだけ拡散して影響を与えるのだから、これからディープフェイクが本物と見分けがつかなくなってきたら、取り締まるのは難しくなりそうです。

それを実感する動画を、SamsungのAI Center(ロシアのモスクワにある)の研究者らがYouTubeで公開しました。「Few-Shot Adversarial Learning of Realistic Neural Talking Head Models」というタイトルです。

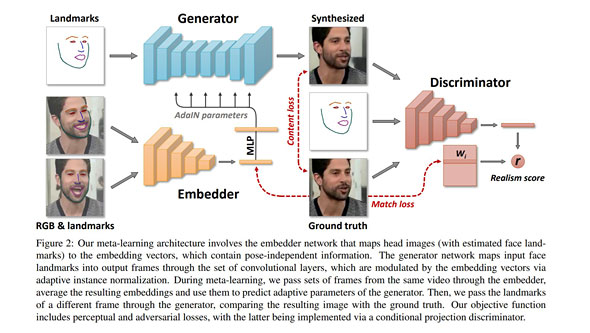

ディープラーニングの手法の1つ、GAN(敵対的生成技術)を使った、人が会話する動きの頭部モデルを使えば、数枚の顔写真を元にその顔の人が会話している動画を作れるよ、という内容です。

動画と論文(リンク先はPDF)にもあるように、GANを使った動画作成ツールは既に幾つかありますが、それらと比較してもかなり自然です。

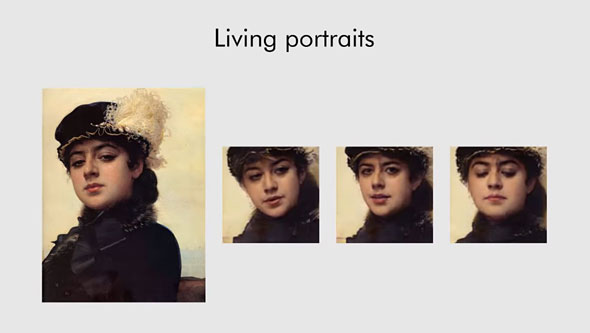

サンプルとして文豪ドストエフスキー(動画の4分40秒目あたり)やクラムスコイの名作「忘れえぬ女」(4分55秒目あたり)を使っているのがさすがロシア。いずれも元にした画像は1枚です。

この手法は「Few-Shot Learning(少数ショット学習)」というそうですが、1ショットでも学習できてしまいます。この写真を動かすための動きの方を作るのは大変で、敵対的訓練を受けたディープコンボリューションネットワーク(ConvNets)とやらを使って、顔の多数の部位のランドマークで構成する、動くお面みたいなものを作ります。薄ぼんやり理解した範囲では、このお面のランドマークを顔写真のランドマークに変換して写真を動かすという感じだと思います。

課題としては、人間の顔のランドマークは人によってかなり違うので、汎用(はんよう)的なお面では自然に動かせない顔もあること。

でもこれができるということは、ペロシさんのように多数の映像が公開されている著名人であれば、本人の映像からお面を作ることもできるでしょう。あるいは、骨格がそっくりな人にひどいことを言わせる動画からお面を作ってペロシさんの顔写真で動かせば、本物みたいに見えるかもしれません。

立派なAIラボを持つFacebookでさえ、シャローフェイク動画をフェイクだと判断するのにものすごく時間がかかりました(しかも「編集した動画を掲載するのはポリシー違反じゃない」としてこの動画は削除しない方針だそうです)。

ディープフェイクを禁じる法案も出されていますが、ディープフェイクかどうかを技術的に見破れるのかどうかはまた別の問題です。

関連記事

「一線を越えたARの軍事利用」に反対するMicrosoftの従業員たち

「一線を越えたARの軍事利用」に反対するMicrosoftの従業員たち

米Microsoftが大幅にスペックアップした「HoloLens 2」を発表。進化したAR(拡張現実)のテクノロジーは、軍事にもどんどん入り込みつつあります。そんな中、同社が米陸軍省と交わした契約について、従業員有志が反対運動を始めました。 「会話の健全性」を掲げるTwitterの明日はどっちだ?

「会話の健全性」を掲げるTwitterの明日はどっちだ?

最近はレガシーAPI終了やアカウント凍結騒動で何かと慌ただしいTwitter。エコシステムを育てる気がない、と言われることもありますが、本当にそうなのでしょうか? ネットの自由と著作権はもっとうまく両立できる? 物議を醸すEUの著作権新指令案

ネットの自由と著作権はもっとうまく両立できる? 物議を醸すEUの著作権新指令案

欧州連合(EU)では、新しい著作権についての指令案が物議を醸しています。この著作権新指令案は7月5日(現地時間)に否決されましたが、9月の再投票に向けて改善していきます。 人工知能の悪用を防ぐために OpenAIの論文が示すリスクとは?

人工知能の悪用を防ぐために OpenAIの論文が示すリスクとは?

シンギュラリティによってAIが人類を支配する世界がやって来るかどうかはさておき、現時点では人間がAIを悪用するリスクの方が怖そうです。 AmazonではAIが社員の仕事を着々と奪っている?

AmazonではAIが社員の仕事を着々と奪っている?

膨大なユーザー数のデータを持ち、強力なクラウドサービスも持つ米Amazon。当然ながら社内でもAI活用は進んでいますが、そのせいで居心地が悪くなっている社員もいるようです。 Amazon Echoが夫婦の会話を勝手に録音して送信 どうしてこうなった?

Amazon Echoが夫婦の会話を勝手に録音して送信 どうしてこうなった?

シアトルのとある家庭で、Amazon Echoが夫婦の会話を勝手に録音して、しかも他人に送信してしまうというトラブルが発生しました。その原因と対策について考えます。 「障害のある人にAIができること」 MicrosoftとGoogleのアクセシビリティ最前線

「障害のある人にAIができること」 MicrosoftとGoogleのアクセシビリティ最前線

Microsoftの「Build 2018」、Googleの「Google I/O 2018」――2社の年次開発者会議が続いた1週間。両社とも障害のある人を支援するAI活用の発表が印象に残りました。

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- 発表時の批判は裏返る? スペック据え置きでも“買い”と言える、極上の普段着スマホ「Pixel 10a」を触ってみた (2026年04月27日)

- サイボウズの社名由来 “坊主”に込められた意味が深すぎる (2016年07月29日)

- キーボード「FILCO」ブランドのダイヤテックが閉業 4月22日付で (2026年04月24日)

- マザーボードは「細部まで白」が今の主流? 高コスパ水冷など見逃せない最新自作PCパーツ事情 (2026年04月27日)

- 大型連休前のアキバは新CPUラッシュ! AMD「Ryzen 9 9950X3D2」とIntel「Core Ultra 5 250K Plus/KF Plus」の気になる在庫状況 (2026年04月25日)

- 次期「DaVinci Resolve 21」で写真編集が可能に/Google Cloudが第8世代TPUを発表 (2026年04月26日)

- エレコム、士郎正宗デザインマウス「M.A.P.P.」復刻モデルの予約販売を4月6日に開始 (2026年03月25日)

- 持ち運びを極めた超軽量キーボード「ロジクール KEYS TO GO 2」が17%オフの9980円に (2026年04月23日)

- エレコム、「士郎正宗 復刻マウス」発売日を延期 5月下旬の予定に (2026年04月27日)

- 部屋の雰囲気を一瞬で変えられる「SwitchBot RGBIC フロアライト」が15%オフの7633円に (2026年04月24日)