「iPhone 15 Pro」のカメラ使いこなし術 “写真機”としての進化を作例とともに振り返る:本田雅一のクロスオーバーデジタル(2/5 ページ)

iPhone 15 Pro世代で“自然さ”が出始めたチューニング

iPhone 11 Pro以来、Appleは写真を生成するプロセスについて、写真機的なアプローチを取り続ける形で進化させてきた。

ディテールをより詳細に深く描けるように、複数フレームを参照して時間軸方向にも展開するマルチタップ処理「Deep Fusion」を導入したり、新しい信号プロセスとして「Photonic Engine」を導入したり、Photonic Engineに対してユーザーがファインチューンを行える「フォトスタイル」を盛り込んだりと、新しいことに挑戦しながらも、写真文化に寄り添う考え方は一貫している。

とはいえ、良いコンセプトは必ずしも良い結果につながるとは限らない。冒頭に「異論はあるだろうが」と置いたのは、昔から写真文化に触れてきた人たちにとって、iPhoneのカメラが望ましい画質を実現していたかといえば、そうではない部分もあるからだ。

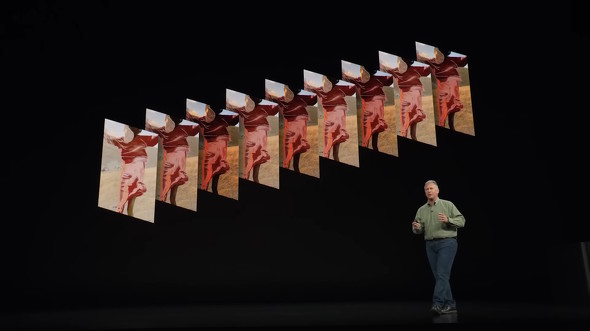

中でも、特に議論が大きく巻き起ったのは、iPhone XSから実装された「Smart HDR(スマートHDR)」だろう。この技術は複数フレームから露出情報を取得して集約した上で、被写体の領域ごとに異なる露出からディテールを取り出して合成する技術だ。

手動で露出ブラケット撮影を行い、それぞれのフレームから“おいしい”ところだけを取り出して合成するようなものだ。しかし、そのことが写真に不自然な結果をもたらすこともある。よって、SmartHDRを嫌う人も少なからずいる(機能をオフにすることも可能だが、デフォルトでは有効)。

筆者は毎年、ほぼ同じ場所でiPhoneの撮影テストを行っているが、iPhone 12 Proと最新のiPhone 15 Proでは、同じようなシーンでも、Smart HDRによる写りの風合いがかなり異なる。ひとまず、以下の写真を見比べてほしい。

iPhone 15 Proでの撮影時は、ちょうど天気が悪かった時期と重なってしまったため曇天となってしまった。それでも、見比べると初期(iPhone 12 Pro)と比べると、Smart HDRにありがちだった“あざとさ”が緩和されていることは分かる。

もちろん、普通のカメラで撮影した場合は、被写体と建物、空のディテールが全部出てくるなどあり得ないが、「フィルムから手動で紙に焼く際に、『覆い焼き』などの手法で調整した写真」といえなくもなかろう。

iPhoneが搭載する「Neural Engine」は、多様な情報から総合的に判別する処理に使われている。その能力が高まることで判別制度が高まり、結果的にファインチューンが進んでいる――そんなことなのだろう。

よくよく見てみると、iPhone 15 Proでもまだ完璧とは言いきれない。それでも、髪の毛周辺の分離は、より自然となっている。同じ考え方を貫いて改良を加え、そこからより改良を加えて……というプロセスを繰り返しを行っているのだ。

スマホがもはや毎年買い替えるものではないと考えるなら、iPhone 12 Proでの写真との比較は納得できるものではないだろうか。

関連記事

「iPhone 13」「13 Pro」を試して分かったこだわりの違い コンピュテーショナルフォトグラフィーはここまで進化した

「iPhone 13」「13 Pro」を試して分かったこだわりの違い コンピュテーショナルフォトグラフィーはここまで進化した

これまでiPhoneのファーストインプレッションでは、SoCとその使い方といった視点でコラムを書くことも多かったが、今回の「iPhone 13」世代ばかりはカメラにかなりフォーカスした記事にせざるを得ない。評価用端末を使い始めてすぐにそう感じた。 スマホ選びに悩んだら「iPhone 14 Pro」がベストか? iPhone 14シリーズを使い比べて分かったこと

スマホ選びに悩んだら「iPhone 14 Pro」がベストか? iPhone 14シリーズを使い比べて分かったこと

間もなく、「iPhone 14」「iPhone 14 Pro」「iPhone 14 Pro Max」が発売される。例年の新型iPhoneと比べると、「非Pro」と「Pro」の差が大きめである印象だが、実際の所はどうなのだろうか。実際に使い比べて検証してみよう。 「連係カメラ」でiPhoneとMacの配信画質が格段にアップ! Webカメラとの決定的な違い

「連係カメラ」でiPhoneとMacの配信画質が格段にアップ! Webカメラとの決定的な違い

Appleが「WWDC22」で発表した、iPhoneとMacを使った「連係カメラ」機能は、思った以上にビデオ会議や配信などで役立ちそうだ。 基本の「iPhone 11」か、冒険の「11 Pro」か 現地取材で分かった違い

基本の「iPhone 11」か、冒険の「11 Pro」か 現地取材で分かった違い

米Appleのスペシャルイベントで発表された「iPhone 11」と「iPhone 11 Pro」シリーズ。基調講演から感じ取れたメッセージと、実機に触れたインプレッションを現地からお届けする。 「iPhone 11」「11 Pro Max」を試して実感したカメラ大幅進化 そして将来の強みとは

「iPhone 11」「11 Pro Max」を試して実感したカメラ大幅進化 そして将来の強みとは

9月20日の販売開始に先駆けて数日間、「iPhone 11」「iPhone 11 Pro Max」を試用した。進化したカメラの実力を中心として、実機に触れて試してみたインプレッションをお届けする。

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- 発表時の批判は裏返る? スペック据え置きでも“買い”と言える、極上の普段着スマホ「Pixel 10a」を触ってみた (2026年04月27日)

- サイボウズの社名由来 “坊主”に込められた意味が深すぎる (2016年07月29日)

- キーボード「FILCO」ブランドのダイヤテックが閉業 4月22日付で (2026年04月24日)

- マザーボードは「細部まで白」が今の主流? 高コスパ水冷など見逃せない最新自作PCパーツ事情 (2026年04月27日)

- 大型連休前のアキバは新CPUラッシュ! AMD「Ryzen 9 9950X3D2」とIntel「Core Ultra 5 250K Plus/KF Plus」の気になる在庫状況 (2026年04月25日)

- 次期「DaVinci Resolve 21」で写真編集が可能に/Google Cloudが第8世代TPUを発表 (2026年04月26日)

- エレコム、士郎正宗デザインマウス「M.A.P.P.」復刻モデルの予約販売を4月6日に開始 (2026年03月25日)

- エレコム、「士郎正宗 復刻マウス」発売日を延期 5月下旬の予定に (2026年04月27日)

- 持ち運びを極めた超軽量キーボード「ロジクール KEYS TO GO 2」が17%オフの9980円に (2026年04月23日)

- 15.6型モバイルディスプレイ「ASUS ZenScreen MB169CK-J」が21%オフの1万7172円に (2026年04月27日)