Intel Ignite 2023で優勝! AV1やH.266を超える圧縮率を実現するDeep Renderの「AIベースの動画圧縮技術」って何?:Intel Ignite 2023(2/4 ページ)

Deep Renderの「AI圧縮技術」は何が違う?

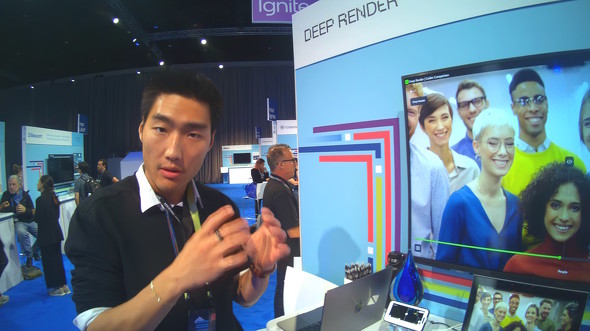

ここまでを踏まえた上で、Deep Renderの「AIベースの圧縮アルゴリズム」とはどのようなものなのかを、Deep Renderのジャン・スー氏(シニアリサーチエンジニア)と、クリ・ベセンバーチ氏(共同創業者)に聞いてみた。

スー氏は「特許絡みで公にできない、あるいは公開しない概念もある」と前置きをしつつも、自社の技術について、いくつかの重要な“ヒント”を説明してくれた。同氏とベセンバーチ氏の話を聞くと、Deep Renderの「AI圧縮技術」はMPEG系の動画圧縮技術と似ている部分と、似ていない(ユニークな)部分の両方が混在していることが分かった。

まず、似ている部分としては空間的な「フレーム内圧縮」と、時間方向の「フレーム相関圧縮」の概念を取り入れていることが挙げられる。一方で、ユニークなポイントとして各フレームをブロックに分解して処理していないのだという。

Deep Renderでは、フレーム内圧縮に「CNN(Convolutional Neural Network:畳み込みニューラルネットワーク)」ベースのAIを活用しているという。話を聞く限りでは、着目しているフレーム内の適当な箇所に配置した「CNNカーネル」に、そこを基点とした全周領域の相似性を求めさせて、高い相似性があれば分布情報を量子化していく――というアルゴリズムとしているらしい。

相似性の解析にブロックを用いないため、原理的に低ビットレートでもブロックノイズが発生しないのだという。CNNカーネルをフレーム内の「どこに」「どのくらい(いくつ)」「どういう基準で」配置するのかは説明してもらえなかったが、イメージとしてはMPEG系動画圧縮技術において離散コサイン変換を使う部分を、CNNベースのAIで置き換えているようである。ゆえに、これまた原理上低ビットレートでもモスキートノイズが発生しないそうだ。

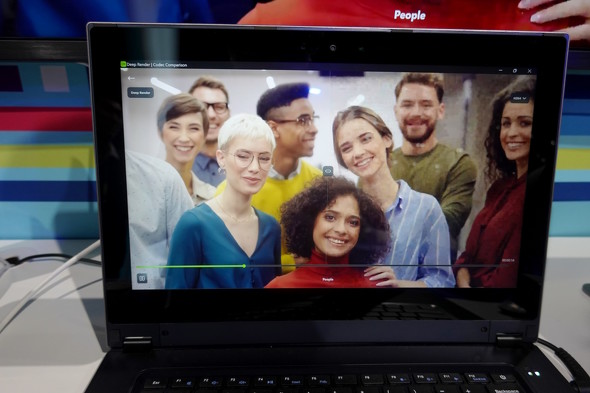

ブロックノイズは「圧縮率が高すぎる(≒ビットレートが低すぎる)」ことによって起こることが多い。Deep Renderでは、ブロック単位で相似性解析を行わないため、低ビットレートでもブロックノイズが発生しないという(画像はイメージ図)

ブロックノイズは「圧縮率が高すぎる(≒ビットレートが低すぎる)」ことによって起こることが多い。Deep Renderでは、ブロック単位で相似性解析を行わないため、低ビットレートでもブロックノイズが発生しないという(画像はイメージ図) モスキートノイズは、色や明るさの変化が激しい箇所にモスキート(蚊)のように細かく発生するノイズだ。動画の場合、離散コサイン変換を行う際に発生しがちだが、Deep RenderではCNNベースのAIで画像の相似性を判断するため、モスキートノイズも発生しないそうだ(画像はイメージ図)

モスキートノイズは、色や明るさの変化が激しい箇所にモスキート(蚊)のように細かく発生するノイズだ。動画の場合、離散コサイン変換を行う際に発生しがちだが、Deep RenderではCNNベースのAIで画像の相似性を判断するため、モスキートノイズも発生しないそうだ(画像はイメージ図)Deep Renderでは、時間方向のフレーム間の相似性もCNNベースのAIで相似性を探索する。

MPEG系の動画圧縮技術ではフレーム内のブロック単位で「動きベクトル(Motion Vector)」を検出することで動き補償を行っている。しかし、先述の通りDeep Renderではそもそもブロック分解を行っていないため、同じ方法は使えない。そこで代替手段として、Deep Renderでは「Optical Flow」という概念を使ってフレーム間の相似性を検出し、動き補償を行っている。

Optical Flowは、直訳すると「光学的な流れ(動き)」という意味だが、意訳すると「映像における光の移り変わり」という意味。昨今のデジタル画像解析(特にコンピュータービジョン分野)では、よく使われる定番キーワードだ。

Deep Renderでは、Optical Flowを活用してフレーム内のオブジェクト(物体)の移動を追跡することで動き補償を行い、圧縮率を高めている。オブジェクトが複雑な形状でもしっかりと追跡できるそうだ。

Deep Renderによると、現在の試作版ではH.264/H.265と同等画質なら5倍程度の圧縮率を達成しているという。これからも各部分のチューニングと改良を進めるとのことで、圧縮率を50倍にまで高められる見通しが立っていると豪語する。

これが本当ならば、1層のBlu-ray Discでなければ録画できない25GBの動画を、単にCD-Rに収められるだけでなく、容量が約150MB余ることになる。なかなかにスゴい。

関連記事

地上波でも「4K/60fps」が当たり前に? 総務省の審議会が「次世代地デジ」の技術的条件を答申 実現に向けて大きな一歩

地上波でも「4K/60fps」が当たり前に? 総務省の審議会が「次世代地デジ」の技術的条件を答申 実現に向けて大きな一歩

総務省において「次世代(高度化)地上波デジタルテレビ放送」の技術的条件が答申された。これにより、現行の「地デジ」の後継規格を策定する作業が加速するものと思われる。 薄型モバイル向け「Ryzen 7040U」登場 Zen 4+RDNA 3にRyzen AI(一部)で「Apple M2やCore i7-1360Pよりも高速」

薄型モバイル向け「Ryzen 7040U」登場 Zen 4+RDNA 3にRyzen AI(一部)で「Apple M2やCore i7-1360Pよりも高速」

AMDのモバイル向けAPU「Ryzen 7040シリーズ」に、メインストリームの「Uプロセッサ」が登場する。AIプロセッサは上位製品にのみ搭載されるが、CPUコアやGPUコアのパフォーマンスアップは、全ての製品に恩恵があるようだ。 モバイル向けGPU「Intel Arc Aシリーズ」が発進 スペック別に3シリーズを順次投入

モバイル向けGPU「Intel Arc Aシリーズ」が発進 スペック別に3シリーズを順次投入

Intelが、モバイル向けGPU「Intel Arc Aシリーズ」を正式に発表した。米国ではエントリー製品を搭載するノートPCの受注が始まっており、4月から搭載製品が順次お披露目される見通しだ。 NVIDIA、ワークステーション向けGPU「NVIDIA RTX A2000」を発表

NVIDIA、ワークステーション向けGPU「NVIDIA RTX A2000」を発表

NVIDIAは8月10日、新たなGPUとして「NVIDIA RTX A2000」を発表した。価格は450ドルで、10月より発売される予定だ。 「Tiger Lake」×「Iris Xe MAX Graphics」はなぜ速い? インテルが説明

「Tiger Lake」×「Iris Xe MAX Graphics」はなぜ速い? インテルが説明

Intelが久しぶりの外部GPU製品として発売した「Iris Xe MAX Graphics」。Tiger Lakeと協調動作することでより高速に動作することが特徴だ。その仕組みを、日本法人であるインテルが説明した。

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- Windows 11のレスポンス改善が徐々に浸透中 最新アップデートの実力とMicrosoft AI戦略の転換点 (2026年06月01日)

- ついに日本でも販売を開始したAIグラス「Ray-Ban Meta(Gen 2)」実機レビュー 完成度は高いが課題も (2026年05月29日)

- NVIDIAがPC向けArm SoC「N1/N1X」で帰還? Windowsとの“匂わせ”から読み解く次世代ハードとPC市場 (2026年05月31日)

- Intel、最大288コアの「Xeon 6+」を正式発表 次世代GPU「Crescent Island」の計画も (2026年06月01日)

- 「数字を追い過ぎた失敗」は繰り返さない ノジマ傘下のVAIO 糸岡社長が目指す「新しい理想工場」と再成長 (2026年06月01日)

- DDR4メモリでもまだ戦える!! AMDが「Socket AM4」の10周年を祝う Carbice Ice Pad付きの「Ryzen 7 5800X3D」記念パッケージを349ドルで投入 (2026年06月01日)

- デル、MacBook Neo対抗の新型「XPS 13」発表 12.7mm、1kgでシリーズ最薄/最軽量 699ドルから (2026年06月01日)

- Appleが新しい画像圧縮技術「PICO」をGitHubで発表/「Googlebook」はArmベースのSoCを採用 (2026年05月31日)

- 片手で持てる55万円の超ハイスペックミニPC「MINIX ER939-AI」が登場! 夏向け冷却台の新製品も (2026年05月30日)

- 所有しているのに、手元にないように感じる不思議さ ミニスパコン「NVIDIA DGX Spark」と過ごした1カ月 (2026年05月27日)