Intel Ignite 2023で優勝! AV1やH.266を超える圧縮率を実現するDeep Renderの「AIベースの動画圧縮技術」って何?:Intel Ignite 2023(3/4 ページ)

「NPU」さえあれば使えるDeep Render

Intel Innvoation 2023のDeep Renderブースでは、Deep Render形式で圧縮した動画を、Neural Engile(NPU)を備えるiPhone、同エンジンを備えるM1/M2チップ搭載のMac、そして12月14日(米国太平洋時間)に正式発表される「Core Ultraプロセッサ」を搭載するノートPCでH.264形式の動画と同時再生するデモンストレーションが行われていた。

Deep Render形式の動画のデコード(展開)は、NPUさえ搭載していればスマホでも十分に行えるようだ。

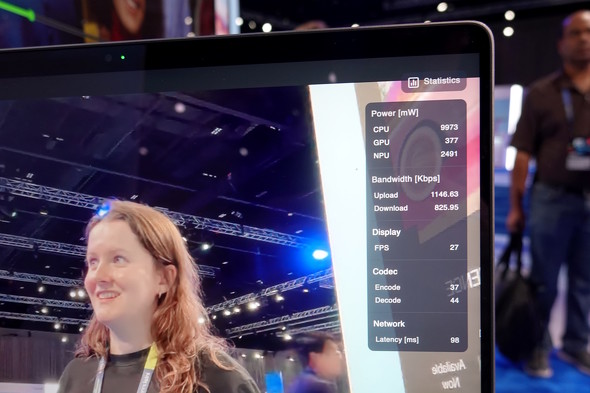

ブースでは、2台のMacBookシリーズを用いて、互いのWebカメラで撮影した映像をリアルタイムにDeep Render形式でエンコード(圧縮)し、互いにデコードするというビデオ(Web)会議を模したデモンストレーションも行われた。このデモでは、30fpsのフルHD(1920×1080ピクセル)映像を1Mbpsでエンコードして送り、同時に相手側から送られてきた同等品質の映像をデコードする、という実践さながらのものだった。

遅延(レイテンシ)は、0.1秒程度で十分に許容範囲だ。Deep Renderの説明によると、この遅延のうち0.04〜0.05秒がコーデック処理によるもので、残りがデモ環境のWi-Fiネットワークによるものだという。

この際のプロセッサの消費電力は約13Wだった。エンコードとデコードを同時にソフトウェアで行って程度であれば、まずまずといったところか。

M2チップ搭載のMacBook Airによるビデオ会議のライブデモ。実際に2台のMacBook Airを使い、それぞれのWebカメラからの映像を送り合う内容となっていた。画面の中の女性は、写真奥の向こう側で立っている女性の前に置いてある、もう1台のMacBook Airからの映像だ

M2チップ搭載のMacBook Airによるビデオ会議のライブデモ。実際に2台のMacBook Airを使い、それぞれのWebカメラからの映像を送り合う内容となっていた。画面の中の女性は、写真奥の向こう側で立っている女性の前に置いてある、もう1台のMacBook Airからの映像だDeep Renderコーデックは、主にGeForce RTX 30/40シリーズを搭載するマシンで開発を進めてきたが、GPGPUとして活用できるGPUであれば、メーカーやモデル(アーキテクチャ)を問わず利用できるという。また、スペックによって多少のパフォーマンス差は生じるものの、NPUを含む推論アクセラレーターを統合したCPUでも動くとのことだ。

先述の通り、今回はCore Ultraプロセッサを搭載するノートを使ったデモンストレーションも行われていたが、デコードとエンコードは主にNPUで処理しているとのことだった。

Deep Renderのユー氏は「もし事業が軌道に乗って、Deep Renderの採用事例が増えてくれば、現在はソフトウェアベースのエンコーダー/デコーダーがハードウェア化されて、今のH.264やH.265のように多くのSoC(のメディアエンジンなど)が対応するかもしれない」と、未来の展望を語っていた。

ハードウェアベースのDeep Renderエンコーダー/デコーダーの“搭載事例1号”は、もしかすると今回彼らを優勝者としたIntelかもしれない。

Deep Renderは「圧縮技術の再構築」を掲げて活動している。高画質と高圧縮を両立することで、通信速度の遅い環境でも高画質な映像を楽しめるようにするだけでなく、インターネットの世界を悩ませるトラフィック(総通信量)の削減も目指している

Deep Renderは「圧縮技術の再構築」を掲げて活動している。高画質と高圧縮を両立することで、通信速度の遅い環境でも高画質な映像を楽しめるようにするだけでなく、インターネットの世界を悩ませるトラフィック(総通信量)の削減も目指しているただ、コーデックとしてのDeep Renderの普及に当たって、課題もある。

関連記事

地上波でも「4K/60fps」が当たり前に? 総務省の審議会が「次世代地デジ」の技術的条件を答申 実現に向けて大きな一歩

地上波でも「4K/60fps」が当たり前に? 総務省の審議会が「次世代地デジ」の技術的条件を答申 実現に向けて大きな一歩

総務省において「次世代(高度化)地上波デジタルテレビ放送」の技術的条件が答申された。これにより、現行の「地デジ」の後継規格を策定する作業が加速するものと思われる。 薄型モバイル向け「Ryzen 7040U」登場 Zen 4+RDNA 3にRyzen AI(一部)で「Apple M2やCore i7-1360Pよりも高速」

薄型モバイル向け「Ryzen 7040U」登場 Zen 4+RDNA 3にRyzen AI(一部)で「Apple M2やCore i7-1360Pよりも高速」

AMDのモバイル向けAPU「Ryzen 7040シリーズ」に、メインストリームの「Uプロセッサ」が登場する。AIプロセッサは上位製品にのみ搭載されるが、CPUコアやGPUコアのパフォーマンスアップは、全ての製品に恩恵があるようだ。 モバイル向けGPU「Intel Arc Aシリーズ」が発進 スペック別に3シリーズを順次投入

モバイル向けGPU「Intel Arc Aシリーズ」が発進 スペック別に3シリーズを順次投入

Intelが、モバイル向けGPU「Intel Arc Aシリーズ」を正式に発表した。米国ではエントリー製品を搭載するノートPCの受注が始まっており、4月から搭載製品が順次お披露目される見通しだ。 NVIDIA、ワークステーション向けGPU「NVIDIA RTX A2000」を発表

NVIDIA、ワークステーション向けGPU「NVIDIA RTX A2000」を発表

NVIDIAは8月10日、新たなGPUとして「NVIDIA RTX A2000」を発表した。価格は450ドルで、10月より発売される予定だ。 「Tiger Lake」×「Iris Xe MAX Graphics」はなぜ速い? インテルが説明

「Tiger Lake」×「Iris Xe MAX Graphics」はなぜ速い? インテルが説明

Intelが久しぶりの外部GPU製品として発売した「Iris Xe MAX Graphics」。Tiger Lakeと協調動作することでより高速に動作することが特徴だ。その仕組みを、日本法人であるインテルが説明した。

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- キーボード「FILCO」ブランドのダイヤテックが閉業 4月22日付で (2026年04月24日)

- 次期「DaVinci Resolve 21」で写真編集が可能に/Google Cloudが第8世代TPUを発表 (2026年04月26日)

- 大型連休前のアキバは新CPUラッシュ! AMD「Ryzen 9 9950X3D2」とIntel「Core Ultra 5 250K Plus/KF Plus」の気になる在庫状況 (2026年04月25日)

- 持ち運びを極めた超軽量キーボード「ロジクール KEYS TO GO 2」が17%オフの9980円に (2026年04月23日)

- Windows 11の使い勝手はどう変わる? 「Copilot」名称外しやInsider Program再編に見るMicrosoftの本気度 (2026年04月24日)

- ACアダプター不要の外付けHDD「Seagate One Touch Desktop External Hard Drive」を試す 超大容量で配線スッキリ (2026年04月24日)

- 部屋の雰囲気を一瞬で変えられる「SwitchBot RGBIC フロアライト」が15%オフの7633円に (2026年04月24日)

- 「Apple AirPods 4」が20%オフの2万3798円に (2026年04月24日)

- 2026年版Surfaceはどうなる? 正面衝突を避けるMicrosoft、10万円切り「MacBook Neo」対抗への秘策はあるか (2026年04月21日)

- 強力なドッキングステーション「Anker PowerExpand Elite 13-in-1 Thunderbolt 3 Dock」が28%オフの2万6490円に (2026年04月23日)