なぜAppleは「半導体」と「製品」のトップを統合したのか クック退任より重要な「CHO新設」と究極の垂直統合:本田雅一のクロスオーバーデジタル(4/4 ページ)

新体制で「Apple Vision Pro」の開発は進むのか?

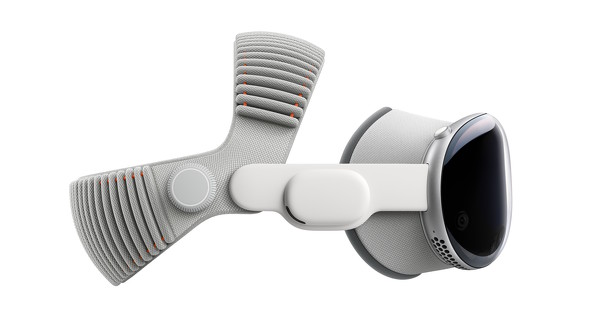

オンデバイスAI以上に、統合設計力が問われるのが空間コンピューティングだ。Apple Vision Proは、技術的には“綱渡り”の上で成立している製品といっていい。

現行モデルではM5チップと専用コプロセッサとしてR1チップを同時搭載し、12個のカメラと5個のセンサー、LiDARを同期させ、最大90Hz駆動の両眼合計で約2300万画素のマイクロOLED(有機ELディスプレイ)を稼働する。さらに、任意の位置から音を発しているように感じさせる空間音響処理も実施している。

これだけのことを、頭部装着型のデバイスでこなしているのだ。

中でも重要なのが、R1チップだ。センサー入力からディスプレイへの反映を12ミリ秒以下に抑えるため、M2チップから独立してリアルタイムの入出力処理を担う。

VRデバイスにおける「酔い」の多くは、表示の遅延に起因する。R1チップは、その遅延を人の知覚に先回りするレベルまで下げることにある。これは、「シリコン」「ボディー」「光学系」を同時に設計できなければ実現しにくい解決策だ。

初代のApple Vision Proは3499ドルという価格設定と、600g超の重量ゆえに、普及には至らなかった。だが出荷を通じて、Appleは空間コンピューティングに必要な技術要素を自社で束ねられることを示した。マイクロOLEDの調達/統合、視線検出、センサーフュージョン、リアルタイム環境マッピング、空間音響――こうした技術を垂直に束ねられる企業は、現時点でもかなり限られている。

今後の後継機が普及帯に降りてくるには、「重量」「価格」「解像度」「視野角」の全てにおいて難しい課題を同時に超えなければならない。これには「半導体の微細化」「バッテリーの高密度化」「光学系の小型化」「ボディーの軽量化」「熱設計の刷新」のいずれかが欠けると成立しない。

もし空間コンピューティングで大きな進化が起きるなら、最も可能性が高いのはやはりAppleだろう。

そしてApple Vision Proの次に来る製品が、必ずしもヘッドセットにとどまるとは限らない。

例えばMetaの「Ray-Ban Metaグラス」は、軽量でディスプレイを持たないメガネ型デバイスにも需要があることを示した。Appleがどの形でこの領域に降りてくるのかは、ターナス新体制の最初の数年で少しずつ見えてくるはずだ。

2027年から2028年の製品で新体制の評価が定まる

今回のAppleの人事を長い視点で眺めると、シリコンとボディーとソフトウェアを一体で設計する、Appleのハードウェア思想の系譜が浮かび上がってくる。

「Apple II」を設計したスティーブ・ウォズニアック氏、「Macintosh」を作り上げたスティーブ・ジョブズ氏とアンディ・ハーツフェルド氏、「NeXT」のハードとOSの一体性、iMacからApple Silicon移行後のMacまで、Appleが繰り返してきたのは、常に垂直統合の思想だった。

クック体制の15年はそれを組織として完成させ、新体制におけるCHO新設はそれを経営体制の中へさらに深く組み込む動きだ。

成果が形になるのは、2027年から2028年にかけてだろう。M6チップ(仮)以降のMacの進化、Apple Vision Pro後継の普及帯への投入、まだ名前の付いていない新カテゴリー製品の登場――この数年は、Appleの垂直統合が次の段階へ進む瞬間を見る時期になる。

関連記事

ティム・クックがアップルCEOを退任 ジョン・ターナス氏が後任に

ティム・クックがアップルCEOを退任 ジョン・ターナス氏が後任に

Appleは、ティム・クック氏のCEO退任を発表した。 「MacBook Neo」を試して分かった10万円切りの衝撃! ただの“安いMac”ではなく絶妙な引き算で生まれた1台

「MacBook Neo」を試して分かった10万円切りの衝撃! ただの“安いMac”ではなく絶妙な引き算で生まれた1台

Appleが3月11日に発売する「MacBook Neo」は、最小構成で10万円を切る価格が特徴だ。これで「Macらしさ」はどうなのか、実際に使ってみた。 「Apple M1」のMacBook AirとPro、Mac miniを3台まとめて実力チェック 驚異的な性能が明らかに

「Apple M1」のMacBook AirとPro、Mac miniを3台まとめて実力チェック 驚異的な性能が明らかに

いち早く「Apple M1」搭載の新型Macに触れる機会を得たので、「MacBook Air」「MacBook Pro」「Mac mini」の3台を横並びで性能評価してみた。同じプロセッサでも性能に違い出るのか、そしておすすめのモデルはどれなのか。 ジョブズ氏の帰還からAI時代へ――Appleが描く「パーソナルAI」の未来は原点回帰なのか

ジョブズ氏の帰還からAI時代へ――Appleが描く「パーソナルAI」の未来は原点回帰なのか

1996年末のスティーブ・ジョブズ氏の復帰を皮切りに、AppleはNeXTのオブジェクト指向技術を取り入れ、次世代OSへの抜本的な刷新を図った。Appleが歩んだ50年のイノベーションの軌跡と未来を考えてみた。 Appleはいかにして「今日のAIやWeb」を予見したのか? “暗黒時代”とも呼ばれた1985〜1996年の光と影

Appleはいかにして「今日のAIやWeb」を予見したのか? “暗黒時代”とも呼ばれた1985〜1996年の光と影

1985年から1996年、スティーブ・ジョブズ氏が不在のAppleは混迷の時代を過ごしたが、この時期は現在のテクノロジーに通じる数多くの「未来の種」をまいた時代でもあった。本記事では、当時の野心的なプロジェクトの数々をひもとき、波乱に満ちた11年間の光と影に迫る。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- 高騰中のSSD、品薄のHDD──けれど“最終処分”のニーズは変わらず (2026年06月06日)

- デルのMacBook Neo対抗、薄型軽量ノートPC「XPS 13」実機に触れた! 現地取材で判明した詳細スペックと実力 (2026年06月05日)

- エアコンがない部屋を即冷却できる冷風機がセールで38%オフの8490円に (2026年06月04日)

- コンパクトボディーにスパコン並みのAI性能! 「NVIDIA RTX Spark」搭載ミニデスクトップPCを見てきた (2026年06月04日)

- HDMIケーブルの差し替えから解放されるセレクター「Anker HDMI Switch」がセールで20%オフの3190円に (2026年06月03日)

- これ、売ってもいいのでは? 「Snapdragon C」搭載WindowsノートPCのリファレンスモデルを見てきた (2026年06月05日)

- 3会場に拡大し来場者11万人超えの過去最大規模! 「COMPUTEX TAIPEI 2026」最終日レポート (2026年06月06日)

- Ryzen AI搭載で進化したASRockの超スリムデスクトップPCと「Taichi」10周年記念モデルを現地レポート (2026年06月06日)

- V8エンジン風クーラーや220mmファンケース、次世代GPU水冷も 見どころ満載なCooler Master展示レポート (2026年06月05日)

- AcerブースはMacBook Neo対抗の「Swift Air 14」や新SoC搭載「Predator Atlas 8」など注目PCが集結 (2026年06月05日)