iPhone 13シリーズの「シネマティックモード」が予想以上に面白かったのである(1/2 ページ)

iPhone 13シリーズの「シネマティック」モードが予想以上に面白かったのである。

Apple(に限らないけど)がその機能をどのくらい使ってほしいか、あるいはどのくらい力を入れているかはアプリを見ると分かる。何らかのメニューの中ではなく、写真、ビデオと並んだ位置に「シネマティック」があるのだ。「日常的に使ってね」って機能なのである。

シネマティックでぼけを楽しめ

iPhone 13のカメラで動画を撮ると、どうしてもパンフォーカス気味になる。ピントの合う範囲が広いので、至近距離の被写体を撮るときは背景がボケるけど、1mも離れた被写体を撮ると背景にまでざっくりピントが合ってしまう。

それが当たり前って感じで多くの人は慣れてしまっているのだけど、そこに一石を投じようというのがシネマティックモードだ。何しろ、ピントを合わせた被写体の前後がボケて「被写体が強調される」(見る人の視線をそこに誘導できる)のである。

試しに撮ってみたのがこちら。シネマティックモードで撮った3本の短いクリップを「iMovie」でつないでみたもの。

なんとなく分かってもらえたかと思う。人が大勢いても最初に捕まえた顔を追いかけてくれているし(改札から歩いてくるところ)、後ろ姿でもちゃんと捉えてくれるし、メインの被写体がいなくなると背景にフォーカスがすーっと移動している。

いったい何が起きているのか、どんなシーンで使えるのか、気になるよね。というわけでいろいろと試してみる。

実際にシネマティックオンとオフでどのくらい違うのか。シネマティックで撮った動画は後からボケ具合を調整できるので、それを利用して「一番ぼかしたもの」と「ぼけの処理を加えてないもの」を比較しよう。

シネマティックで撮った方が圧倒的に背景がきれいにぼけていて、人物に目が行く。シネマティックというと「映画っぽい映像を求めない人には不要」って思われそうだけど、これなら誰が使っても楽しそうじゃないか。

で、シネマティックモードでは何をやっているのか。よく、静止画の「ポートレート」モードの動画版という言い方をされる。静止画のポートレートモードでは2つのカメラ(超広角と広角、あるいは広角と望遠)の微妙な視差を利用してカメラと被写体の距離の情報を持ち、その深度情報を持って背景をぼかしている。

シネマティックも同じなのだけど、違うのはそれを「1秒間に30枚」分処理し、しかも常にフォーカスの対象がどれなのかを認識し、その上前景にもぼかし処理をいれているのだ(ポートレートモードでは背景のみ)。最新プロセッサのA15 Bionicパワーさく裂だ。

そしてこの機能が面白いのは「どこにピントを合わせるかもiPhoneまかせでOK」ってこと。顔に合わせるのはもちろんのこと、後ろ頭でもOK。

複数の人がいるときは自動的に切り替えてくれる。例えば、近くにいる後ろ頭の人より向こう側の顔が見えている人を優先。でもでは手前の人が振り返って後ろ頭になると、その向こうにいる人物に切り替わるという映画的な振る舞いをみせてくれる。

また、構図に人物が入ってくると即座に切り替わる。これがまた素早くて面白いので「電車を撮っていたらたまたま通りがかった人にピントを奪われた動画」を撮ってみた。フレームに人が入ってくる瞬間にはもうピントが切り替わっているという速さに注目。めっちゃ素早い。

被写体は人間じゃなくてもいい。今のiPhoneのカメラは犬や猫といった動物も認識してくれるわけで、シネマティックでも同様なのだ。ヤギでもOKである。これは3倍の望遠で撮ったもの。

シネマティックモードで使えるカメラは1xと3xのみ。視差を利用した深度情報が必要なので0.5xには未対応で、デジタルズームにも対応してない。この辺はポートレートモードと同じだ。せっかくなので、シネマティックヤギをどうぞ。何回かは鳴き声も入っています。

撮影時に画面をタップするだけでフォーカス相手を変えることもできる。写真アプリで「編集」を実行するとそのときどこにフォーカスが合っていたかを教えてくれるのでそれでチェックしてみたい。

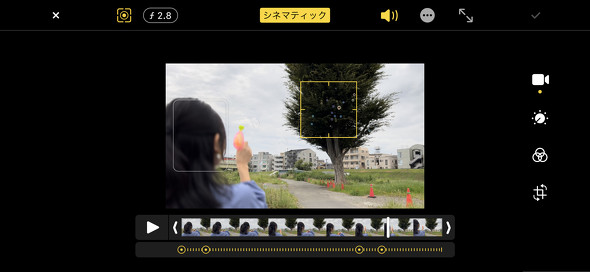

まずは動画。これ、自動的に彼女の頭にフォーカスが来る。シャボン玉マシンを構えたところで機械をタップしてそこにフォーカスを移し、最後は背景の木に持っていって、シャボン玉の行方を強調するという流れだ。

これを写真アプリで見ると、その時点でどこにフォーカスが合っていたかが分かる。

しかもこのシネマティックモード、編集後にフォーカスを変えられる。

関連記事

「iPhone 13 Pro」のカメラは総合的にピカイチ 気になる「マクロ機能」や「フォトグラフスタイル」もチェック

「iPhone 13 Pro」のカメラは総合的にピカイチ 気になる「マクロ機能」や「フォトグラフスタイル」もチェック

新型iPhoneが出たらやること、それはカメラレビューだ。「iPhone 13 Pro」のカメラはデザインこそ「iPhone 12 Pro」を引き継いでいて変わり栄えしないように思えるが、センサーが変わっていたり、気になる機能が追加されていたりと、いろいろ遊べるのである。 「iPhone 13」シリーズを試す 動画撮影が驚くほど楽しく、Proならではの新機能も魅力

「iPhone 13」シリーズを試す 動画撮影が驚くほど楽しく、Proならではの新機能も魅力

「iPhone 13」シリーズの発売に先立ち、4モデルの実機を試すことができた。デザインは先代のiPhone 12シリーズを継承しており、ノッチはやや小さくなった。カメラは新機能の「フォトグラフスタイル」と「シネマティックモード」が利用可能になり、Proは3倍の望遠カメラとマクロ撮影を使えるのが特徴だ。 iPhone 13/13 Proのカメラは何が変わった? 「ハード」と「ソフト」の進化まとめ

iPhone 13/13 Proのカメラは何が変わった? 「ハード」と「ソフト」の進化まとめ

iPhone 13シリーズで進化を遂げたカメラについて、ハードウェアとソフトウェアの視点からまとめてみる。iPhone 13 Proは超広角カメラにAFが付いて、マクロ撮影が可能になった。コンピュテーショナルフォトグラフィーで注目したいのが、撮影後にボケ具合やフォーカスを選べる「シネマティックモード」だ。 「iPhone 13」シリーズは何が進化した? iPhone 12シリーズとスペックを比較する

「iPhone 13」シリーズは何が進化した? iPhone 12シリーズとスペックを比較する

発表されたばかりの「iPhone 13」シリーズと、先代の「iPhone 12」シリーズを比較。デザインや形状は変わっていないが、ノッチが小さくなった。プロセッサがA15 Bionicに進化し、カメラはProではマクロ撮影が可能になった。 「iPhone 13」と「iPhone 13 Pro」の大きな違いは? 4機種のスペックを比較する

「iPhone 13」と「iPhone 13 Pro」の大きな違いは? 4機種のスペックを比較する

「iPhone 13」「iPhone 13 mini」「iPhone 13 Pro」「iPhone 13 Pro Max」の4機種は何が違うのか。13と13 Proはディスプレイやカメラに差がある。iPhone 13 ProとiPhone 13 Pro Maxは、サイズ以外の違いがほぼなくなった。

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- なぜ? マクドナルド「巨大セルフ注文端末」に批判殺到の理由 UI/UXに価格表示まで……直面している課題とは (2026年05月14日)

- ソニー、炎上した「Xperia 1 VIII」のAIカメラ機能で“火消し“ 「4つの選択肢」を強調 (2026年05月18日)

- 【ワークマン】1500円の「ベーシックアンカーボディバッグ」 二気室構造で必需品がまとまる (2026年05月16日)

- 「Xperia 1 VIII」のAIカメラ機能が炎上したワケ 「画質劣化ではなく選択肢の1つ」とソニーは説明 (2026年05月15日)

- 楽天モバイルが「Rakuten WiFi Pocket 5G」の販売を再開 “Rakuten Link非対応”の表示見直しが完了【訂正】 (2026年05月16日)

- PayPay、5月以降の自治体キャンペーン発表 杉並区や相模原市で最大20%還元 (2026年04月27日)

- なぜ? ソニーが語る「Xperia 1 VIII」大幅値上げの理由 約24万〜30万円の価格は受け入れられるのか (2026年05月16日)

- 「お疲れさまです」はいらない? ビジネスチャットで“嫌われる“かもしれない振る舞い7選 (2026年05月17日)

- 楽天、MNO本格参入後に初の黒字化 三木谷会長「KDDIローミング終了」と「値上げ」は明言避ける (2026年05月15日)

- 「Xperia 1 VIII」は先代の「Xperia 1 VII」から何が進化した? デザインからカメラ、オーディオまで実機で解説 (2026年05月15日)