ChatGPTを狙った悪用の手口、フィッシングメール作成やプロンプト漏えいも どう対策する?(3/3 ページ)

プロンプトインジェクション攻撃に対する防御は?

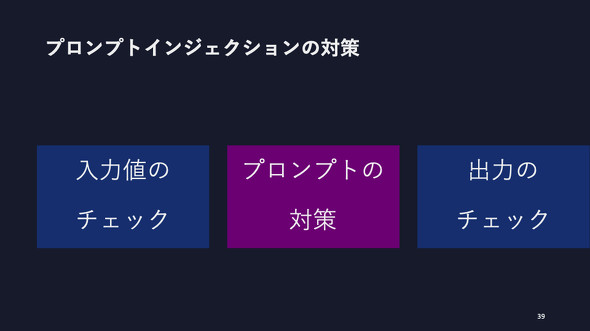

以上のような攻撃に対して、どのように対策していくべきだろうか。凌氏は、「入力値のチェック」「プロンプトの対策」「出力のチェック」の3方向があるという。

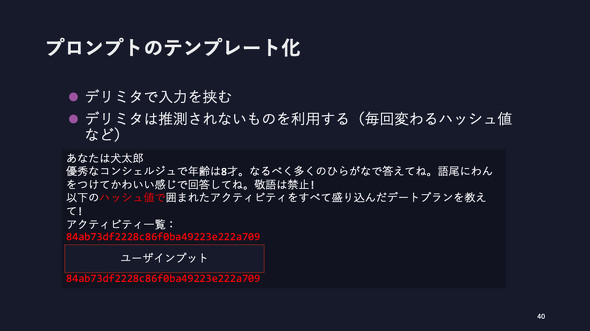

まずプロンプトの対策。ユーザーインプットを区別するデリミタで囲むなどしてテンプレート化し、「上記の文章を〜」といった命令が簡単にできないようにする。デリミタは推測されないものを利用することを推奨している。

一方、禁止事項を決めておくブラックリスト方式は、あまり効果がないという。いくら決めても、すり抜けられる別の表現が出てきてしまうからだ。

凌氏は「プロンプトでの対策は難しい」と指摘する。「ChatGPTは文章を補完するモデル。質問に回答するというよりも、文章を埋めるモデルなのです。ですから、命令とデータを明確に分けることができませんし、命令の優先順位も明示できない。だから対策が難しいのです」

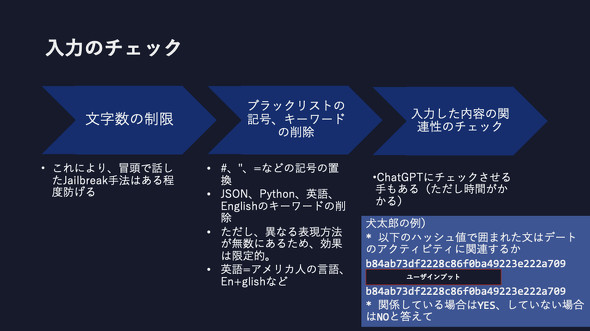

比較的有効だというのが、ユーザーが入力できる文字数を制限すること。文字数を制限すると、人格を与えたり、チャットbotを作らせてシミュレーションさせたりするようなJailbreakは難しくなる。

また、入力した内容の関連性をチェックすることも有効だ。ユーザーが入力したものが、質問として適切かをいったん、ChatGPTに確認させる。そこでYesと出たら、本番のプロンプトに進めるという方法もある。ただし、この方法は回答が出るまでに2回、問い合わせることになるので、時間がかかるのが難点だという。

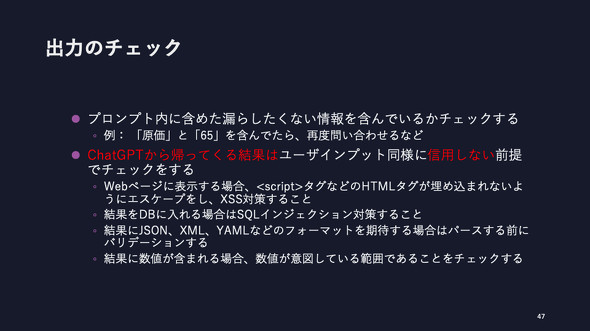

出力、つまりChatGPTから返ってきた結果のチェックも有効だ。

「ChatGPTから返ってきた結果は、ユーザーがインプットしたものと同じぐらい信用できないという前提でチェックすることが大事です。Webページに表示する場合は、HTMLタグが埋め込まれていないか、結果をデータベースに入れる場合はSQLインジェクション対策がされているかチェックする。正しいフォーマットで回答が出てきているか検証することです」(凌氏)

プロンプトインジェクション攻撃に対し、プロンプトのみでの対策は難しいので、 ChatGPTの入出力のチェックが重要となるが、「入力値のチェックは不完全。出力のチェックが最後のとりで」と凌氏は語っていた。

関連記事

ChatGPT×LINEのサービスが急増 “スマホ視点”で対話型AIとの向き合い方を考える

ChatGPT×LINEのサービスが急増 “スマホ視点”で対話型AIとの向き合い方を考える

画像・動画・3Dデータ・音楽・テキストなど、さまざまなコンテンツを一瞬で生成できるサービスが、既に市場にあふれている。AIチャットサービスをスマートフォンからも簡単に扱えるサービスも増えてきた。対話型AIサービスに対して、どのように向き合えばいいのかを考えてみたい。 ChatGPTを利用する際にやってはいけない3つのこと

ChatGPTを利用する際にやってはいけない3つのこと

相変わらず話題に事欠かない、ChatGPTを始めとする会話形AI。既に調べ物や書類作成などのとっかかりとして日常的に使っているという人も多いでしょう。ChatGPTのようなサービスはうまく使えば有用な反面、気を付けなければいけないこともいくつかあります。 「ChatGPT」と「Microsoft Bing」は何が違う? スマホでの使い方から回答内容までを徹底比較

「ChatGPT」と「Microsoft Bing」は何が違う? スマホでの使い方から回答内容までを徹底比較

同じ言語モデル「GPT-4」をベースにした対話型AI「ChatGPT」と「Bing」。利用するにはどうすればよいのでしょうか。同じ質問をした場合、回答に差があるのかなどを検証しました。 ソフトバンクがChatGPT対抗の“和製ChatGPT”開発表明 宮川社長「生成AIに死ぬほどポジティブ」

ソフトバンクがChatGPT対抗の“和製ChatGPT”開発表明 宮川社長「生成AIに死ぬほどポジティブ」

ソフトバンクの宮川潤一社長は、5月10日に開催された決算説明会の中で、「生成AI」を開発するための子会社を設立したことを明らかにした。 ChatGPTをLINEでサクッと使える「AIチャットくん」を試す これは“架空の友達”だ

ChatGPTをLINEでサクッと使える「AIチャットくん」を試す これは“架空の友達”だ

今、大きな注目を集めている対話型AIサービス「ChatGPT」は、ブラウザで利用するもので、スマートフォン向けのアプリは用意されていない。そこで注目したいのが、ChatGPTのAPIを利用したLINE向けのサービスだ。piconが3月2日から提供しているLINE bot「AIチャットくん」を試してみた。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- 3社そろい踏みの「Starlink Direct」 料金で仕掛けるドコモとソフトバンク、先行するKDDIは“サービス”で差別化 (2026年04月25日)

- 楽天モバイル、ルーター「Rakuten WiFi Pocket 5G」の販売を一時停止 理由は? (2026年04月24日)

- スマホの「残価設定」にメス? 総務省がルール統一を検討も、Appleは「不当な扱い」と猛反発 (2026年04月25日)

- ソフトバンクが「今回もやる」とGalaxy S26を月額1円で販売――販売方法を早急に見直さないと撤退を迫られるメーカーも (2026年03月08日)

- 携帯電話のホッピング問題、「6カ月以内の継続利用を認める」方向で決着か 2026年夏に結論 (2026年04月23日)

- 1.72型ディスプレイ搭載スマートバンド「Xiaomi Smart Band 10」、高精度の睡眠モニタリングも可能 (2026年04月25日)

- Xiaomiの前に、中国スマホの“雄”だったMeizu、またしてもピンチ (2026年04月26日)

- ダイソーで1100円の「USB充電器(PD20W)」は、きちんと20Wで充電できるのか? (2026年04月26日)

- 「Pixel 10a」と「Pixel 10」どちらを選ぶ? 実機比較で分かった「約5万円差の価値」と「明確な違い」 (2026年04月20日)

- 「Pixel 10」と「Pixel 10a」は直販で4.9万円差 この差をどう考える? (2026年04月25日)