NVIDIAが予測する2013年のGPU:NVISION 08(2/2 ページ)

GPGPUで新市場の開拓を実現せよ

これまで、ハイエンドGPUは“エンスージアスト”と呼ばれるパワ−ユーザーやマニアックゲーマー限定のPCパーツという印象の強かった。そのためにNVIDIAもまた特定ユーザーのための企業と考えるユーザーが多かったようだが、GPGPUという新市場とCUDAという開発環境を打ち出したことで、これまでにない新たな市場を開拓することが可能になった。GPUの強力な演算性能を生かして、これまでハイエンドCPUを中心として構成されていたシステムより低コストで、かつ、高速なシステムを作り上げることも不可能ではない。特に浮動小数点演算性能が重要な意味を持つ分野では、メニーコアによる並列性という特徴を生かして、GPUの性能を極限まで引き出せるようになった。

このように、GPGPUの性能が有効となるのは、膨大な科学技術演算を必要とする、風洞シミュレーションや資源探索シミュレーション、新薬開発、バイオテクノロジーなど、従来はスーパーコンピュータが得意とする分野だ。このほか、短時間に膨大なトランザクションが発生する金融向けシステムなど、さまざまな用途で、GPGPUの性能が期待される。東京工業大学で導入した「TSUBAME」スーパーコンピュータの事例では、PC用の安価な汎用ハードウェアを組み合わせるという方針から、NVIDIAのGPUで高速化させる研究を行っているという。

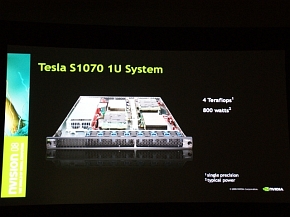

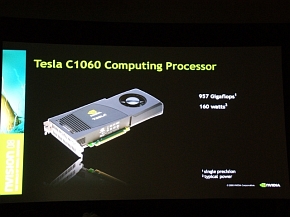

NVIDIAではこうしたGPGPU分野向けに「Tesla」というラインアップを立ち上げているが、Teslaを搭載した1Uサーバ「S1070」のほか、ワークステーション向けの拡張カード「C1060」を投入するなど、従来はHPCを使っていたが、GPGPUの処理性能の恩恵を受けるであろうユーザーに対する売り込みを積極的に行っている。

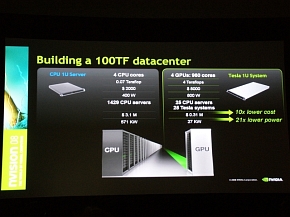

例えば、100TFLOPSの処理能力を持つシステムをデータセンターで構築する場合、Teslaを採用したシステムでは4TFLOPSの処理能力を持つS1070を25台並べて1つのラックに収納すればいいのに対し、通常のPCサーバでは1000台以上のサーバを50以上のラックに並べて配置しなければならない。消費電力やイニシャルコスト、運用コストを考えればその差は歴然だろう。GPGPUがこれまでハイエンドGPUとは無縁だったデータセンターのクライアントからも注目を集めているのには、こうした理由があるのだ。

Teslaのラインアップを導入したシステムでは、データセンタ用に1Uサーバサイズに(写真=左)、通常のワークステーションやデスクトップPCでもPCI Expressカードのサイズに収まるという(写真=右)

Teslaのラインアップを導入したシステムでは、データセンタ用に1Uサーバサイズに(写真=左)、通常のワークステーションやデスクトップPCでもPCI Expressカードのサイズに収まるという(写真=右)関連キーワード

GPU | NVIDIA | GPUコンピューティング | CUDA | 3D | GeForce | ユーザーインタフェース | 仮想世界 | Google Earth | Larrabee | メニーコア | Microsoft(マイクロソフト) | マルチコア | ストリートビュー | 3D画像 | グラフィックスカード | マルチタッチ

関連記事

GPUをあらゆる分野で使えっ――CUDAで攻勢をかけるNVIDIA

GPUをあらゆる分野で使えっ――CUDAで攻勢をかけるNVIDIA

NVIDIAが主催するイベント「NVISION 08」が米国のサンノゼで8月25日から27日にかけて行われた。「CUDA」がメインテーマの“開発者”会議でCEOは何を語ったのだろうか。 「Nehalem? もちろんウェルカムだ」――IDF目前にAMDが優位性をアピール

「Nehalem? もちろんウェルカムだ」――IDF目前にAMDが優位性をアピール

8月19日(米国時間)に始まるIDFを目前にした15〜18日にかけて、AMDは関係者向けのブリーフィングを行い、45ナノプロセスルールに関する最新情報でライバルを“けん制”した。 「Larrabee」の姿が見えてきた

「Larrabee」の姿が見えてきた

8月12日から米国で開催されるSIGGRAPH 2008に合わせて、インテルは開発中であった「Larrabee」(開発コード名)のアーキテクチャに関する概要を公開した。 NVIDIA、PhysXをGeForce 8/9シリーズで利用できる「GeForce Experience Pack」公開

NVIDIA、PhysXをGeForce 8/9シリーズで利用できる「GeForce Experience Pack」公開

NVIDIAは、GeForce 8シリーズ、及び同 9シリーズで物理演算エンジン「PhysX」が利用できるソフトウェアをセットにした「GeForce Experience Pack」を公開した。 ゲームを超えるミッションとは──NVIDIAが「GT200」にこめたGPUの可能性

ゲームを超えるミッションとは──NVIDIAが「GT200」にこめたGPUの可能性

NVIDIAの新世代GPU「GeForce GTX 280」の性能はすでに紹介したが、“新世代”たる理由がほかにもある。ここではゲームにとどまらないGPUの可能性について解説する。 アップグレードするならCPUよりGPU──NVIDIAが訴求するPC拡張プラン

アップグレードするならCPUよりGPU──NVIDIAが訴求するPC拡張プラン

NVIDIAは、4月15日にPC性能の最適化に関する説明会を日本で行い、GPUによるパフォーマンスアップのメリットについて紹介した。 NVIDIA、HPC向け新GPUブランド「Tesla」発表

NVIDIA、HPC向け新GPUブランド「Tesla」発表

NVIDIAは「GeForce」「Quadro」に続く新しいGPUブランド「Tesla」を発表した。TeslaはHPC向けの「演算処理」プロセッサとしても活躍する。 “共有するシェーダ”でGPUの新しい時代を──G80の革新性に迫る

“共有するシェーダ”でGPUの新しい時代を──G80の革新性に迫る

開発コード名「G80」と呼ばれてきたNVIDIAの最新GPUが発表された。Direct X 10に対応した「ユニファイドシェーダアーキテクチャ」を採用する最新GPUの特徴を解説していく。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- メモリ容量が最大192GBに! AMDが新型モンスターAPU「Ryzen AI Max PRO 400」を発表 (2026年05月22日)

- AMDが強々なミニPC「Ryzen AI Halo」を披露 NVIDIAのミニスパコンに“汎用性”で対抗 (2026年05月22日)

- バッテリー着脱式! Ryzen AI Max+ 395で驚異の性能をたたき出すポータブルPC「OneXFly APEX」を試す (2026年05月22日)

- どんな場面で役立つ? 「サンワダイレクト ペン型マウス 400-MAWBT202R」がタイムセールで23%オフの5380円に (2026年05月22日)

- VAIOが個人向け製品を統一価格で提供する「指定価格制度」を開始 (2026年05月22日)

- Apple Intelligenceが変える「アクセシビリティ」の未来 視線で動く車椅子や進化したVoiceOverとは (2026年05月21日)

- PFUのコンパクト高級キーボード「HHKB」シリーズが最大26%お得! (2026年05月21日)

- MicrosoftがCore Ultra(シリーズ3)搭載の新「Surface」シリーズを発表 約26.5万円から (2026年05月20日)

- 小さすぎるモバイルマウス「サンワダイレクト 400-MAWB216GM」が18%オフで販売中 (2026年05月22日)

- スマホを開かずに天気や予定をひと目で把握できる「SwitchBot スマートデイリーステーション」がタイムセールで14%オフの1万3680円に (2026年05月22日)