ハード、ソフト、AIの三位一体で攻める「Pixel 4」 “我が道を行く”ゆえの課題も:石野純也のMobile Eye(2/3 ページ)

アンビエントコンピューティングの概念を取り入れ、自然な使い勝手を実現

織井氏が「アンビエントコンピューティング(※)なくして、3つ(ハードウェア、ソフトウェア、AI)を融合させることはできない」と語ったように、Pixel 4、4 XLは、ユーザーが自然に使えるような工夫も盛り込まれた。「これらをつなぐ架け橋となるのが、Googleアシスタント」だ。発売時点では未対応だが、2モデルに合わせ、Googleアシスタントもアップデートされる予定。デザインがより、ユーザーインタフェースに溶け込んだ形になるのと同時に、端末のパフォーマンスを生かし、クラウドを使わず処理できる動作も増えるという。

確かに、アプリのアイコンがホーム画面にズラリと並び、ユーザーがそれを選んで操作するのは、織井氏が「スマートフォンが中心でその周りに皆さんがいる」と表現したように、決して自然な流れとはいえない。手に取って端末を握り、やりたいことや知りたいことを人に向かって話すのと同じようにスマートフォンを使えた方が、「自然な形で情報を届けることができる」(同)といえる。

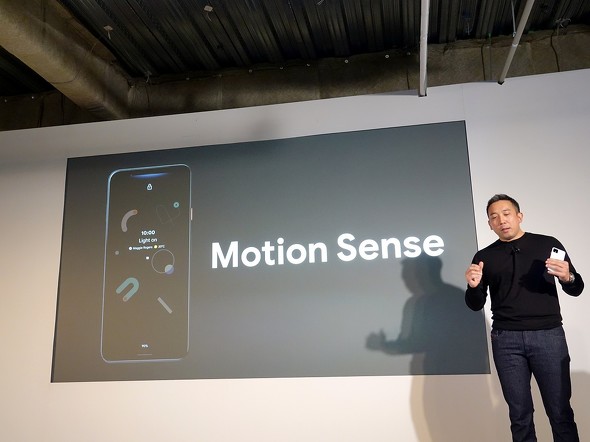

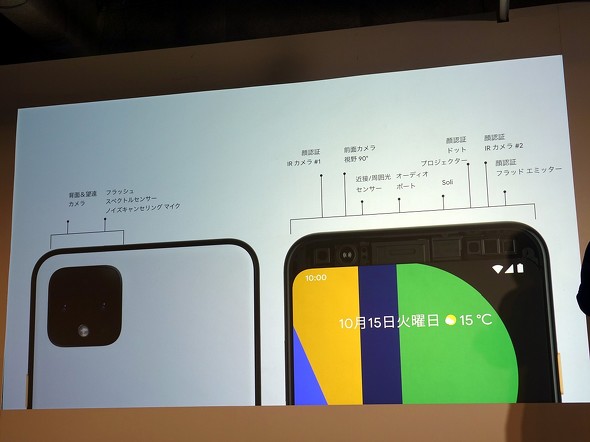

電波法の整備が済んでおらず、提供が2020年春になってしまったモーションセンスも、アンビエントコンピューティングを実現するための要素の1つといえる。この機能がオンになると、Pixel 4、4 XLはユーザーの手が近づいたことを認識。先回りして顔認証を起動させておき、より素早く画面のロックを解除できるようになる。音楽再生やアラーム、通話などの各種操作にも利用可能で、端末を手に取れないときでも、自然な形で操作できる。

応用例がまだまだ少なく、主体的にスマートフォンを操作する場面で頻繁に利用するか? というと疑問符もつく。実際、同様のジェスチャー操作は過去、さまざまなスマートフォンが実験的に取り入れてきたが、精度がいまひとつだったことも災いして、本格的には普及していない。Googleのモーションセンスも、どこまで正確に思った通りの操作ができるのかは未知数だ。

一方で、Googleは音声だけでなく、空間の手の動きを検知して、ユーザー中心の操作体系を作り上げようとしていることをモーションセンスで明確化した。ハードウェアという器を作ったのは、ここにさまざまな機能を投入していく準備にも見える。

Pixel 4、4 XLに限った話ではないが、デザインにもこうしたGoogleのコンセプトは反映されている。目指したのは「手に取ることができるGoogleサービス」だ。結果として、「human(人)」「optimistic(楽観的)」「daring(大胆)」という3つのキーワードを導き出し、ハードウェアの数々はこの思想の下でデザインされた。

Pixel 4、4 XLも、「人間味があって楽観的で、かつ大胆というコンセプトに基づいて設計した」(インダストリアルデザイン ディレクター マックス・ヨシモト氏)という。柔らかな曲線を用いていたり、ガラスを使いながらもサラサラとしたマットな仕上げにしたりといったところは、人間を中心に据えたアンビエントコンピューティングの思想ともマッチする。

関連記事

「Pixel 4」は何が新しい? 3/3aと比較、ネックは価格か

「Pixel 4」は何が新しい? 3/3aと比較、ネックは価格か

Googleの最新スマートフォン「Pixel 4」「Pixel 4 XL」が10月24日に発売される。カメラが進化し、2020年春からは新機能の「モーションセンス」が利用可能になる予定。Pixel 3や3aとの違いをまとめつつ、Pixel 4は買いなのかどうかを考えたい。 人や環境に優しい存在へ――Googleデザイン担当者が語る「Pixel 4」「Nest Mini」のデザイン

人や環境に優しい存在へ――Googleデザイン担当者が語る「Pixel 4」「Nest Mini」のデザイン

Googleが10月15日(米国東部夏時間)に発表した新製品群。それらのデザインを担当した「中の人」が来日し、デザインの背景を日本のメディア関係者に説明した。 「Pixel 4/4 XL」が10月24日に発売 税込みで約9万円から ソフトバンクも取り扱い

「Pixel 4/4 XL」が10月24日に発売 税込みで約9万円から ソフトバンクも取り扱い

Googleが10月16日、新型スマートフォン「Pixel 4」「Pixel 4 XL」の日本発売を発表した。16日からGoogleストアで予約を受け付け、24日から購入できる。Googleの他、ソフトバンクも取り扱う。 「Pixel 4」は日本版もeSIMに対応 ソフトバンクはSIMロック解除が必要

「Pixel 4」は日本版もeSIMに対応 ソフトバンクはSIMロック解除が必要

Googleの最新スマートフォン「Pixel 4」と「Pixel 4 XL」が発表された。日本モデルで初めて「eSIM」に対応したことも大きなトピックだ。ソフトバンクが販売するモデルもeSIM自体は利用できるが、SIMロック解除が必要になる。 Googleの「Pixel 3/3 XL」はiPhoneの対抗馬になるか? カギは「AI」にあり

Googleの「Pixel 3/3 XL」はiPhoneの対抗馬になるか? カギは「AI」にあり

Googleが、Pixelシリーズの最新モデル「Pixel 3」と「Pixel 3 XL」を11月1日に発売する。満を持して導入されるPixelだが、その特徴やGoogleの狙いはどこにあるのか。過去、Googleが手掛けてきたデバイスとの違いなども含め、本連載で解説したい。

Copyright © ITmedia, Inc. All Rights Reserved.

アクセストップ10

- 貼り付ければOK、配線不要の小型ドライブレコーダー発売 スマート感知センサーで自動録画 (2024年04月25日)

- Evernoteからの乗り換えでオススメのメモアプリ5選 無料で使うならどれがいい? (2024年02月13日)

- シャープ、5月8日にスマートフォンAQUOSの新製品を発表 (2024年04月24日)

- Evernote、サービス継続を発表 日本法人の閉鎖で混乱 火消しに動くも、移行先に「Notion」選ぶ声 (2024年04月27日)

- 中古スマホが突然使えなくなる事象を解消できる? 総務省が「ネットワーク利用制限」を原則禁止する方向で調整 (2024年04月25日)

- ドコモ、「Xperia 10 V」を5万8850円に値下げ 「iPhone 15(128GB)」の4.4万円割引が復活 (2024年04月25日)

- モバイルSuicaのチャージや利用でポイントがたまる 「JRE POINT」をお得に活用しよう (2024年04月26日)

- スマホを携帯キャリアで買うのは損? 本体のみをお得に買う方法を解説 (2024年04月24日)

- Evernote日本法人の解散、「アプリ終了」との誤解につながる サービス改悪、告知不足がユーザー離れに拍車 (2024年04月26日)

- 通信品質で楽天モバイルの評価が急上昇 Opensignalのネットワーク体感調査で最多タイの1位 (2024年04月25日)